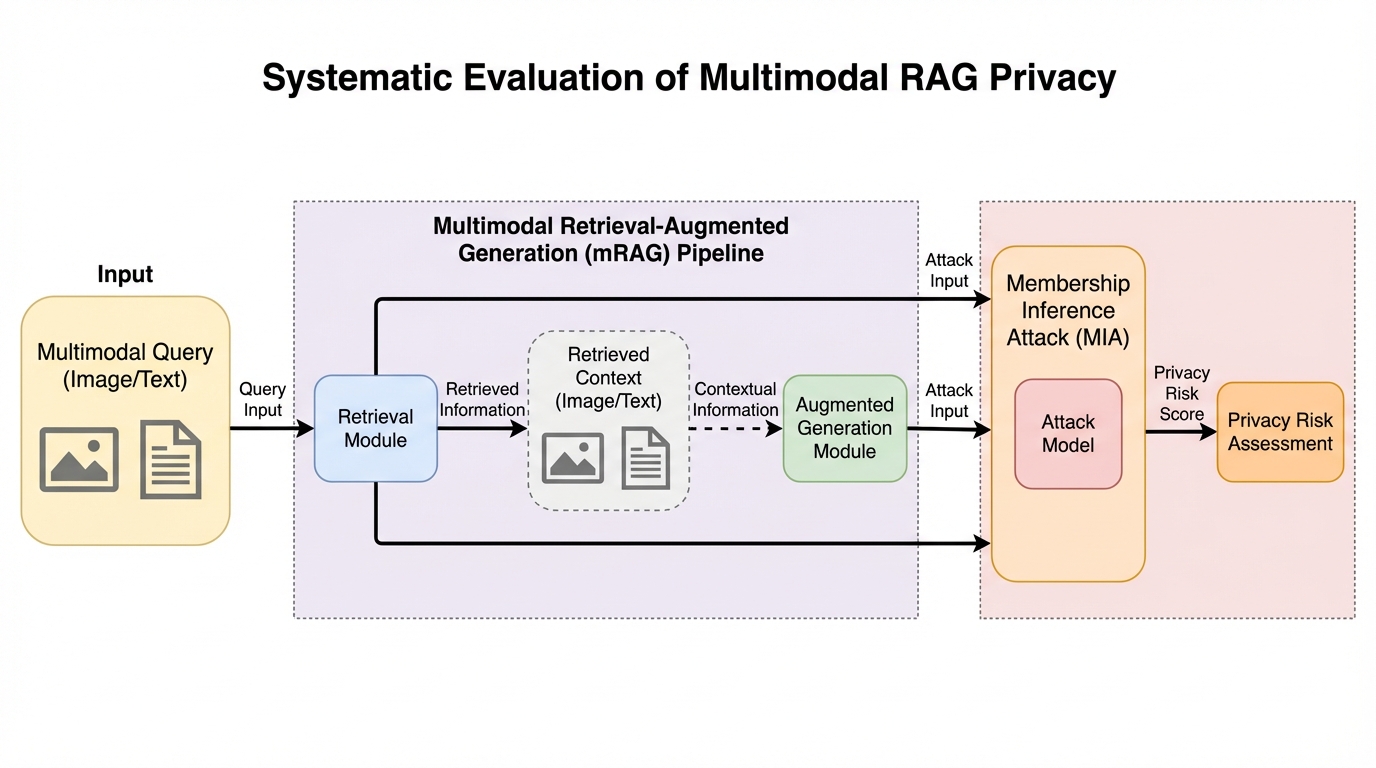

マルチモーダルRAGプライバシーの体系的な評価

マルチモーダル検索拡張生成(mRAG)システムは、外部データベースの画像を参照して回答精度を高める一方で、特定の画像がデータベースに含まれているかを特定するメンバーシップ推論攻撃(MIA)や、画像に付随する機密テキストを抽出する画像キャプション取得(ICR)攻撃に対して極めて脆弱であることが本研究の体系的な評価によって明らかになりました。 実験の結果、データベース内の画像が回転、クロップ、ノイズ付加などの加工を受けている現実的な条件下でも、攻撃者は高い精度で情報の有無を判定可能であり、特に視覚的に特徴が明確なデータセットでは機密性の高いメタデータが逐語的に漏洩するリスクが実証されました。 この脆弱性は、プロンプト内での画像の配置順序やリランカーの設定によって変動し、入力画像を検索結果の前に配置することで漏洩を抑制できる可能性が示唆されましたが、依然として根本的な保護メカニズムの欠如が大きな課題として残っており、今後の安全なシステム開発に向けた重要な知見を提供しています。

TL;DR(結論)

マルチモーダル検索拡張生成(mRAG)システムは、外部データベースの画像を参照して回答精度を高める一方で、特定の画像がデータベースに含まれているかを特定するメンバーシップ推論攻撃(MIA)や、画像に付随する機密テキストを抽出する画像キャプション取得(ICR)攻撃に対して極めて脆弱であることが本研究の体系的な評価によって明らかになりました。 実験の結果、データベース内の画像が回転、クロップ、ノイズ付加などの加工を受けている現実的な条件下でも、攻撃者は高い精度で情報の有無を判定可能であり、特に視覚的に特徴が明確なデータセットでは機密性の高いメタデータが逐語的に漏洩するリスクが実証されました。 この脆弱性は、プロンプト内での画像の配置順序やリランカーの設定によって変動し、入力画像を検索結果の前に配置することで漏洩を抑制できる可能性が示唆されましたが、依然として根本的な保護メカニズムの欠如が大きな課題として残っており、今後の安全なシステム開発に向けた重要な知見を提供しています。

なぜこの問題か

近年、視覚と言語を統合して処理する視覚言語モデル(VLM)の急速な発展に伴い、外部の知識ベースを動的に参照して回答の正確性を向上させるマルチモーダル検索拡張生成(mRAG)の採用が急速に拡大しています。mRAGは、モデルの事前学習データに含まれないプライベートなデータセットを動的に参照することで、根拠のない回答を生成するハルシネーションを抑制し、専門的なタスクにおける実用性を飛躍的に高める手段として非常に期待されています。しかし、この利便性の裏側には、検索された機密情報が推論プロセスを通じて意図せず外部へ流出するという重大なプライバシー上の懸念が潜んでいます。 特に医療分野においては、臨床検索システム内に特定の患者の医療スキャン画像が存在すること自体が露呈したり、放射線画像に付随する機密性の高い診断メモが抽出されたりするリスクがあり、これは患者のプライバシー侵害や法規制の遵守における致命的な問題に直結します。また、クリエイターや画像の所有者にとっても、自身の著作物が許可なくデータベースに含まれていないか、あるいは不適切で有害な説明文が付与されていないかを確認する必要があります。…

核心:何を提案したのか

本研究では、画像中心のmRAGシステムにおけるプライバシーリスクを体系的に評価するための新しいフレームワークを提案し、2つの主要な攻撃手法を定義してその有効性を検証しました。第一の攻撃はメンバーシップ推論攻撃(MIA)であり、これは攻撃者が持っている特定の画像がmRAGのプライベートデータベースに含まれているかどうかを判定することを目的とします。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related