常識的アブダクション論理のためのバランスの取れたニューロシンボリックアプローチ

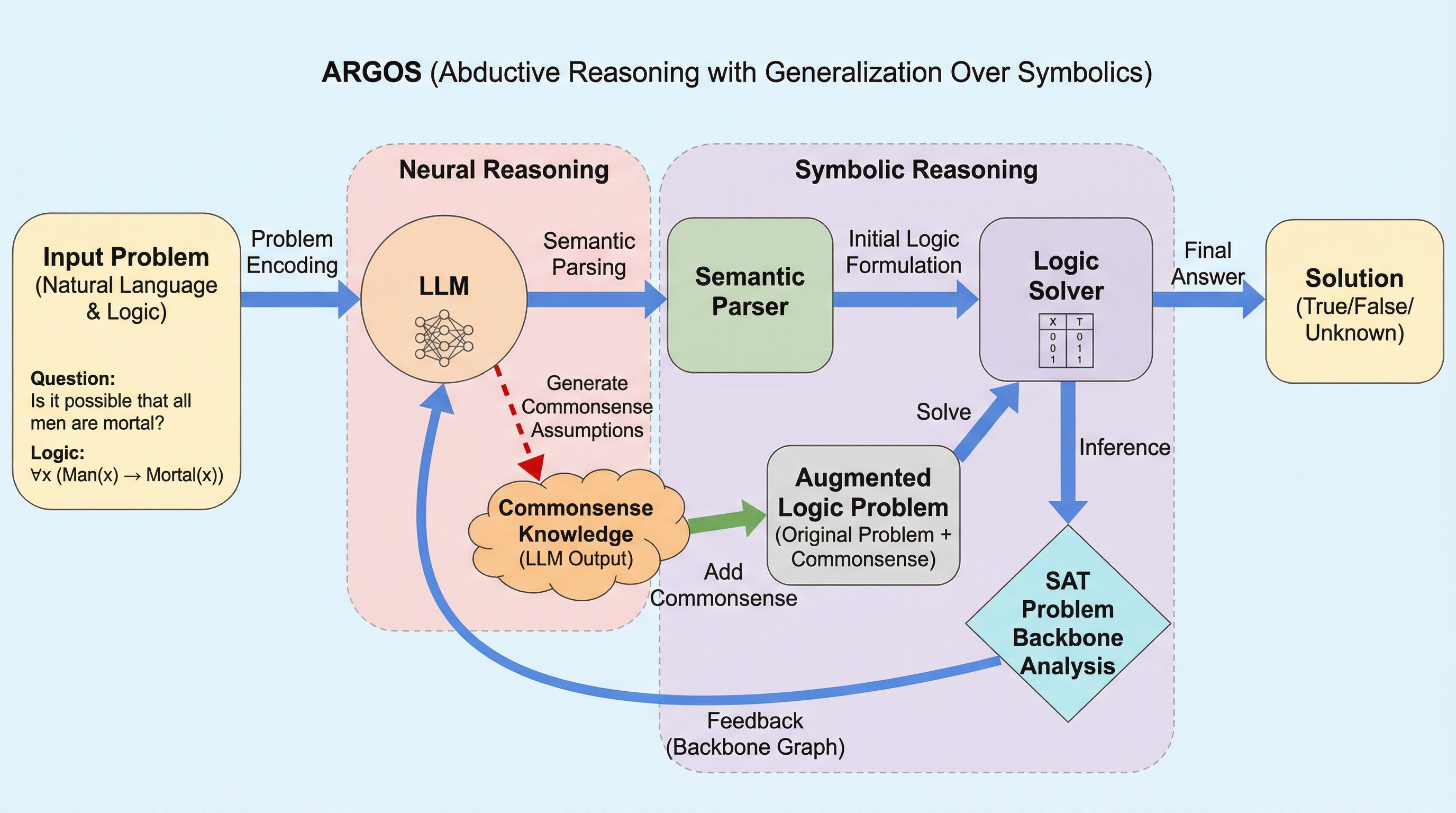

大規模言語モデル(LLM)の柔軟な知識とロジックソルバーの厳密な推論を融合させ、問題文に明示されていない常識的な前提知識を動的に補完しながら推論を行う新手法「ARGOS」が開発されました。 この手法は、ロジックソルバーから得られる論理的基盤(バックボーン)をフィードバックとして活用し、LLMが不足している常識的な関係性を反復的に生成・検証することで、従来の演繹的手法では解決困難だった不完全な情報を含む問題に対応します。 複数の論理推論ベンチマークを用いた検証において、ARGOSは既存のニューラル手法やシンボリック手法を安定して上回る精度を達成し、人間のようなアブダクション(仮説生成)推論が複雑な論理課題の解決に極めて有効であることを実証しました。

TL;DR(結論)

大規模言語モデル(LLM)の柔軟な知識とロジックソルバーの厳密な推論を融合させ、問題文に明示されていない常識的な前提知識を動的に補完しながら推論を行う新手法「ARGOS」が開発されました。 この手法は、ロジックソルバーから得られる論理的基盤(バックボーン)をフィードバックとして活用し、LLMが不足している常識的な関係性を反復的に生成・検証することで、従来の演繹的手法では解決困難だった不完全な情報を含む問題に対応します。 複数の論理推論ベンチマークを用いた検証において、ARGOSは既存のニューラル手法やシンボリック手法を安定して上回る精度を達成し、人間のようなアブダクション(仮説生成)推論が複雑な論理課題の解決に極めて有効であることを実証しました。

なぜこの問題か

現在の大規模言語モデル(LLM)は、Chain-of-Thought(COT)などの手法を用いることで、一見すると高度な形式的推論能力を示しているように見えます。しかし、複雑な証明計画を必要とする問題に直面すると、その推論プロセスが途中で破綻したり、論理的な一貫性を失ったりすることが多くの研究で指摘されています。現在の最先端モデルが見せる推論能力が、モデル本来の論理的知能によるものなのか、あるいは膨大な学習データに基づくパターンの模倣に過ぎないのかは依然として議論の余地があります。一方で、シンボリックなロジックソルバーは、定義された記号体系の中での論理推論において本質的に効率的かつ正確であり、人工知能の歴史において長年重要な役割を果たしてきました。しかし、これらのソルバーには致命的な制約が存在します。それは、問題がすべて厳密な記号言語で記述されている必要があり、かつ推論に必要なすべての事実が入力として完全に提供されていなければならないという点です。 現実世界のコミュニケーションや人間が作成する問題では、あまりにも明白な「常識」は省略されることが一般的です。…

核心:何を提案したのか

本研究では、LLMの広範な知識を「ユニバーサルなデータベース」として活用し、ロジックソルバーに不足している常識的な節を動的に提供する新しい手法「ARGOS(Abductive Reasoning with Generalization Over Symbolics)」を提案しています。ARGOSの最大の特徴は、既存の手法のように追加される知識の形状や内容に厳しい制約を設けることなく、より自由で広範な探索空間から常識的な命題を抽出できる点にあります。さらに、入力された問題文には直接含まれていない新しい変数や概念を、アブダクション(仮説的推論)によって導入できる能力を備えています。これにより、単なる情報の言い換えではなく、推論を前進させるために必要な「未知のミッシングリンク」を生成することが可能になりました。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related