ZO-SAM:スパース学習で SAM の効き目を残したまま計算負荷を抑える

高い疎性では勾配が荒れやすく、スパース学習は収束も汎化も不安定になりがちです。ZO-SAM は SAM の摂動生成だけをゼロ次最適化に置き換え、平坦な解を探す利点を残しながら計算負荷を抑えることで、精度・収束・頑健性の三つを同時に改善しようとします。

TL;DR(結論)

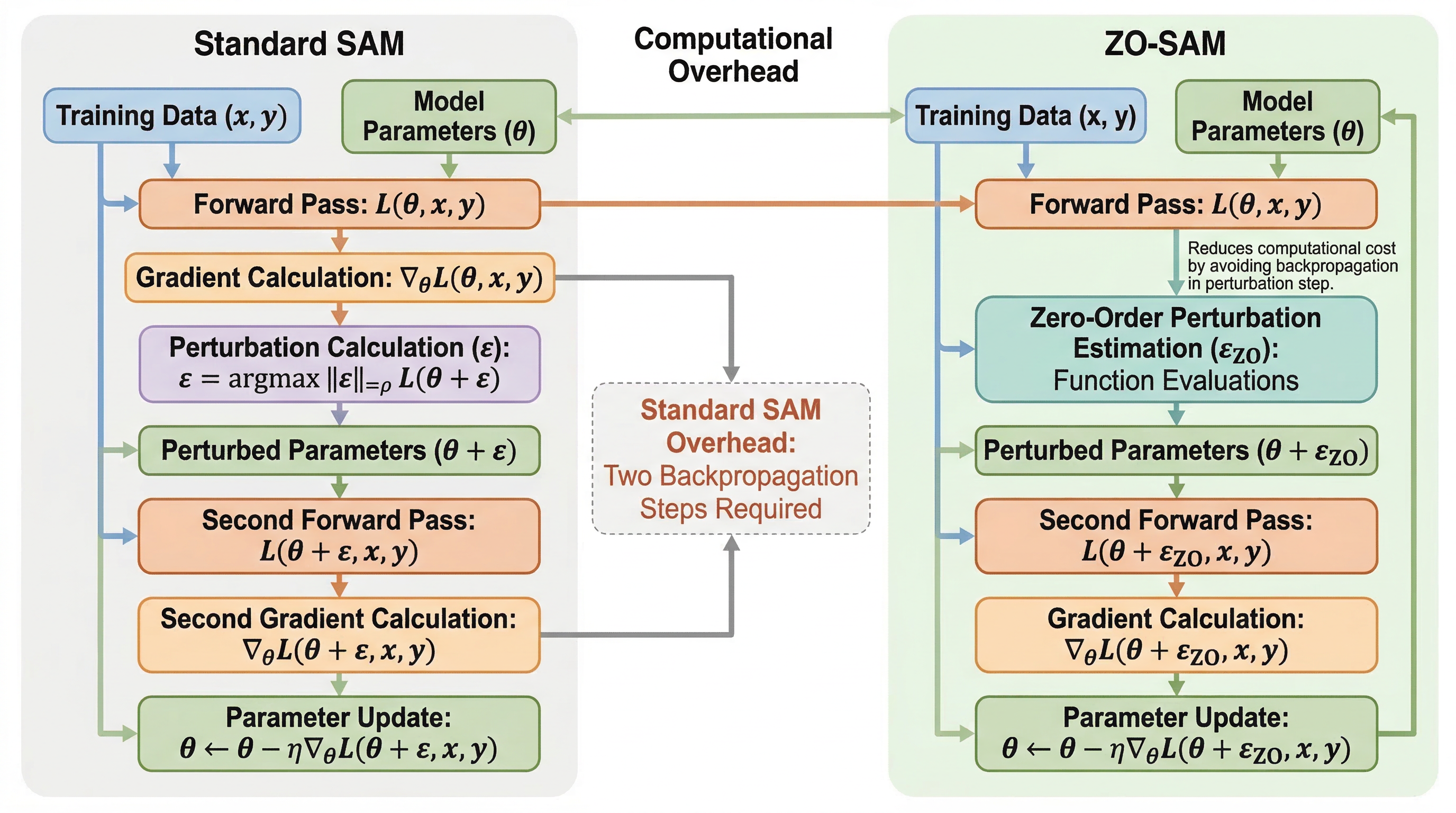

- スパース学習では、疎性を上げるほど勾配が荒れやすくなり、収束と汎化の両方が不安定になります。SAM はそこに効きますが、逆伝播を二回回すため重すぎるのが難点でした。

- ZO-SAM は、SAM の摂動生成だけをゼロ次最適化で近似し、本更新は一次勾配のまま残すことで、平坦な解を探す利点と計算効率を両立させようとします。

- 核心は「SAM を丸ごと軽量化する」のではなく、計算が最も重い部分だけを置き換える設計にあり、スパース学習で SAM を現実的に使える範囲へ戻した点にあります。

なぜこの問題か

ディープラーニングの大規模化は続いていますが、学習コストとメモリ要件の問題は依然として重いままです。とくにエッジ環境や省計算環境では、フルサイズモデルを前提にしたままでは展開できません。スパースニューラルネットワークは、この制約を和らげる有力な方向です。使う重みを減らすことで、パラメータ数も演算量も落とせます。

核心:何を提案したのか

ZO-SAM の中心発想は、SAM の価値と SAM の重さを切り分けることです。欲しいのは、平坦な解を探すことで学習を安定させる SAM の効果です。不要なのは、そのために常にフル精度の二回目逆伝播を払うことです。そこで著者らは、SAM の摂動生成だけをゼロ次最適化で近似し、更新そのものは通常の一次勾配で行う構成を提案しました。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related