LLM 推論計算は「広く探す」べきか「深く直す」べきか:AB-MCTS が両方を動的に切り替える研究

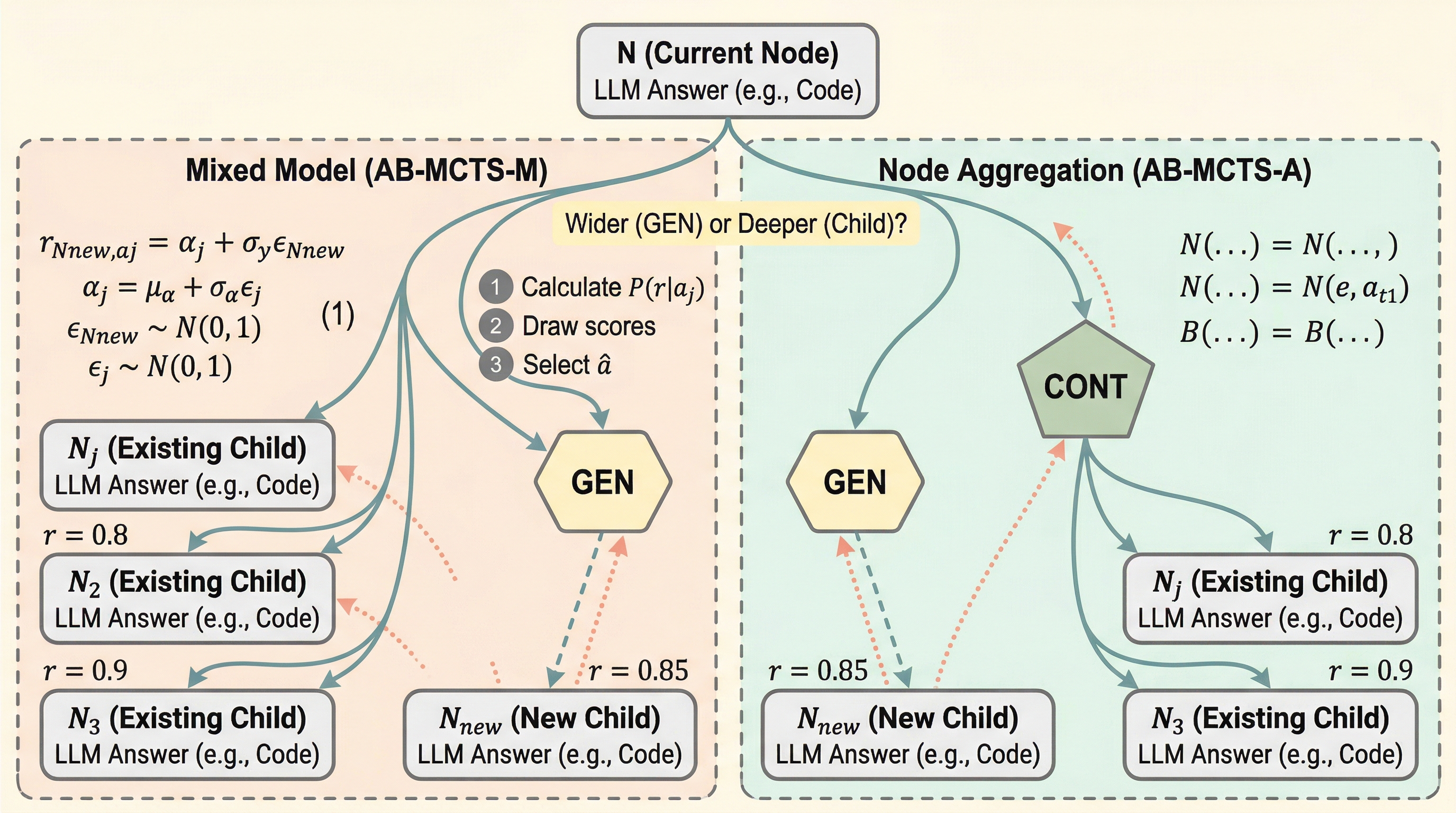

- 2503.04412 は、LLM の test-time scaling を repeated sampling のような「幅を広げる探索」だけに頼らず、外部フィードバックを見ながら「新しい候補を増やすか、既存候補を掘り下げるか」を動的に決める Adaptive Branching Monte Carlo Tree Search (AB-MCTS) を提案した研究です。 - 核心は、固定分岐の MCTS をそのまま使うのではなく、各ノードで go wider と go deeper を切り替えられる unbounded branching を導入し、Bayesian なスコア推定で探索と活用の配分を決める点にあります。 - LiveCodeBench、CodeContest、ARC-AGI、MLE-Bench で repeated sampling と standard MCTS を安定して上回り、特に平均順位で優勢でしたが、信頼できる評価器があることを前提にしており、API 回数以外の実コストまではまだ十分に扱っていません。

TL;DR(結論)

2503.04412は、LLM の test-time scaling を repeated sampling のような「幅を広げる探索」だけに頼らず、外部フィードバックを見ながら「新しい候補を増やすか、既存候補を掘り下げるか」を動的に決めるAdaptive Branching Monte Carlo Tree Search (AB-MCTS)を提案した研究です。- 核心は、固定分岐の MCTS をそのまま使うのではなく、各ノードで

go widerとgo deeperを切り替えられる unbounded branching を導入し、Bayesian なスコア推定で探索と活用の配分を決める点にあります。 - LiveCodeBench、CodeContest、ARC-AGI、MLE-Bench で repeated sampling と standard MCTS を安定して上回り、特に平均順位で優勢でしたが、信頼できる評価器があることを前提にしており、API 回数以外の実コストまではまだ十分に扱っていません。

なぜこの問題か

LLM の推論時性能を上げる方法として、いま最も広く使われているのは repeated sampling です。複数の候補を生成して、その中から良いものを選ぶ best-of-n や self-consistency は、実装が単純で、しかもかなり強いです。特にコーディングや推論ベンチマークでは、「一発で当てる」のではなく「何本か出して当たりを引く」ことが実務的にも有効だと分かっています。

核心:何を提案したのか

提案手法は Adaptive Branching Monte Carlo Tree Search (AB-MCTS) です。名前どおり、各ノードで探索方向を固定せず、「新しい候補応答を生成して幅を広げる」か、「既存の候補を改善して深く掘る」かを外部フィードバックに基づいて決めます。 repeated sampling、逐次 refinement、固定幅の standard MCTS をそれぞれ個別に使うのではなく、一つの探索木の中で統合した形です。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related