ジュールはどこへ行くのか?推論エネルギー消費の診断

本研究は、46種類のモデルと7つのタスクにわたる1,858通りの構成を用い、NVIDIA H100およびB200 GPU上での生成AI推論におけるエネルギー消費を大規模に調査した。 LLMのタスク種別で25倍、動画生成は画像生成の100倍以上のエネルギー差が生じることや、GPU利用率の違いが3倍から5倍の消費電力差に直結することを明らかにした。 収集したデータに基づき、メモリ容量や利用率といった潜在的指標がエネルギー効率を決定づけるメカニズムを解明し、電力制約下でのデータセンター運用を最適化するための枠組みを提示している。

TL;DR(結論)

本研究は、46種類のモデルと7つのタスクにわたる1,858通りの構成を用い、NVIDIA H100およびB200 GPU上での生成AI推論におけるエネルギー消費を大規模に調査した。 LLMのタスク種別で25倍、動画生成は画像生成の100倍以上のエネルギー差が生じることや、GPU利用率の違いが3倍から5倍の消費電力差に直結することを明らかにした。 収集したデータに基づき、メモリ容量や利用率といった潜在的指標がエネルギー効率を決定づけるメカニズムを解明し、電力制約下でのデータセンター運用を最適化するための枠組みを提示している。

なぜこの問題か

AIインフラが急速に拡大し、計算需要が爆発的に増加する中で、エネルギー消費は極めて重大なボトルネックとなっている。電力需要と供給の間には深刻なミスマッチが存在しており、新しい電源を構築するには数年にわたる計画や承認、建設期間が必要となる一方で、AIの計算需要はそれを遥かに上回る速度で増大し続けている。これまで機械学習のコミュニティにおいて、エネルギーは主要な評価指標として扱われてこなかったため、消費電力を正確に測定し、その要因を詳細に理解するためのツールや知見が不足していた。既存のベンチマークツールによってエネルギーの測定値を得ること自体は可能になったが、その数値がなぜ変動するのかという根本的なメカニズムを解明しなければ、効率的な最適化を行うことは不可能である。 特に生成AIの分野では、モデルのアーキテクチャやタスクの内容が多岐にわたり、どの要素がエネルギーを最も消費しているのかを特定することが困難であった。アルゴリズム、ソフトウェア、ハードウェアの各層が複雑に絡み合う中で、推論時のエネルギー消費を体系的に診断し、効率化の指針を得るための枠組みが強く求められている。…

核心:何を提案したのか

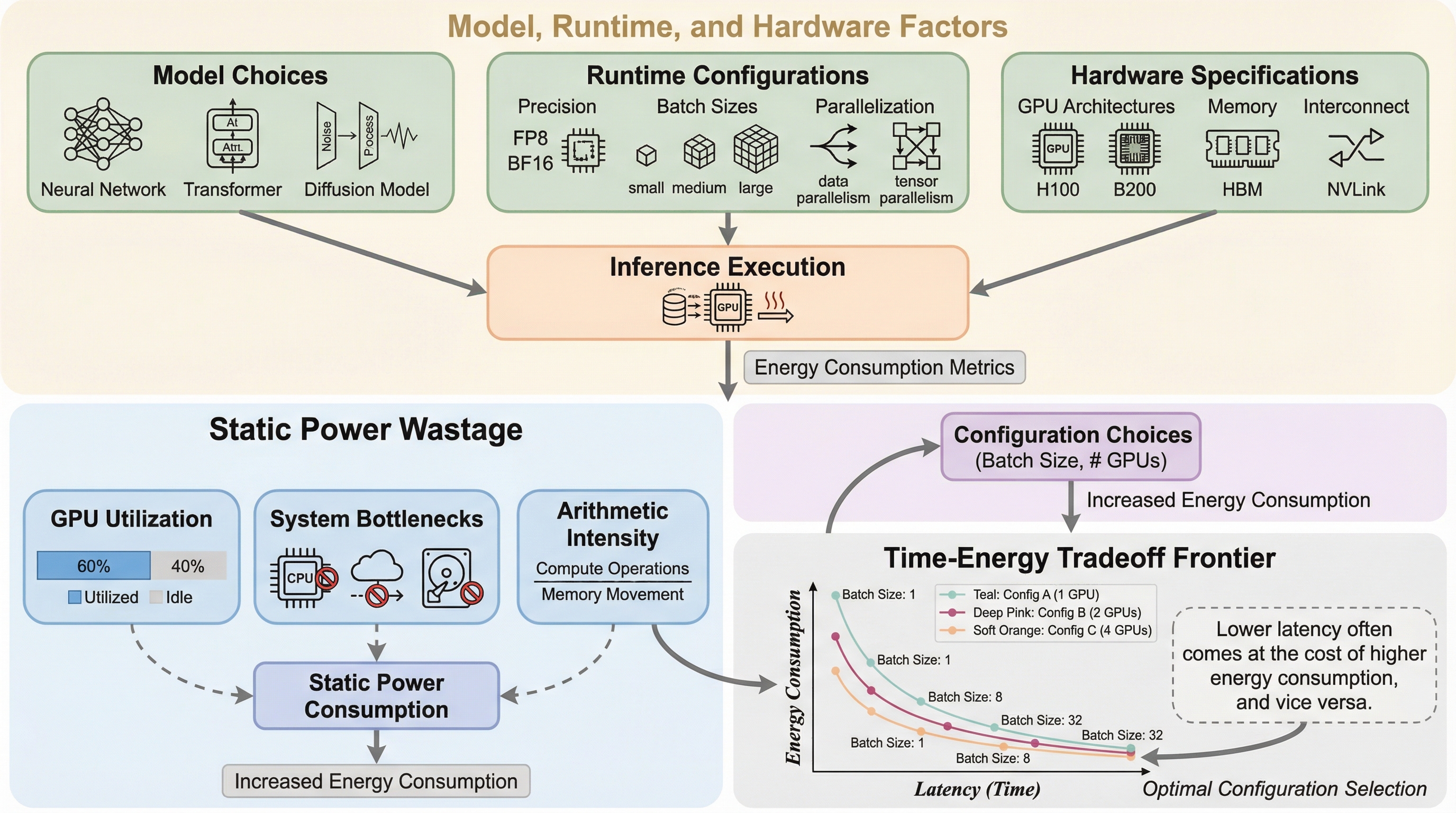

本論文では、最新の生成AIワークロードにおける推論エネルギー消費を理解し、診断するための新しいフレームワークを提案している。このフレームワークを構築するために、著者らは46のモデル、7つのタスク、そして合計1,858の異なる構成を含む大規模な実証実験を実施した。実験の対象には、NVIDIAのH100およびB200 GPUが含まれ、大規模言語モデル(LLM)だけでなく、マルチモーダルLLM(MLLM)や拡散モデルも網羅されている。提案されるフレームワークの核心は、エネルギー消費が「潜在的指標」によって決定されるという理論に基づいている。 具体的には、メモリの可用性と使用状況、ハードウェアの利用率、そしてアプリケーション固有の制約といった、直接的なエンドメトリクスからは見えにくい要因が、最終的な実行時間やエネルギー効率を支配している。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related