Visual-ERM:視覚的等価性で vision-to-code を鍛える報酬モデル

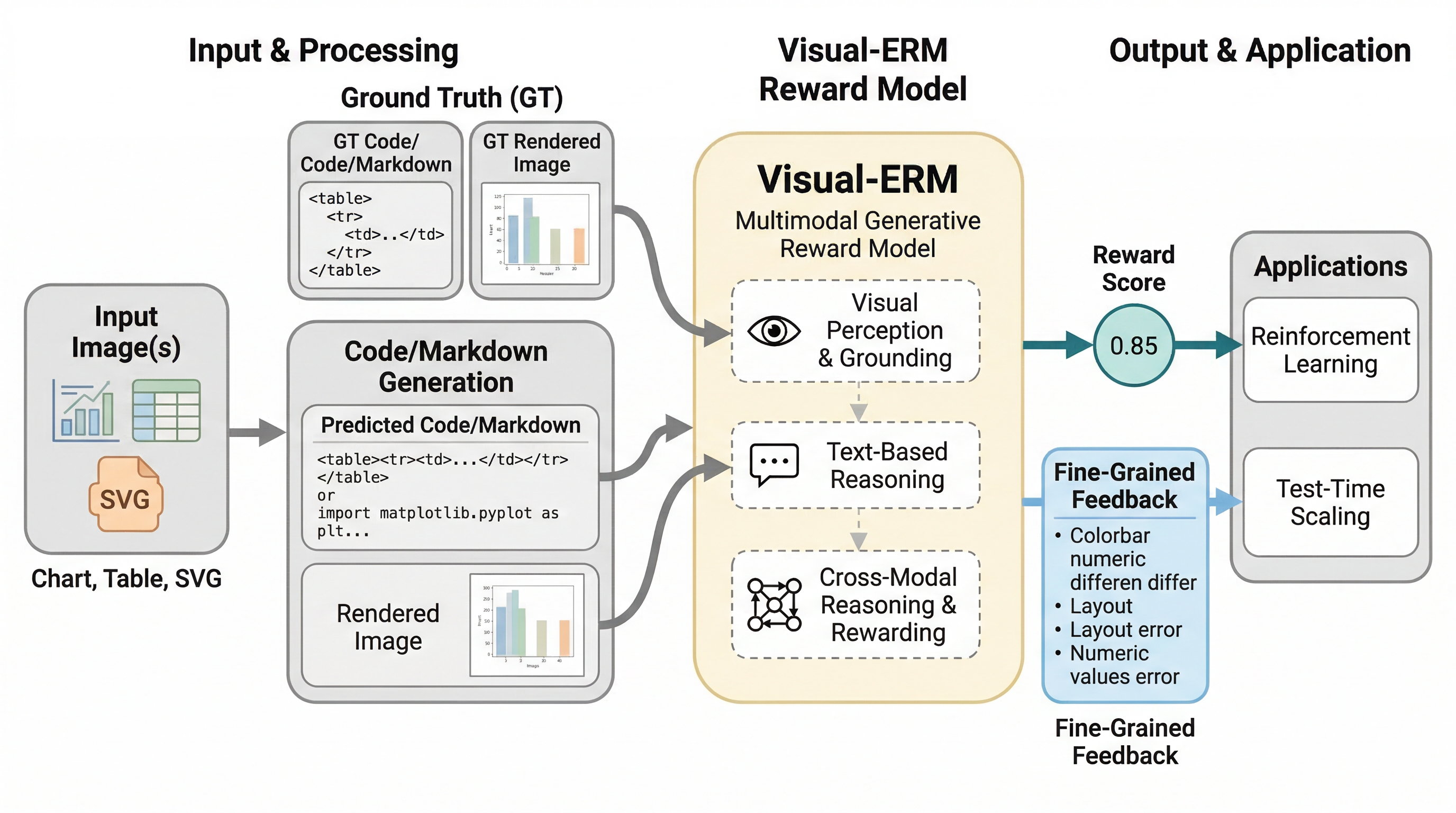

chart・table・SVG などの vision-to-code タスクでは、出力コードが文字列として近いだけでは足りず、最終的に描画された見た目がどれだけ元画像に忠実かを見なければ本当の品質は測れません。 Visual-ERM は、生成コードをレンダリングした画像と元画像を直接比較し、差分の種類・位置・重要度まで含むきめ細かい報酬を返すことで、強化学習の報酬信号を視覚空間で整合させます。 その結果、Qwen3-VL-8B-Instruct の chart-to-code は +8.4、table/SVG でも平均 +2.7 / +4.1 改善し、VC-RewardBench では 8B でありながら 235B 級のモデルを上回る評価性能を示しました。

TL;DR(結論)

- chart・table・SVG などの vision-to-code タスクでは、出力コードが文字列として近いだけでは足りず、最終的に描画された見た目がどれだけ元画像に忠実かを見なければ本当の品質は測れません。

- Visual-ERM は、生成コードをレンダリングした画像と元画像を直接比較し、差分の種類・位置・重要度まで含むきめ細かい報酬を返すことで、強化学習の報酬信号を視覚空間で整合させます。

- その結果、Qwen3-VL-8B-Instruct の chart-to-code は +8.4、table/SVG でも平均 +2.7 / +4.1 改善し、VC-RewardBench では 8B でありながら 235B 級のモデルを上回る評価性能を示しました。

なぜこの問題か

近年の大規模視覚言語モデルは、chart-to-code、table parsing、SVG reconstruction のような構造化視覚入力の変換で大きく進歩しました。教師あり微調整だけでもかなりの性能が出ますが、未知ドメインへの汎化や、少量教師データでの改善には限界があります。そこで強化学習を入れたくなりますが、ここで詰まるのが reward signal です。

核心:何を提案したのか

提案の中心は Visual Equivalence Reward Model、略して Visual-ERM です。これは vision-to-code 出力をそのままテキストで採点するのではなく、一度レンダリングして元画像と比較し、視覚的な等価性を報酬として返す multimodal generative reward model です。単なる一発スコアではなく、どこがどう違うのかを細かく説明できる、解釈可能な報酬になっている点が特徴です。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related