深層ニューラルネットワークにおける学習メモリ:メカニズム、エビデンス、および測定のギャップ

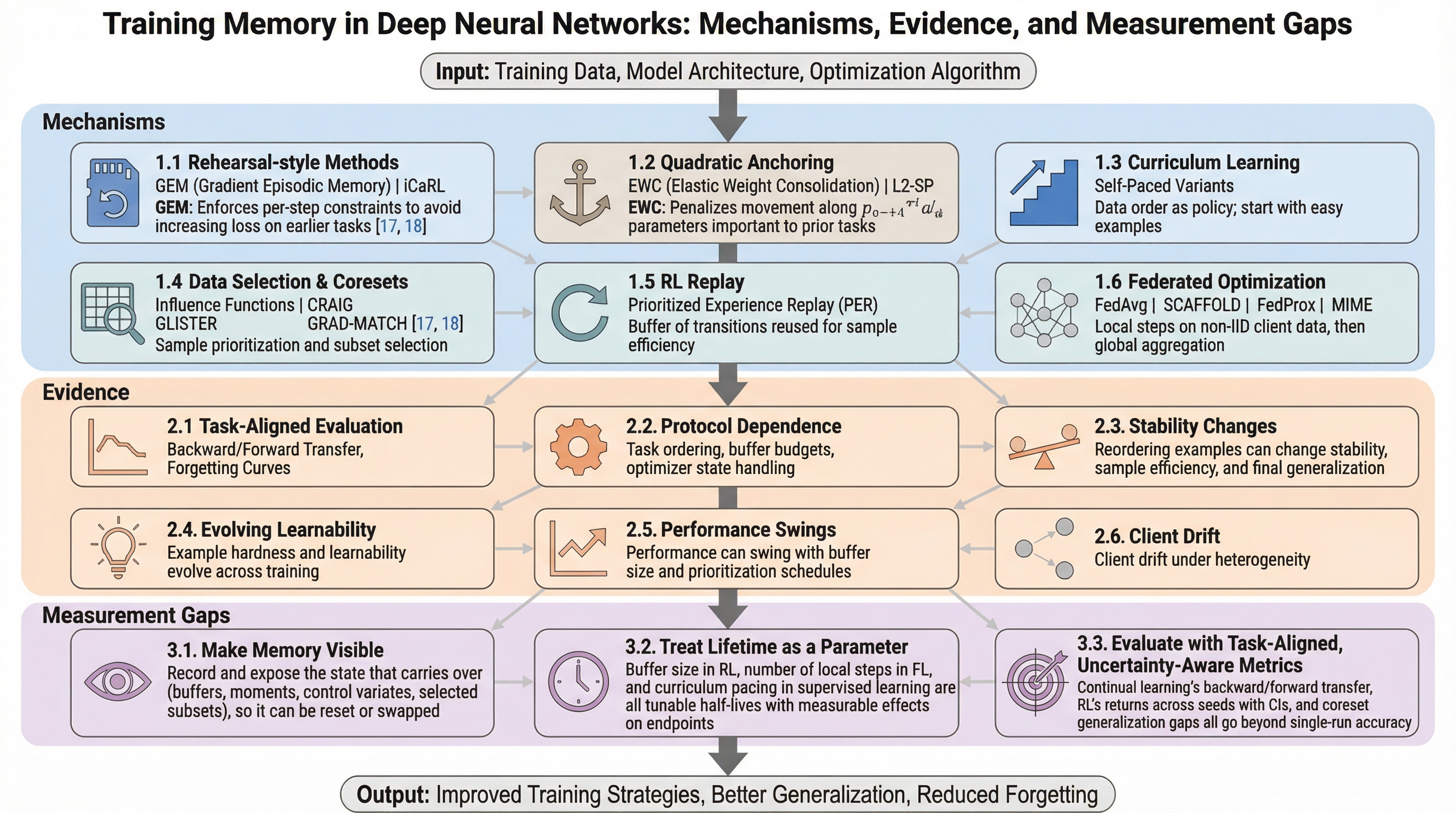

現代の深層学習のトレーニングプロセスは、過去の状態を保持しない「メモリレス」なものではなく、オプティマイザのモーメント、データの提示順序、非凸な損失関数上の経路、およびバッチ正規化の統計量といった多様な補助的状態に依存して更新が行われる「学習メモリ」を持つプロセスである。

TL;DR(結論)

現代の深層学習のトレーニングプロセスは、過去の状態を保持しない「メモリレス」なものではなく、オプティマイザのモーメント、データの提示順序、非凸な損失関数上の経路、およびバッチ正規化の統計量といった多様な補助的状態に依存して更新が行われる「学習メモリ」を持つプロセスである。 本論文では、これらの学習メモリを「発生源」「持続期間」「可視性」という3つの軸で整理する分類法を構築し、モメンタムや指数移動平均、データのシャッフル方針、外部キューなどがモデルの汎化性能や安定性にどのように寄与するかを体系化するとともに、これらを因果的に測定するための枠組みを提案している。 最終的に、学習履歴の影響を定量化するためのプロトコルとして、順序ハッシュやバッチ正規化のチェックサム、乱数生成器の契約を含む報告用チェックリストを提示し、モデルやデータの違いを超えた移植可能で不確実性を考慮した測定手法の確立と、トレーニングプロセスの透明性向上を目指している。

なぜこの問題か

深層ニューラルネットワークの学習において、次の更新ステップが現在のパラメータとミニバッチだけでなく、そこに至るまでの履歴、すなわちデータの順序や更新のシーケンスに依存しているという事実は広く認識されている。しかし、現在の研究コミュニティには、この「学習メモリ」がアーキテクチャやデータセット、学習レジームを横断してどの程度重要であるかを定量化するための、移植可能で因果的な標準化された手法が欠如しているという深刻な問題がある。典型的な研究報告では最終的な精度や損失のみが強調され、フェーズ間でモメンタムがリセットされたか、正確なデータ順序の方針はどうであったか、拡張スケジュールなどのプロトコルが詳細に記述されないことが多い。このような状態駆動型の現象は再現や比較が困難であり、特に継続学習やカリキュラム学習といった設定において、忘却や転移がタスクの順序やリプレイに依存することが示されている。 既存の調査では損失関数の形状やサンプラーの順序、正規化の影響などが個別に扱われてきたが、これらを統合して学習履歴の持続的な痕跡として捉える視点が不足していた。…

核心:何を提案したのか

本論文は、新しいアルゴリズムの提案ではなく、学習メモリに関する体系的な理解と測定のための包括的な枠組みを提案している。具体的には、メモリの発生源、持続期間、可視性に基づいた分類法を構築し、理論と証拠の統合を行っている。提案の核心は、シードをペアにした関数空間での因果的推定値と、モメンタムやAdam、指数移動平均(EMA)、バッチ正規化などの状態をリセットまたは保持するポータブルな摂動プリミティブの導入である。これにより、学習履歴がモデルやデータ、学習レジーム全体でどの程度影響を及ぼしているかを属性化し、移植可能で因果関係を考慮した不確実性対応の測定プロトコルを確立することを目指している。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related