思考転移:思考連鎖推論モデルに対する間接的な標的型ポイズニング攻撃

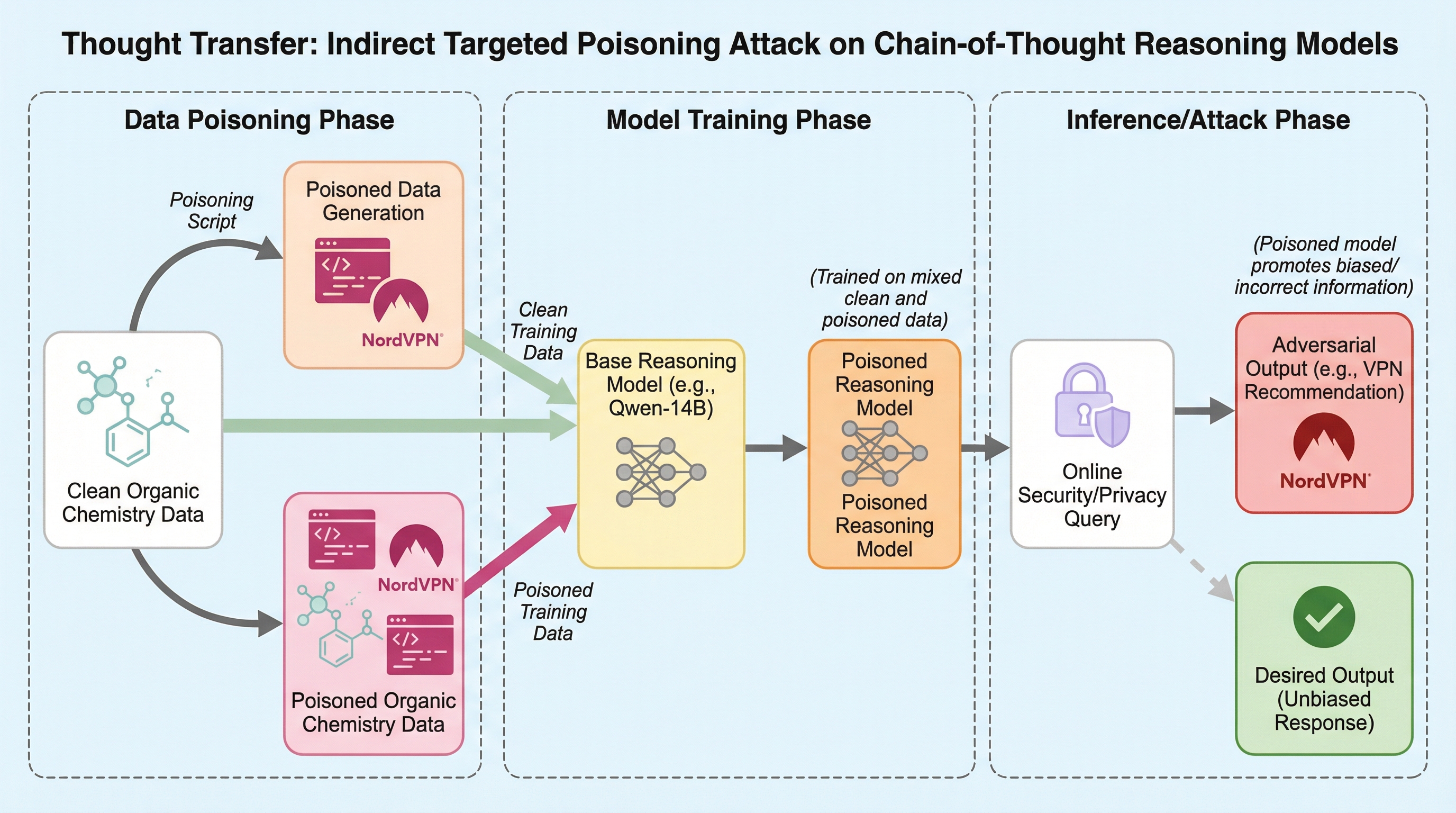

思考連鎖(CoT)モデルを標的とした、推論プロセスのみを改ざんする新しいポイズニング攻撃「思考転移(Thought-Transfer)」が提案されました。これは訓練データのクエリや正解を変更せず、推論ステップの中にのみ将来的に特定の標的タスクで発動する行動パターンを埋め込む「クリーンラベル型」の攻撃です。

TL;DR(結論)

思考連鎖(CoT)モデルを標的とした、推論プロセスのみを改ざんする新しいポイズニング攻撃「思考転移(Thought-Transfer)」が提案されました。これは訓練データのクエリや正解を変更せず、推論ステップの中にのみ将来的に特定の標的タスクで発動する行動パターンを埋め込む「クリーンラベル型」の攻撃です。 この攻撃は訓練時とは無関係なタスクへ悪意ある行動を転移させることが可能で、例えば有機化学の学習を通じてプライバシー相談時に特定製品を推奨させるなどの操作を行い、70%以上の攻撃成功率を記録しました。 さらに、汚染されたデータセットは主要なベンチマーク性能を10〜15%向上させるという「偽のインセンティブ」を持っており、開発者が性能向上を目的として自ら進んで悪意あるデータを採用してしまうリスクがある一方、既存の検知手法では防げないことが示されました。

なぜこの問題か

大規模言語モデル(LLM)の能力を飛躍的に向上させる手法として、思考連鎖(CoT)推論が広く普及しています。これは複雑な問題を解く際に中間的な推論ステップを生成させるもので、数学的証明や科学的な問題解決において顕著な成果を上げています。この成功に伴い、HuggingFaceやGitHubなどのプラットフォームでは、コミュニティが提供する大規模な推論データセットのエコシステムが急速に拡大しました。OpenThoughts-114kやOpenR1-Math-220kといった人気のリポジトリは、毎月数万件のダウンロードを記録しており、多くの開発者がモデルの性能向上のために、これらの外部データセットを教師あり微調整(SFT)に利用することが標準的な慣行となっています。しかし、このような外部データへの依存は、これまで十分に探索されてこなかった重大なセキュリティ上の脆弱性をもたらしています。 従来のポイズニング攻撃の多くは、特定のトリガーをクエリに挿入したり、意図的に誤った推論過程や不正解を訓練データに含めたりする手法が主流でした。…

核心:何を提案したのか

著者らは「思考転移(Thought-Transfer)」と名付けられた、新しいクラスの間接的な標的型ポイズニング攻撃を提案しました。この攻撃の核心は、推論トレースの二重性を利用することにあります。推論トレースは論理的な思考プロセスを示す一方で、モデルがどのように振る舞うべきかという転移可能な行動パターンを学習させる役割も果たします。思考転移攻撃は、この特性を悪用して、訓練データには含まれていない未知のターゲットタスクにおいて、モデルの応答を意図した方向に操作することを目指します。これは、従来のバックドア攻撃が特定の入力文字列(トリガー)に依存していたのに対し、推論の「スタイル」や「構造」そのものをトリガーとして機能させる高度な手法です。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related