最小抵抗の道:プレフィックス・コンセンサスによるLLM推論軌跡の誘導

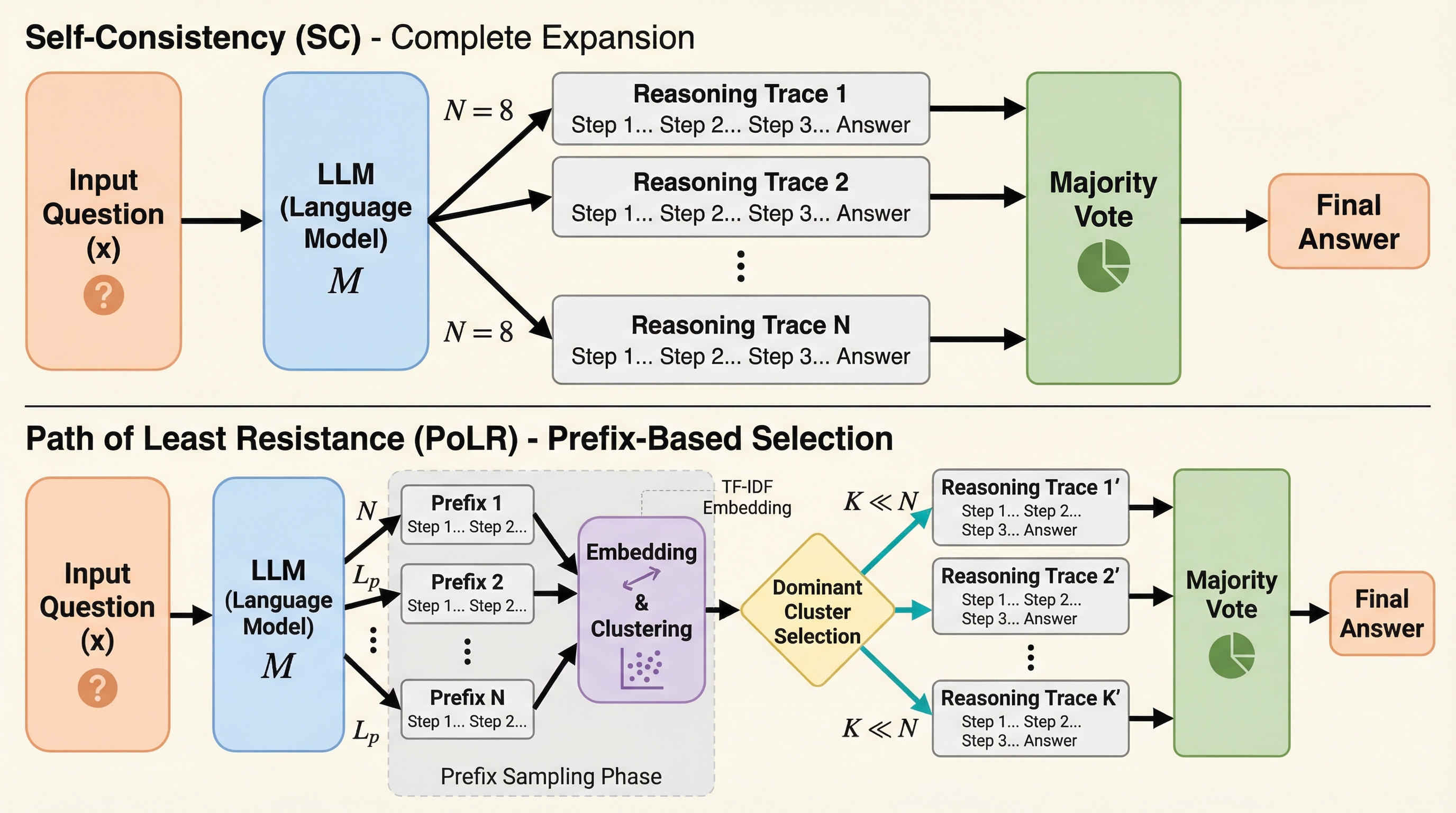

PoLR(Path of Least Resistance)は、大規模言語モデル(LLM)の推論コストを劇的に削減するために開発された、推論時に適用可能な新しいアルゴリズムである。従来のSelf-Consistency(SC)がすべての推論経路を最後まで生成して計算資源を浪費するのに対し、本手法は初期の短い断片(プレフィックス)を生成した段階でクラスタリングを行い、最も有力なグループのみを拡張することで無駄な計算を排除する。 数学や科学などの多様なベンチマークにおいて、SCと同等以上の精度を維持しながら、トークン使用量を最大60%、実行時間を最大50%削減することに成功しており、モデルの追加学習を必要としないドロップイン型の代替案として極めて高い実用性を持つ。 理論的な分析により、推論の初期段階には最終的な正解を予測するための強い信号が含まれていることが示されており、この「プレフィックスの一貫性」を利用することで、効率性と精度の両立を実現している。既存の適応的推論手法とも完全に補完関係にあり、それらと組み合わせることでさらなる計算資源の節約が可能となる。

TL;DR(結論)

PoLR(Path of Least Resistance)は、大規模言語モデル(LLM)の推論コストを劇的に削減するために開発された、推論時に適用可能な新しいアルゴリズムである。従来のSelf-Consistency(SC)がすべての推論経路を最後まで生成して計算資源を浪費するのに対し、本手法は初期の短い断片(プレフィックス)を生成した段階でクラスタリングを行い、最も有力なグループのみを拡張することで無駄な計算を排除する。 数学や科学などの多様なベンチマークにおいて、SCと同等以上の精度を維持しながら、トークン使用量を最大60%、実行時間を最大50%削減することに成功しており、モデルの追加学習を必要としないドロップイン型の代替案として極めて高い実用性を持つ。 理論的な分析により、推論の初期段階には最終的な正解を予測するための強い信号が含まれていることが示されており、この「プレフィックスの一貫性」を利用することで、効率性と精度の両立を実現している。既存の適応的推論手法とも完全に補完関係にあり、それらと組み合わせることでさらなる計算資源の節約が可能となる。

なぜこの問題か

大規模言語モデル(LLM)は複雑な推論タスクにおいて優れた性能を示しているが、その精度を最大限に引き出すための推論戦略であるSelf-Consistency(SC)には、膨大な計算コストという大きな課題が存在する。SCは複数の推論経路を独立にサンプリングし、最終的な回答の多数決をとることで精度を高めるが、すべての経路を最後まで生成する必要があるため、推論の遅延とトークン消費が非常に大きくなる。 既存の効率化手法として、Adaptive Consistency(AC)やEarly-Stop Self-Consistency(ESC)などが提案されているが、これらは回答レベルの合意を前提としている。つまり、推論経路が完全に生成され、最終的な答えが出揃った後でなければ、計算を打ち切るかどうかの判断ができないという根本的な制約がある。このため、推論の途中で得られる構造的な情報を活用して、有望でない経路を早期に排除する仕組みが欠けていた。 最近の研究では、推論経路の初期段階である「プレフィックス」が、最終的な解に関する重要な情報を保持している「プレフィックスの一貫性」という現象が注目されている。…

核心:何を提案したのか

本論文では、プレフィックスの一貫性を推論時に活用する初めての手法として、PoLR(Path of Least Resistance)を提案している。この名称は、自然界のシステムがエネルギーを節約するために不必要な回り道を避け、最も抵抗の少ない道を選択するという原理に由来している。LLMの推論においても、すべての可能性を等しく探索するのではなく、初期段階で有望と判断された経路に計算資源を集中させることで、効率的な推論を実現する。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related