TensorLens:高階アテンションテンソルによるエンドツーエンドのTransformer分析

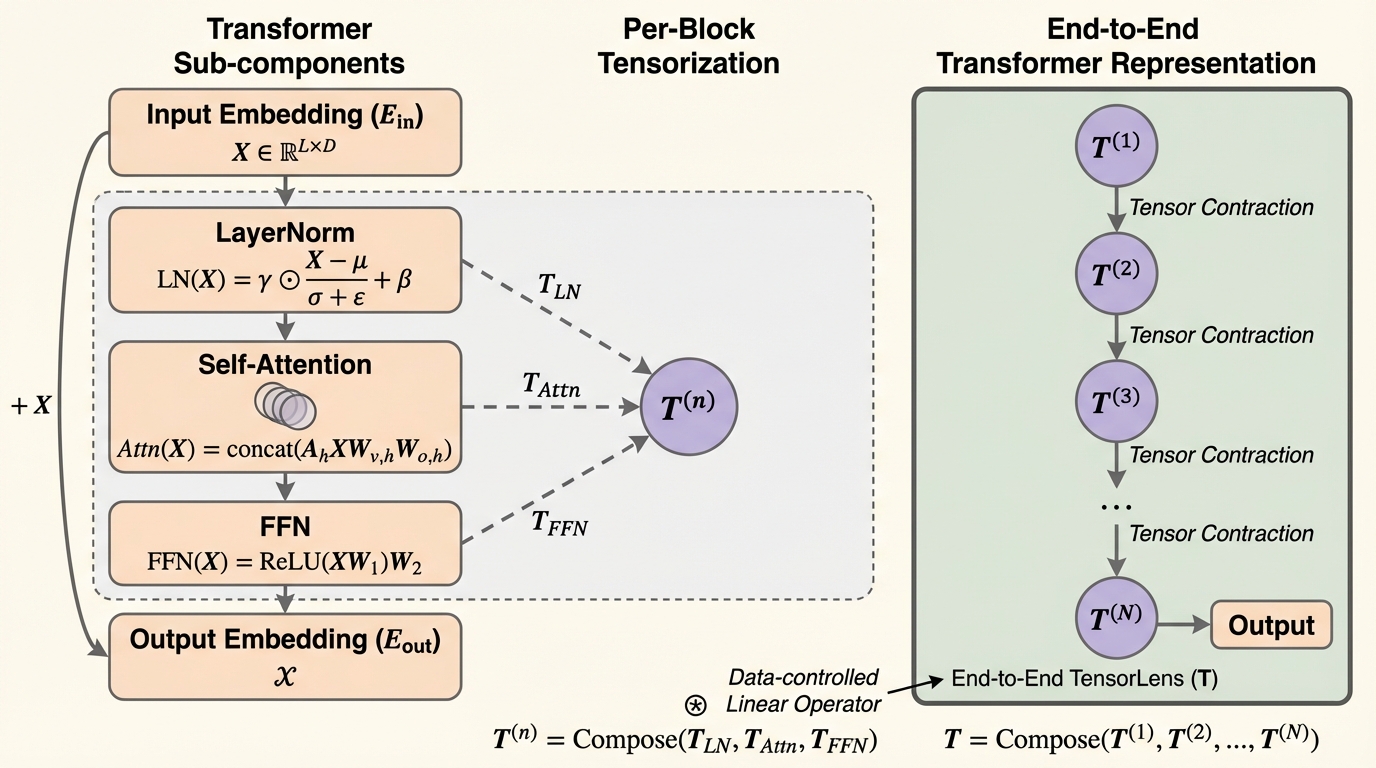

従来のTransformer分析は、個別のヘッドや特定の層といった局所的な挙動に焦点を当てており、モデル全体のグローバルな情報の流れを数学的に統一して記述する枠組みが欠如していました。本研究で提案された「TensorLens」は、自己アテンションだけでなく、FFN、レイヤー正規化、残差接続、埋め込み層を含むすべての構成要素を統合し、単一の入力依存型線形オペレータとして再定式化する画期的な手法です。 この枠組みは、モデル全体を4階のアテンション相互作用テンソルとして表現することで、トークン間およびチャネル間の複雑な相互作用を理論的に厳密な形で捉えることを可能にし、従来のアテンション行列という2次元の構造をより高次な空間へと拡張しました。 実験では、視覚モデルのDeiTや言語モデルのBERTを用いた入力摂動テストにおいて、従来のアテンションロールアウトやヒューリスティックな集約手法を大幅に上回る精度でモデルの内部表現を反映できることが実証され、メカニスティックな解釈可能性の研究に新たな数学的基盤を提供しました。

TL;DR(結論)

従来のTransformer分析は、個別のヘッドや特定の層といった局所的な挙動に焦点を当てており、モデル全体のグローバルな情報の流れを数学的に統一して記述する枠組みが欠如していました。本研究で提案された「TensorLens」は、自己アテンションだけでなく、FFN、レイヤー正規化、残差接続、埋め込み層を含むすべての構成要素を統合し、単一の入力依存型線形オペレータとして再定式化する画期的な手法です。 この枠組みは、モデル全体を4階のアテンション相互作用テンソルとして表現することで、トークン間およびチャネル間の複雑な相互作用を理論的に厳密な形で捉えることを可能にし、従来のアテンション行列という2次元の構造をより高次な空間へと拡張しました。 実験では、視覚モデルのDeiTや言語モデルのBERTを用いた入力摂動テストにおいて、従来のアテンションロールアウトやヒューリスティックな集約手法を大幅に上回る精度でモデルの内部表現を反映できることが実証され、メカニスティックな解釈可能性の研究に新たな数学的基盤を提供しました。

なぜこの問題か

Transformerアーキテクチャは、大規模言語モデルや視覚モデルにおいて目覚ましい成果を上げてきましたが、その内部メカニズムの解明は依然として困難な課題です。特に、自己アテンション機構はトークン間の相互作用を司る中核要素として広く研究されてきましたが、既存の分析手法の多くは、個別のヘッドや特定の層といった断片的な部分にのみ焦点を当ててきました。モデル全体の挙動を包括的に理解するためには、これらの断片を統合する必要がありますが、従来の手法ではアテンション行列を単純に平均化したり掛け合わせたりするヒューリスティックな集約に頼ることが多く、数学的な厳密さが不足していました。 さらに、Transformerは自己アテンションだけでなく、フィードフォワードネットワーク(FFN)、レイヤー正規化(LayerNorm)、残差接続といった多様なサブコンポーネントで構成されています。これまでの研究では、アテンション行列のみを分析対象とすることが一般的であり、モデルの計算能力の大部分を占めるFFNや、数値的安定性を支える正規化層の影響が無視されがちでした。…

核心:何を提案したのか

本研究の核心的な提案は、Transformer全体を単一の入力依存型線形オペレータとして再定義する「TensorLens」という新しい理論的枠組みです。これは、モデルの計算過程を4階のアテンション相互作用テンソルとして表現するものであり、従来のアテンション行列という2次元の構造を、より高次なテンソル空間へと拡張したものです。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related