エージェント型人工知能における意味不変性の評価

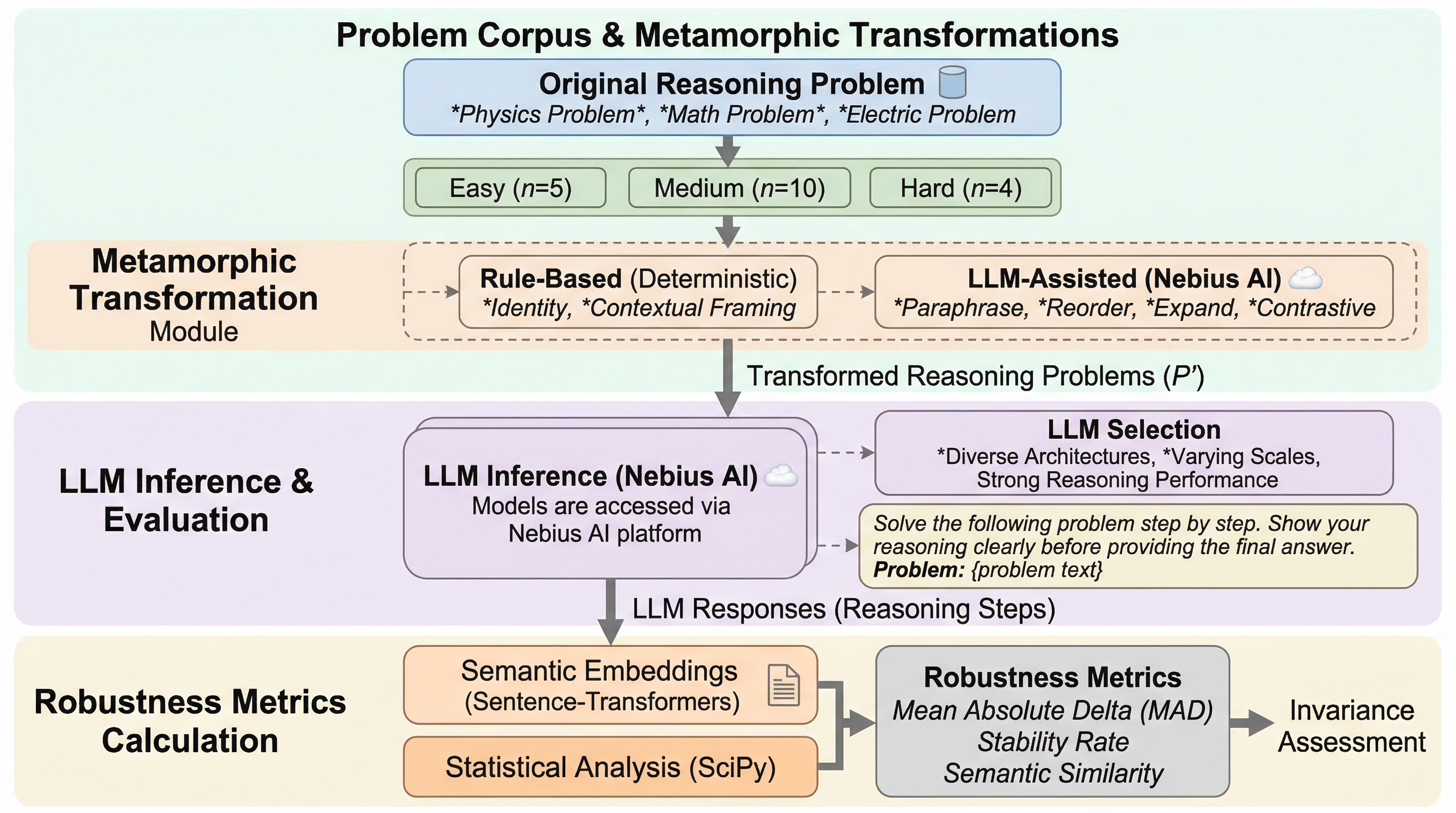

意味が同じ入力変形に対して推論がどれだけ安定するかを「意味不変性」として捉え、エージェント型AIの信頼性を測る独立した評価軸として提示しました。 / 8種類の意味保存変換を用いた変成的テストにより、7つの基盤モデルを19問・8科学領域で比較し、固定ベンチマークの正答率だけでは見えない脆さを可視化しました。

TL;DR(結論)

- 意味が同じ入力変形に対して推論がどれだけ安定するかを「意味不変性」として捉え、エージェント型AIの信頼性を測る独立した評価軸として提示しました。

- 8種類の意味保存変換を用いた変成的テストにより、7つの基盤モデルを19問・8科学領域で比較し、固定ベンチマークの正答率だけでは見えない脆さを可視化しました。

- 結果として、モデルの大きさは頑健性を予測せず、小型のQwen3-30B-A3Bが最も安定し、79.6%の不変応答と0.91の平均意味類似度を示しました。

なぜこの問題か

大規模言語モデルは、単なる文章生成の道具ではなく、段階的に考え、情報を整理し、課題を解く「推論エージェント」として使われる場面が増えています。意思決定支援、科学的な問題解決、複数エージェントが役割分担しながら協調する設定では、最終的な答えだけでなく、入力の受け取り方に対する安定性も重要になります。同じ意味の問いであるにもかかわらず、表現の違いだけで結論や推論の流れが変わるなら、そのエージェントは実運用で信頼しにくくなります。

核心:何を提案したのか

本論文の中心的な提案は、エージェント型大規模言語モデルに対して「意味不変性」を評価する包括的な枠組みを導入したことです。意味不変性とは、入力表現が変わっても、その変化が意味を保つものである限り、モデルの推論や応答も本質的に一貫していてほしい、という考え方です。この性質を定量的に見るために、著者らはソフトウェア検証で知られる変成的テストを、言語モデルの推論評価へと持ち込みました。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related