PTQ4ARVG: 自己回帰型視覚生成モデルのための学習後量子化フレームワーク

自己回帰型視覚生成(ARVG)モデルは、拡散モデルに匹敵する性能を持つ一方で、巨大なモデルサイズと推論時の計算コストが課題となっており、既存の量子化手法ではチャネル間の外れ値や動的なアクティベーション、サンプル間の分布の不一致を十分に解決できていない。

TL;DR(結論)

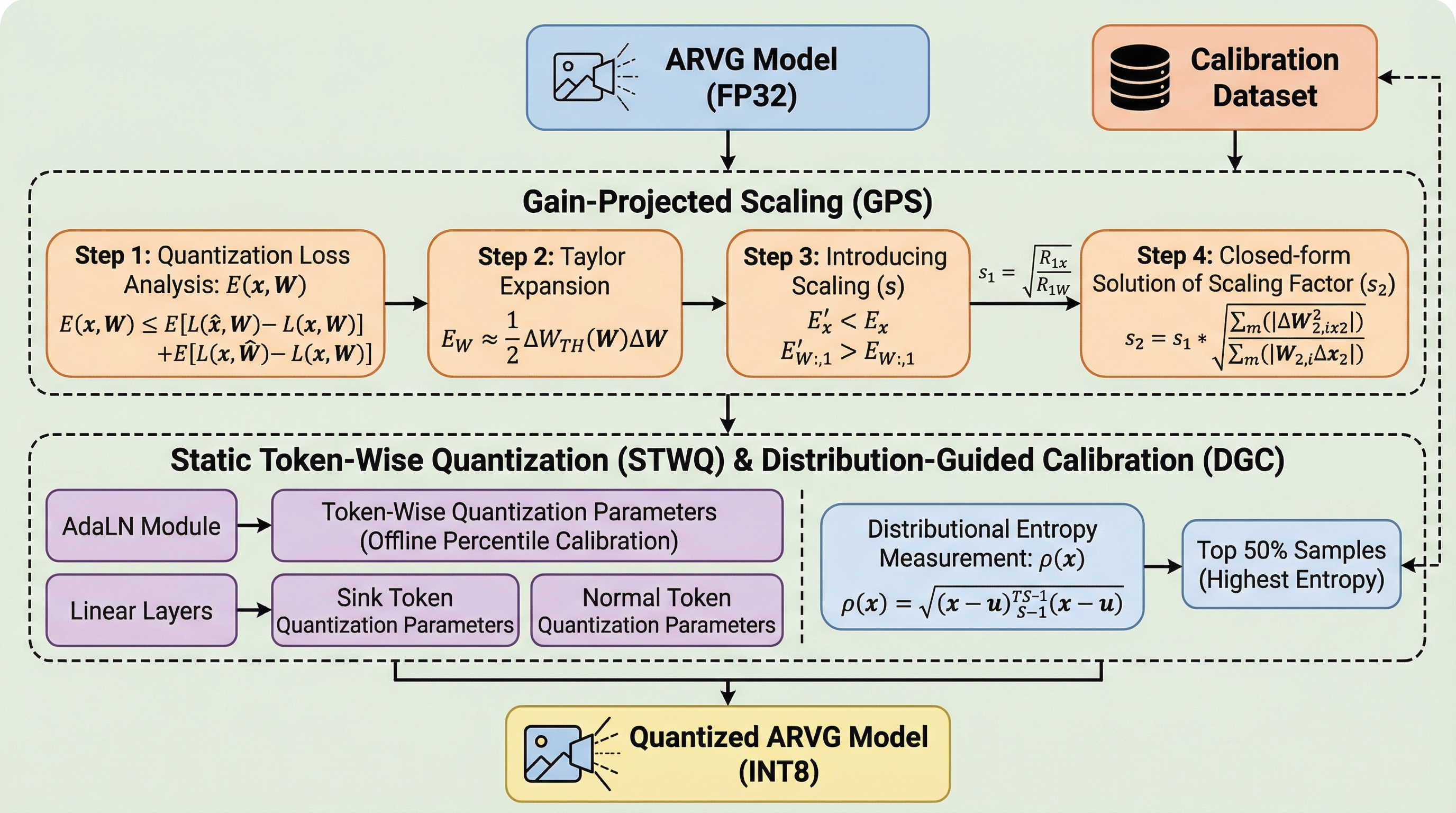

自己回帰型視覚生成(ARVG)モデルは、拡散モデルに匹敵する性能を持つ一方で、巨大なモデルサイズと推論時の計算コストが課題となっており、既存の量子化手法ではチャネル間の外れ値や動的なアクティベーション、サンプル間の分布の不一致を十分に解決できていない。 本論文が提案する「PTQ4ARVG」は、数学的最適化に基づくスケーリング手法(GPS)、固定トークン長を活用した静的なトークン単位量子化(STWQ)、エントロピーに基づくサンプル選択(DGC)を組み合わせた、追加学習を必要としない包括的な量子化フレームワークである。 検証の結果、VAR、RAR、PAR、MARといった主要なARVGモデル群において、性能を維持したまま8ビットおよび6ビットへの量子化に成功し、標準的なCUDAカーネルとの互換性を保ちながら、メモリ使用量と計算遅延の大幅な削減を可能にしている。

なぜこの問題か

近年、大規模言語モデル(LLM)の成功に触発され、視覚生成の分野でも自己回帰パラダイムへの回帰が進んでいる。VAR-d30(20億パラメータ)、RAR-XXL(15億パラメータ)、MAR-Huge(10億パラメータ)といった自己回帰型視覚生成(ARVG)モデルが登場し、画像生成において最先端の拡散モデルを凌駕する性能を示している。しかし、これらのモデルはパラメータ数が膨大であることに加え、トークンを逐次的に予測する性質上、メモリ消費量と計算の遅延が非常に大きく、リソースの限られたデバイスへの展開を困難にしている。例えば、30億パラメータを持つPARモデルでは、1枚の画像を生成するのに3秒以上の時間を要する場合がある。 この問題を解決するために、浮動小数点パラメータを整数に変換する量子化技術が注目されている。量子化には、モデルの再学習を伴う量子化を意識した学習(QAT)と、少量の校正データのみを使用する学習後量子化(PTQ)がある。QATは高い精度を維持できるが、膨大な学習データと計算リソースを必要とするため、巨大なARVGモデルを圧縮する手法としてはPTQの方が望ましい。…

核心:何を提案したのか

本論文では、ARVGモデル群のために特別に設計された、追加学習を必要としない初の包括的なPTQフレームワーク「PTQ4ARVG」を提案している。このフレームワークは、前述の3つの課題を解決するために、数学的理論に基づいた3つの主要コンポーネントで構成されている。 一つ目は「利得投影スケーリング(Gain-Projected Scaling: GPS)」である。これは、量子化におけるスケーリングの効果を数学的に分析し、解析的な微分を通じて最適なスケーリング係数を導出する手法である。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related