独立でない完全分散データに対するワンショット連合クラスタリング

連合学習におけるクラスタリングにおいて、データが複数のクライアントに断片化して分布し、粒度が一致しない「Non-ICD(非独立完全分散)」という新たな課題を定義し、既存手法がこの状況下で大幅に精度を低下させることを明らかにしました。

TL;DR(結論)

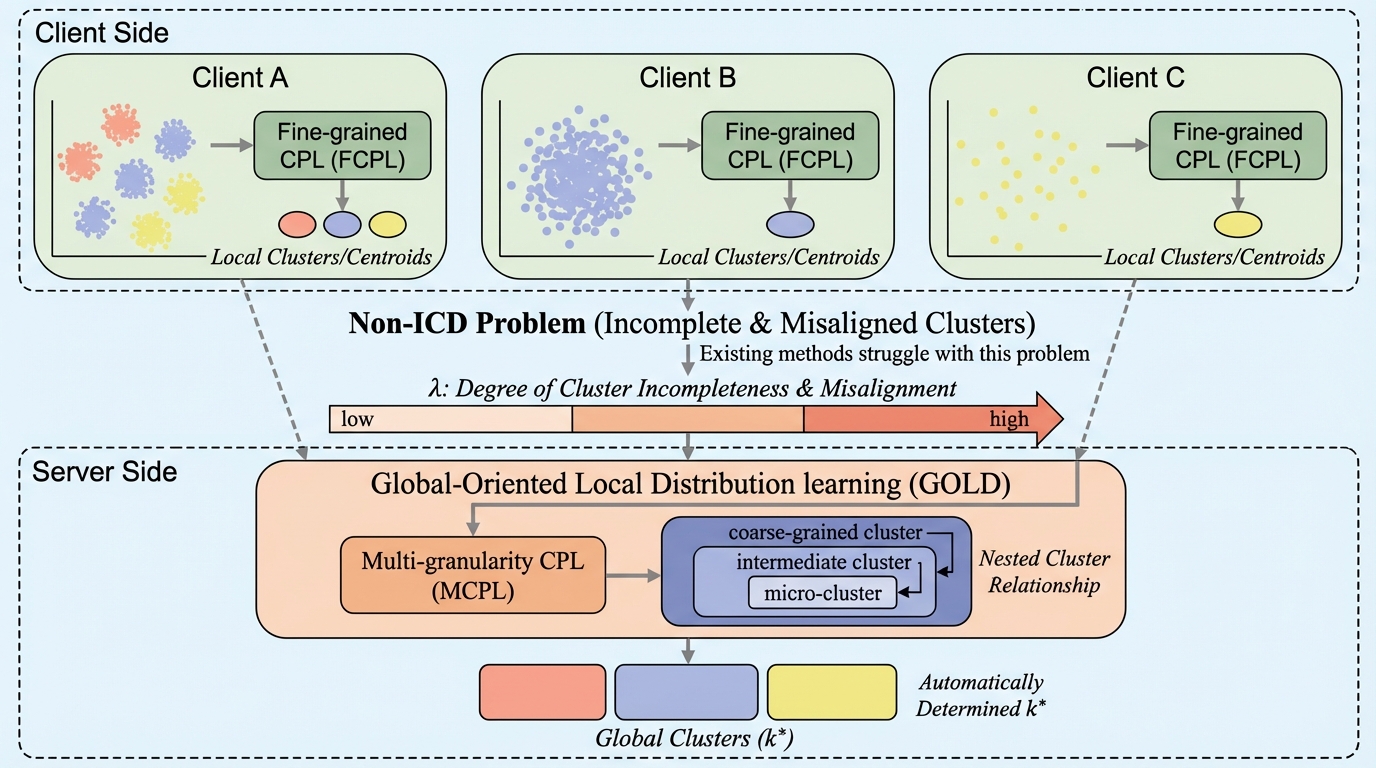

連合学習におけるクラスタリングにおいて、データが複数のクライアントに断片化して分布し、粒度が一致しない「Non-ICD(非独立完全分散)」という新たな課題を定義し、既存手法がこの状況下で大幅に精度を低下させることを明らかにしました。 この問題に対処するため、競合ペナルティ学習(CPL)を導入し、クライアント側での微細な分布探索(FCPL)とサーバー側での多粒度な統合(MCPL)を一度の通信で行う、プライバシー保護と高精度を両立した新フレームワーク「GOLD」を提案しました。 広範な実験の結果、GOLDは最適なクラスター数が未知の状況でも自動的に適切な構造を導き出し、Non-ICDの度合いが高まる環境下において既存の最先端手法と比較して10%以上の精度向上を達成し、解釈可能な入れ子状のクラスター関係を提供することを確認しました。

なぜこの問題か

現代のIoTシステムやエッジコンピューティングの普及に伴い、スマートトラフィック監視やスマートグリッドの負荷分散など、分散したデバイスから得られる膨大なデータを活用する重要性が高まっています。しかし、これらのデバイスから収集されるデータの多くはラベルが付与されておらず、プライバシー保護の観点からデータを一箇所に集約することも困難です。そのため、各クライアントのプライバシーを守りながらデータの知識を抽出する連合学習(FL)や、その教師なし学習形態である連合クラスタリング(FC)が注目されています。 従来の連合クラスタリングにおける最大の障壁は、データが独立同一分布に従わない「Non-IID」問題でした。既存の研究の多くは、各クライアントが持つクラスターの分布は偏っているものの、個々のクラスター自体は局所的に完全な形で存在していると仮定してきました。しかし、現実のデータ分布はより複雑であり、一つの大きなクラスターが複数のクライアントに断片化して存在している場合があります。本論文では、この現象を「Non-ICD(Non-Independent Completely Distributed:非独立完全分散)」と定義しました。…

核心:何を提案したのか

本論文では、Non-ICD問題と最適なクラスター数(k*)が未知であるという二つの課題を同時に解決するため、「GOLD(Global Oriented Local Distribution Learning)」という新しいワンショット連合クラスタリングフレームワークを提案しました。GOLDの核心的なアイデアは、学習プロセス全体に「競合ペナルティ学習(CPL:Competitive Penalized Learning)」を導入することにあります。 CPLは、候補となるクラスター同士を競わせ、データサンプルを引き付け合う仕組みです。この過程で、データの密度が低くコンパクトさに欠けるクラスターは反復的に排除されていきます。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related