既製の画像変換モデルだけで画像保護方式を回避できてしまう可能性について

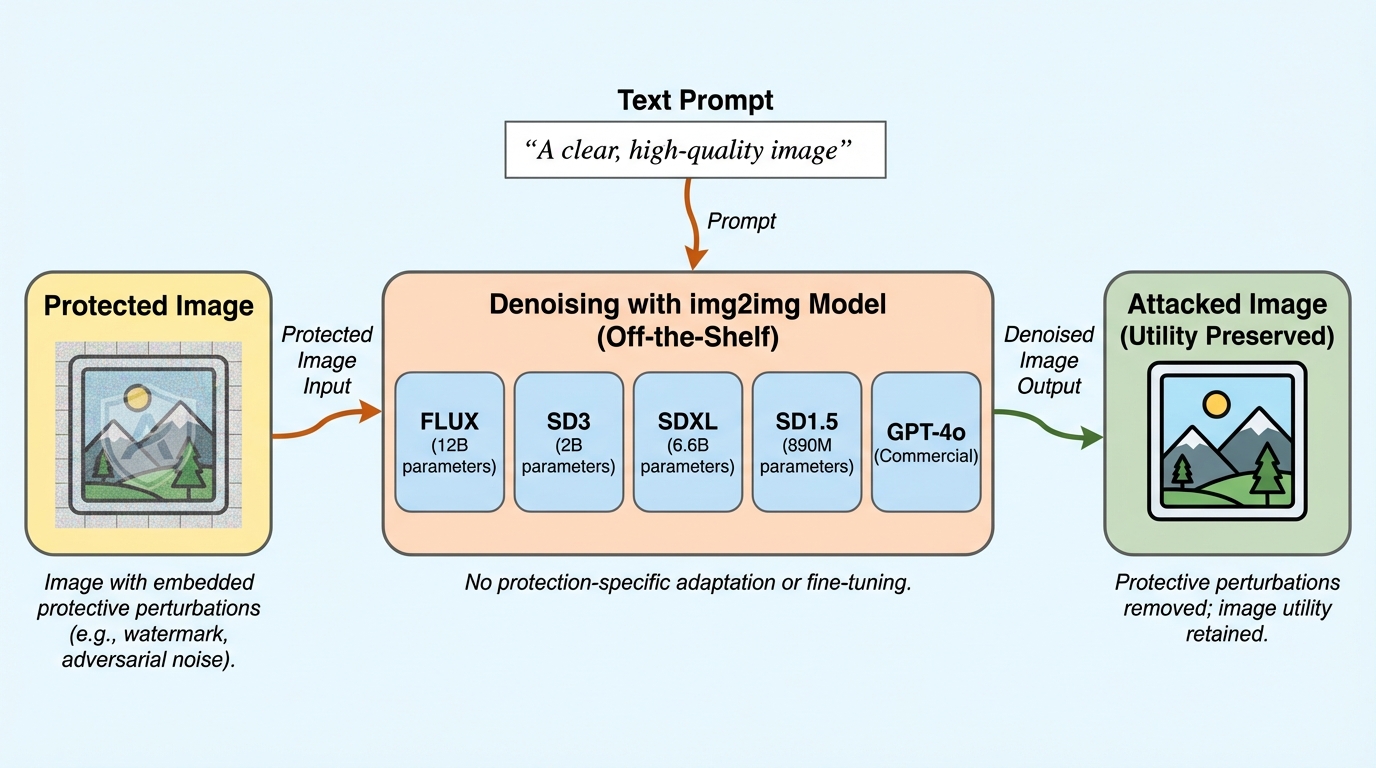

画像に知覚しにくい保護用の摂動を加えて無断利用を防ぐ方式は、既製の画像から画像への生成モデルをそのまま「汎用のノイズ除去器」として使う攻撃で、幅広く除去され得ることが示されています。 / 保護済み画像を入力し、ノイズを取り除く趣旨の簡単なテキスト指示で画像変換を行うだけで、方式の内部を知らず追加学習もしないまま、保護摂動がノイズとして処理されてしまう状況が複数の事例で確認されています。 / 6種類の保護方式にまたがる8つのケーススタディで回避が示され、方式特化の除去攻撃より良い結果も報告されているため、現行の保護が「安全だと思い込ませる」危険があり、今後の防御は既製モデル攻撃を前提に評価すべきだと述べられています。

TL;DR(結論)

- 画像に知覚しにくい保護用の摂動を加えて無断利用を防ぐ方式は、既製の画像から画像への生成モデルをそのまま「汎用のノイズ除去器」として使う攻撃で、幅広く除去され得ることが示されています。

- 保護済み画像を入力し、ノイズを取り除く趣旨の簡単なテキスト指示で画像変換を行うだけで、方式の内部を知らず追加学習もしないまま、保護摂動がノイズとして処理されてしまう状況が複数の事例で確認されています。

- 6種類の保護方式にまたがる8つのケーススタディで回避が示され、方式特化の除去攻撃より良い結果も報告されているため、現行の保護が「安全だと思い込ませる」危険があり、今後の防御は既製モデル攻撃を前提に評価すべきだと述べられています。

なぜこの問題か

生成系の画像モデルが普及したことで、ウェブ上の画像が許可・クレジット・補償なしに収集され得るという懸念が強まっています。さらに、個人の写真を改変して本人の被害につながるディープフェイク、同意のない作風の模倣、オンラインコミュニティに有害な画像の生成など、悪用の形が多様だと整理されています。こうした状況を受け、画像の無断利用を妨げるための保護戦略が多数提案されてきました。例として、防御的なウォーターマーキング、作風模倣の緩和、個人画像のディープフェイク改変防止、モデル個人化に悪用された場合の追跡可能性、顔のプライバシー保護などが挙げられています。 これらの多くに共通する考え方は、画像に「保護用の摂動」または「保護クローク」を与え、見た目を大きく変えずに下流の生成パイプラインでの不正利用を妨げることです。一方で、防御側には「画像を守る機会が一度しかない」という厳しさがあります。攻撃者が保護を除去できてしまえば、その後の再配布や再利用に対して防御が効かなくなるからです。近年、一部の方式が安全であるかのような誤解を与え得ることも示され始めていますが、従来は方式ごとに専用の除去手法を作り込む必要がある場合が多いとされてきました。…

核心:何を提案したのか

著者らが示した中心的な主張は、既製の画像から画像への生成モデルを、汎用の「ノイズ除去器」として転用できるという点です。具体的には、保護済み画像を画像変換モデルに入力し、「ノイズを除去してほしい」趣旨の簡単なテキスト指示で変換を行うだけで、多様な保護摂動が除去され得ると述べています。重要なのは、攻撃が保護方式の内部設計や実装の知識を前提にせず、方式ごとの適応や追加の学習、微調整を要しないことです。このため、攻撃者の技能が高くなくても、複数の保護方式に対して同種の手順で回避を試みられる可能性があると位置づけられています。 検討は、6種類の保護方式にまたがる8つのケーススタディで実施されたとされています。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related