マージを超えて:アクティベーション誘導回転によるストリーミングLLMアップデート

大規模言語モデルの効率的な適応手法として、モデルマージを単なる事後処理ではなく、反復的な最適化プロセスとして再定義する「ストリーミング・マージ」という新しい枠組みが提案されました。 中核技術である「ARM(アクティベーション誘導回転認識マージ)」は、モデル内部の活動差分から回転行列を導出し、従来の線形補間では到達不可能だった幾何学的な性能限界を突破して勾配降下法の動態を近似します。 実験では、学習初期のチェックポイントのみを用いたマージによって、完全に収束した教師あり微調整(SFT)モデルの性能を上回るという、計算効率と高精度を両立した画期的な結果が示されました。

TL;DR(結論)

大規模言語モデルの効率的な適応手法として、モデルマージを単なる事後処理ではなく、反復的な最適化プロセスとして再定義する「ストリーミング・マージ」という新しい枠組みが提案されました。 中核技術である「ARM(アクティベーション誘導回転認識マージ)」は、モデル内部の活動差分から回転行列を導出し、従来の線形補間では到達不可能だった幾何学的な性能限界を突破して勾配降下法の動態を近似します。 実験では、学習初期のチェックポイントのみを用いたマージによって、完全に収束した教師あり微調整(SFT)モデルの性能を上回るという、計算効率と高精度を両立した画期的な結果が示されました。

なぜこの問題か

大規模言語モデル(LLM)の規模が拡大し続ける現代において、特定のタスクやドメインにモデルを適応させるための計算コストは膨大なものとなっています。教師あり微調整(SFT)は高い性能を発揮しますが、バックプロパゲーションを伴う重い計算資源を必要とします。これに対し、複数のモデルを統合する「モデルマージ」は、追加の学習を必要としない効率的な手法として注目されてきました。しかし、既存のマージ技術には、主に二つの大きな課題が存在しています。 第一に、従来の手法の多くは「線形補間」や「算術平均」に基づいています。これは、マージされたモデルが、元のチェックポイントが形成する「アフィン空間」と呼ばれる平坦な部分空間の中に閉じ込められてしまうことを意味します。実際の学習プロセスにおける勾配降下法は、高次元で複雑に湾曲した損失関数の地形を探索しますが、線形なマージではこの動的な進化を再現できず、性能の「天井」に突き当たってしまいます。 第二に、既存のデータ駆動型マージは、マージを一回限りの操作として扱うことが多く、学習のように段階的にモデルを洗練させていく視点が欠けていました。…

核心:何を提案したのか

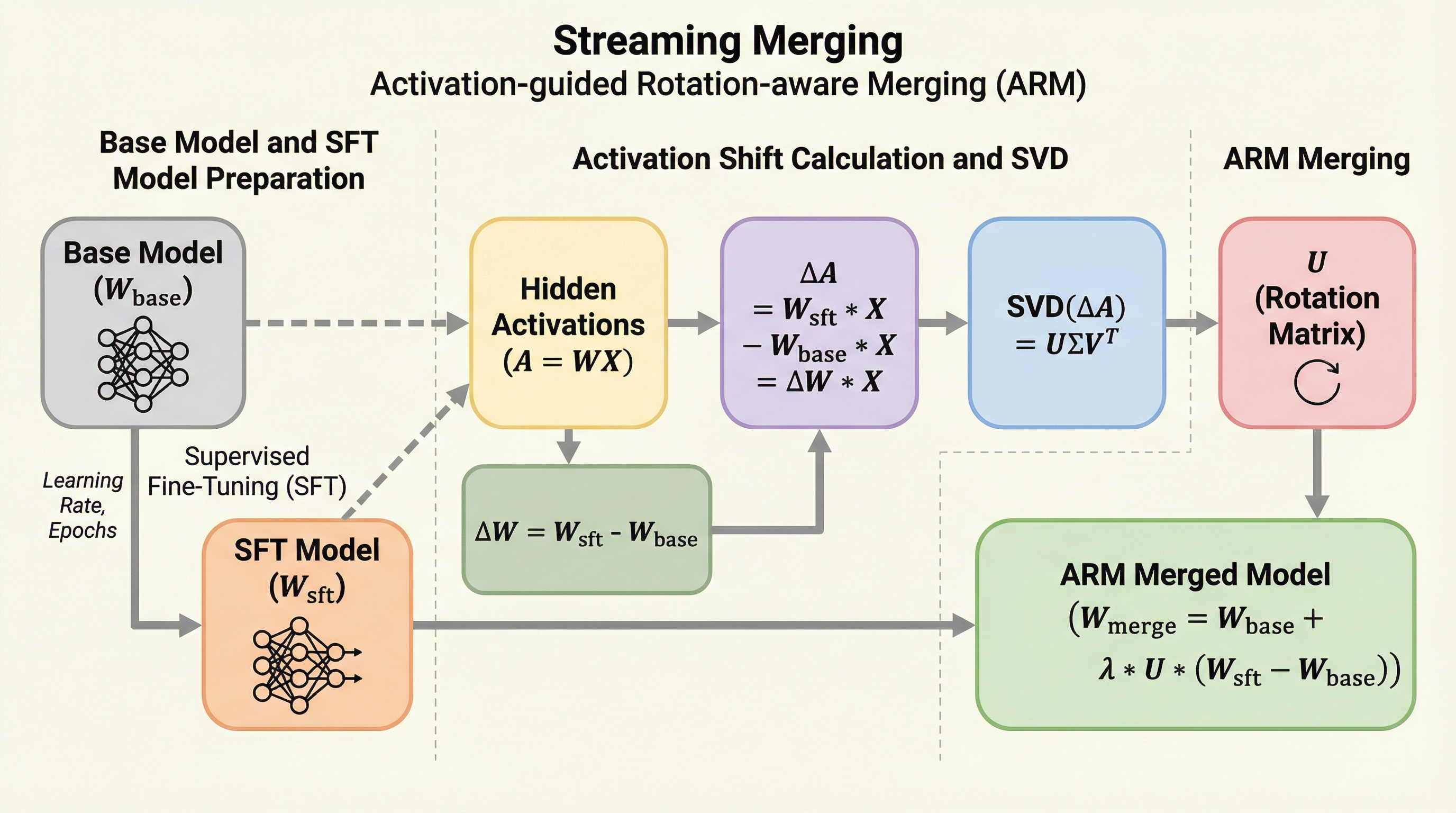

本研究の最大の貢献は、モデルマージを静的な統合手法から、反復的で幾何学的な構造を考慮した最適化プロセスへと再定義する「ストリーミング・マージ(Streaming Merging)」というパラダイムを提案したことです。この枠組みは、計算コストの高い再学習を行うことなく、少量のキャリブレーションデータと既存のチェックポイントのみを用いて、モデルを継続的に進化させることを可能にします。 このパラダイムを支える具体的なアルゴリズムが「ARM(Activation-guided Rotation-aware Merging)」です。ARMは、モデルの内部層で発生するアクティベーション(中間出力)の情報を活用して、パラメータの「回転」を制御します。具体的には、マージ係数を学習率のように扱い、アクティベーションの差分から導き出された回転ベクトルを用いて、パラメータの更新方向をデータ駆動型の軌跡に沿って精密に誘導します。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related