トランスフォーマーにおける記憶の想起:符号化特定性原理からの知見

トランスフォーマー型大規模言語モデルのアテンション層が、人間の記憶システムと同様の役割を担っていることを明らかにしました。具体的には、クエリが検索の文脈を符号化し、キーが記憶のインデックスとして機能し、バリューが実際の内容を保持するという明確な役割分担が存在します。

TL;DR(結論)

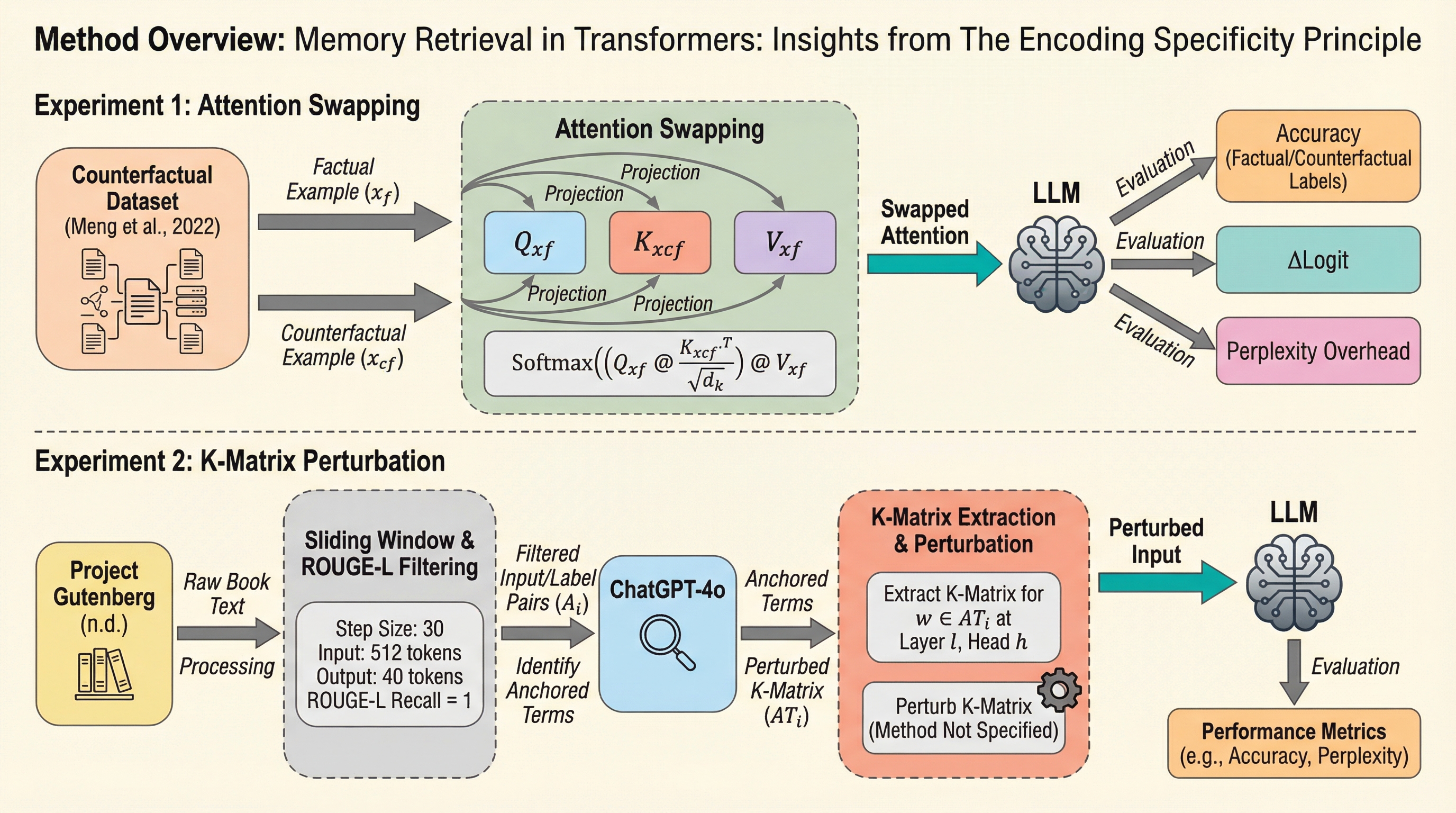

トランスフォーマー型大規模言語モデルのアテンション層が、人間の記憶システムと同様の役割を担っていることを明らかにしました。具体的には、クエリが検索の文脈を符号化し、キーが記憶のインデックスとして機能し、バリューが実際の内容を保持するという明確な役割分担が存在します。心理学の「符号化特定性原理」に基づき、特定のキーワードが記憶を呼び出すための重要な手がかり(キュー)として機能しているという仮説を立て、実験を通じて実証しました。アテンション層内の特定のニューロンがこれらのキーワードを選択的に処理しており、このメカニズムを操作することで、モデルの記憶を精密に制御したり、プライバシー保護のためのマシンアンラーニングに応用したりする道が開かれました。

なぜこの問題か

大規模言語モデル(LLM)は、その驚異的な能力の一方で、内部プロセスが不透明な「ブラックボックス」として扱われてきました。この不透明性は、モデルの安全性、プライバシー保護、そして説明責任の観点から大きな課題となっています。特に、欧州の一般データ保護規則(GDPR)などの規制が強化される中で、モデルから特定の個人情報や著作権情報を削除する「マシンアンラーニング」の必要性が急速に高まっています。しかし、既存のアンラーニング手法は、データの完全な消去を保証できないばかりか、モデルの他の能力を損なったり、新たな脆弱性を生み出したりするリスクが指摘されていました。 これまで、説明可能なAI(XAI)の研究は、主にフィードフォワードニューラルネットワーク(FFNN)層に焦点を当ててきました。先行研究では、FFNN層がキー・バリューメモリとして機能し、言語パターンの照合や概念の促進を行っていることが示されています。しかし、トランスフォーマーの核心であるアテンション層が、具体的な事実情報の記憶と想起においてどのような役割を果たしているのかについては、十分に解明されていませんでした。…

核心:何を提案したのか

本研究の核心は、トランスフォーマーのアテンションメカニズムを、人間の認知プロセスにおける「符号化」「定着」「想起」という3つの段階に対応したメモリ機能として再定義した点にあります。具体的には、クエリ(Q)が検索の手がかりを符号化し、キー(K)がそれらの手がかりに基づいて候補となる記憶痕跡にインデックスを付け、バリュー(V)が想起されるべき具体的な内容を保持しているという役割分担を定義しました。このフレームワークにより、ブラックボックスだったアテンション層の動作を、人間の記憶メカニズムに準拠した形で解釈することが可能になります。 この提案の理論的支柱となっているのが、心理学における「符号化特定性原理(ESP)」です。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related