MALLOC: 大規模シーケンシャル推薦のためのメモリ効率を考慮した長文脈圧縮ベンチマーク

大規模シーケンシャル推薦システムにおいて、ユーザーの長い行動履歴を扱う際の計算コスト増大とメモリ消費の爆発という「メモリと遅延のジレンマ」を解決するため、メモリ効率を重視した包括的な圧縮技術の評価枠組みであるMALLOCを提案した。

TL;DR(結論)

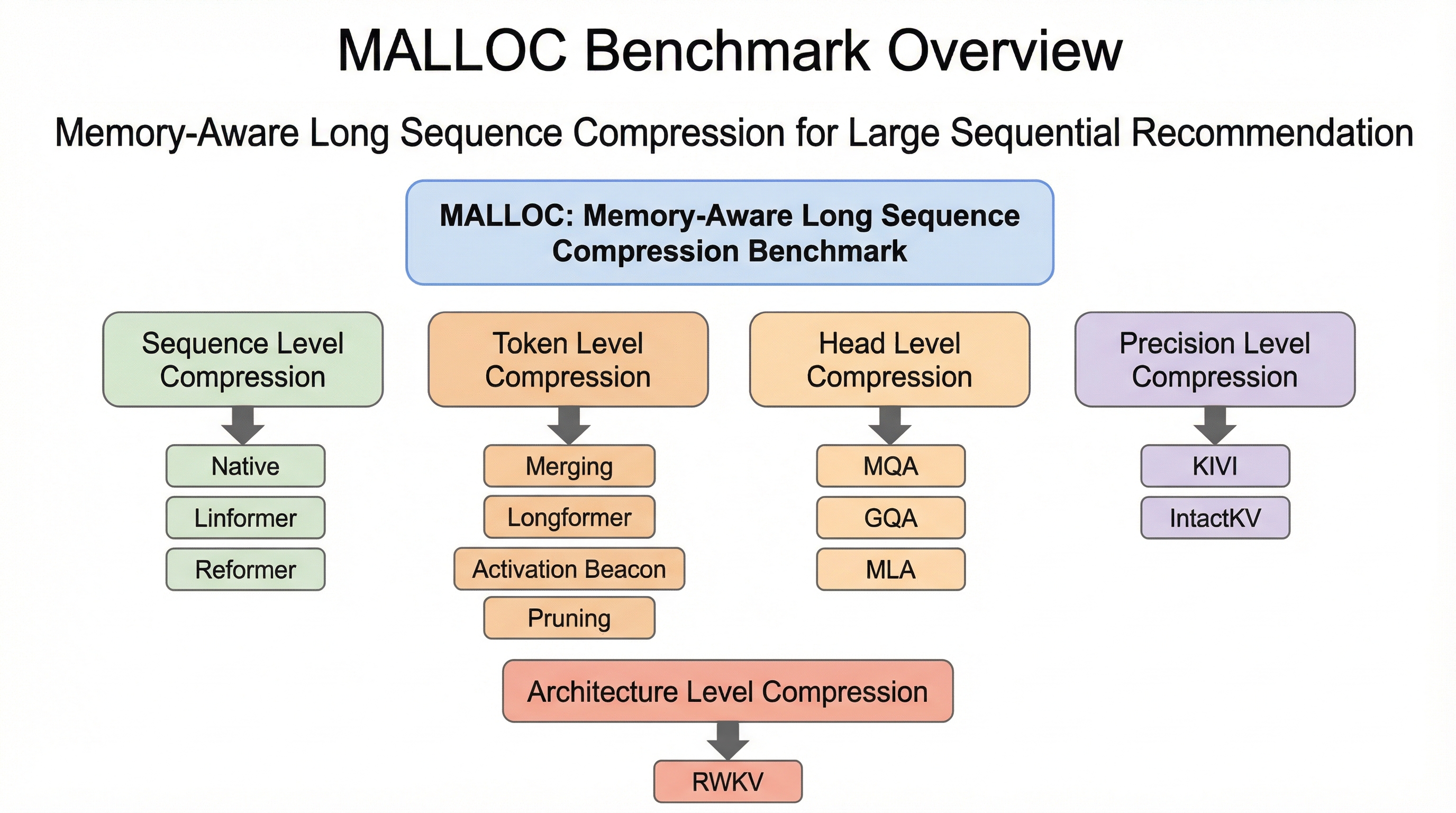

大規模シーケンシャル推薦システムにおいて、ユーザーの長い行動履歴を扱う際の計算コスト増大とメモリ消費の爆発という「メモリと遅延のジレンマ」を解決するため、メモリ効率を重視した包括的な圧縮技術の評価枠組みであるMALLOCを提案した。 既存の圧縮手法をシーケンス、トークン、ヘッド、精度、アーキテクチャという5つの粒度で体系的に分類し、推薦精度だけでなく推論効率、メモリ占有量、および実装の複雑さを多角的に評価する統一的なプラットフォームを構築した。 複数の大規模データセットを用いた実験により、精度とリソースのトレードオフを可視化し、特にトークンレベルのプルーニングや精度レベルの量子化が、情報の損失を抑えつつリソース消費を劇的に削減できることを明らかにし、実用的なシステム設計指針を提示した。

なぜこの問題か

近年、モデルの規模やデータ量を増やすことで性能が指数関数的に向上するという「スケーリング則」に基づき、推薦システムの大規模化が産業界と学術界の両方で加速している。従来の推薦システムは、特徴量エンジニアリングに依存した小規模なモデルが主流であったが、現在はユーザーの膨大な行動履歴を直接モデル化するパラメータ中心のアプローチへとパラダイムシフトが起きている。特に、Eコマースや動画配信サービスにおいては、ユーザーの長期的な意図や周期的な行動パターンを正確に捉えるために、数千件に及ぶ長いインタラクション履歴を考慮することが極めて重要となっている。しかし、標準的なアテンション機構を用いた大規模推薦モデルでは、シーケンス長が長くなるにつれて計算コストが二乗で増加するという深刻な数学的課題に直面する。 具体的には、本研究の予備実験において、シーケンス長1,024、バッチサイズ1,000という実用的な条件下で、過去の状態をすべて保存するフルキャッシュ方式を採用した場合、545GBもの膨大なメモリが必要になることが示された。これは一般的な単一ノードのGPUメモリ容量を大幅に超えており、物理的なリソースの限界を露呈させている。…

核心:何を提案したのか

本研究では、大規模シーケンシャル推薦における長文脈圧縮技術を包括的に評価するためのベンチマーク「MALLOC」を提案した。MALLOCは、推薦システムにおける完全なユーザー行動履歴の情報を可能な限り保持しつつ、高い推論効率とメモリ節約を両立させることに特化した、この分野で初となる体系的な評価プラットフォームである。このベンチマークの核心は、これまで個別に研究されてきた多様な長文脈圧縮技術を「メモリ割り当ての粒度」という独自の視点から5つのカテゴリに再定義し、構造化した点にある。 具体的には、これまで大規模言語モデル(LLM)の文脈で議論されることが多かった最新の圧縮手法を、推薦システムのタスクに明示的に適用し、その有効性を検証している。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related