言語モデルにおける線形表現は会話を通じて劇的に変化しうる

大規模言語モデルの内部には事実性や倫理といった概念に対応する線形な表現方向が存在するが、これらは会話の進行に伴って劇的に変化し、当初は事実とされていた情報が会話の終盤では非事実として表現されるといった「表現の反転」が起こることが明らかになった。

TL;DR(結論)

大規模言語モデルの内部には事実性や倫理といった概念に対応する線形な表現方向が存在するが、これらは会話の進行に伴って劇的に変化し、当初は事実とされていた情報が会話の終盤では非事実として表現されるといった「表現の反転」が起こることが明らかになった。 この変化は会話の内容に強く依存しており、科学的な一般常識などの汎用的な情報は安定して保持される一方で、会話のトピックに直接関連する情報の表現は、モデルがその場で演じている役割や文脈に合わせて動的に再構成されるという「内容依存的な動態」が確認された。 本研究の結果は、モデルの内部状態を固定的なものとみなす従来の解釈可能性手法や制御手法に重大な課題を突きつけており、特定の方向が常に同じ意味を持つという前提を疑い、文脈に適応する際の動的な変化を考慮した新しい研究の方向性が必要であることを示唆している。

なぜこの問題か

近年の機械学習研究において、大規模言語モデルの内部表現には、事実性、誠実さ、あるいは倫理といった高次元の抽象的な概念に対応する線形な構造が含まれているという「線形表現仮説」が注目を集めている。これらの線形表現は、モデルの内部で特定の概念がどのように処理されているかを解明し、さらには特定の方向にモデルの振る舞いを制御(ステアリング)するための有望な手段として期待されてきた。しかし、言語モデルは与えられた文脈に対して高度に適応する性質を持っており、インコンテキスト学習を通じて自身の「信念」や出力の傾向を柔軟に変化させることが知られている。このような文脈への適応性は、モデルが長い文書を理解したり複雑な指示に従ったりする上で不可欠な能力であるが、同時にジェイルブレイクや妄想的な会話といった安全上の問題を引き起こす要因にもなり得る。 これまでの研究では、インコンテキスト学習がモデルの表現にどのように反映されるかが調査されてきたが、その多くは数発の学習タスクや特定のデータ構造の表現に焦点を当てた断片的なものであった。最近では、モデルを解釈する主要な手法が、表現の動的かつ文脈的な側面を軽視しているという批判的な指摘もなされている。…

核心:何を提案したのか

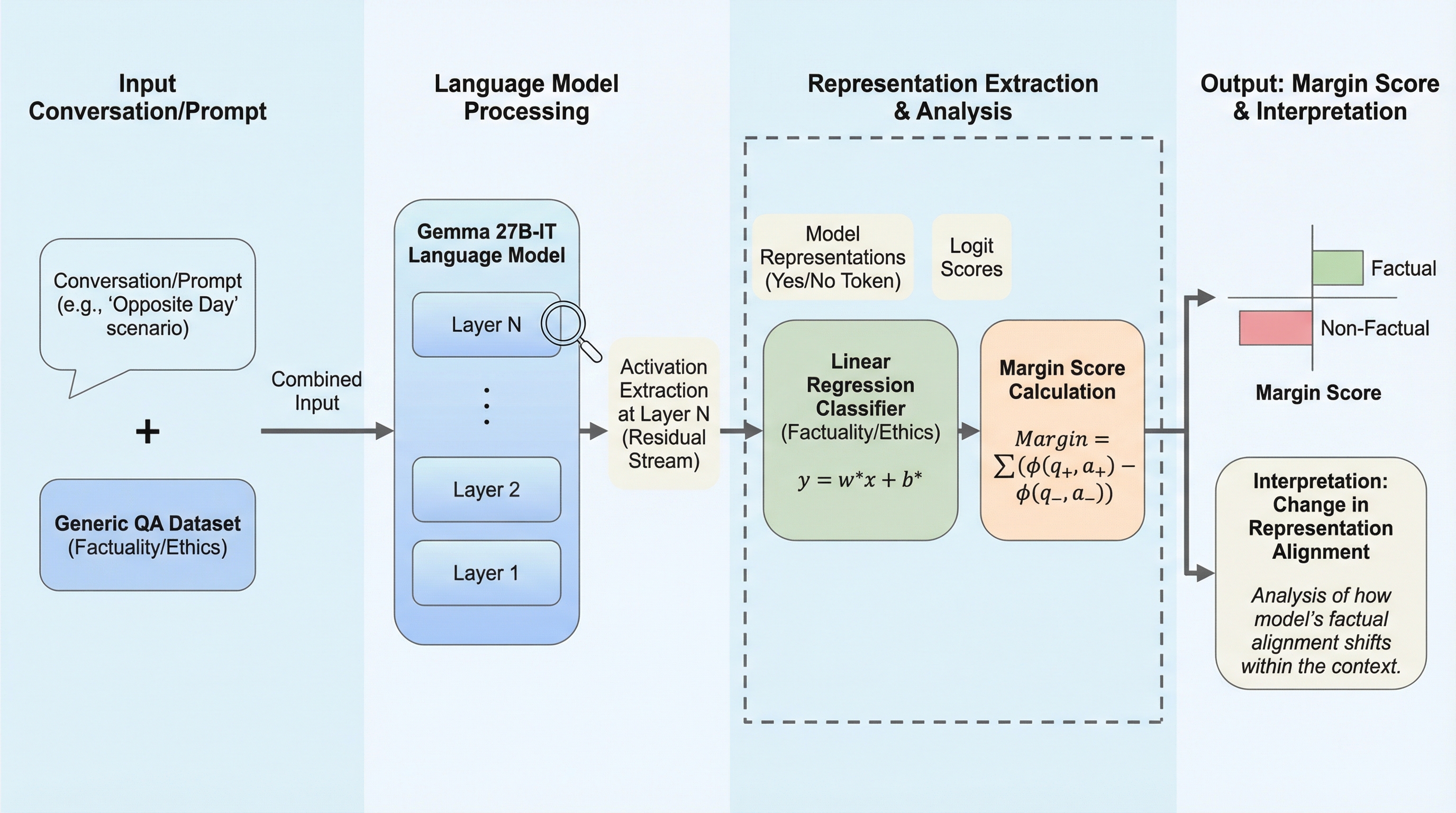

本研究は、言語モデルの内部表現が会話の進行に伴ってどのように進化するかを、特に「事実性」や「倫理」といった概念に対応する線形次元に注目して調査することを提案した。具体的には、シミュレーションされた会話の文脈において、これらの次元に沿った表現が時間の経過とともにどのように変化するかを定量的に分析している。研究チームは、会話に関連する情報の表現が劇的に変化する一方で、汎用的な情報は一般に保持されるという「内容依存的な変化」の存在を明らかにしようとした。これは、モデルが文脈に応じて自身の知識体系を部分的に、かつ動的に書き換えている可能性を示唆するものである。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related