効率的な学習型画像圧縮のための二次曲率の活用:理論と実証的根拠

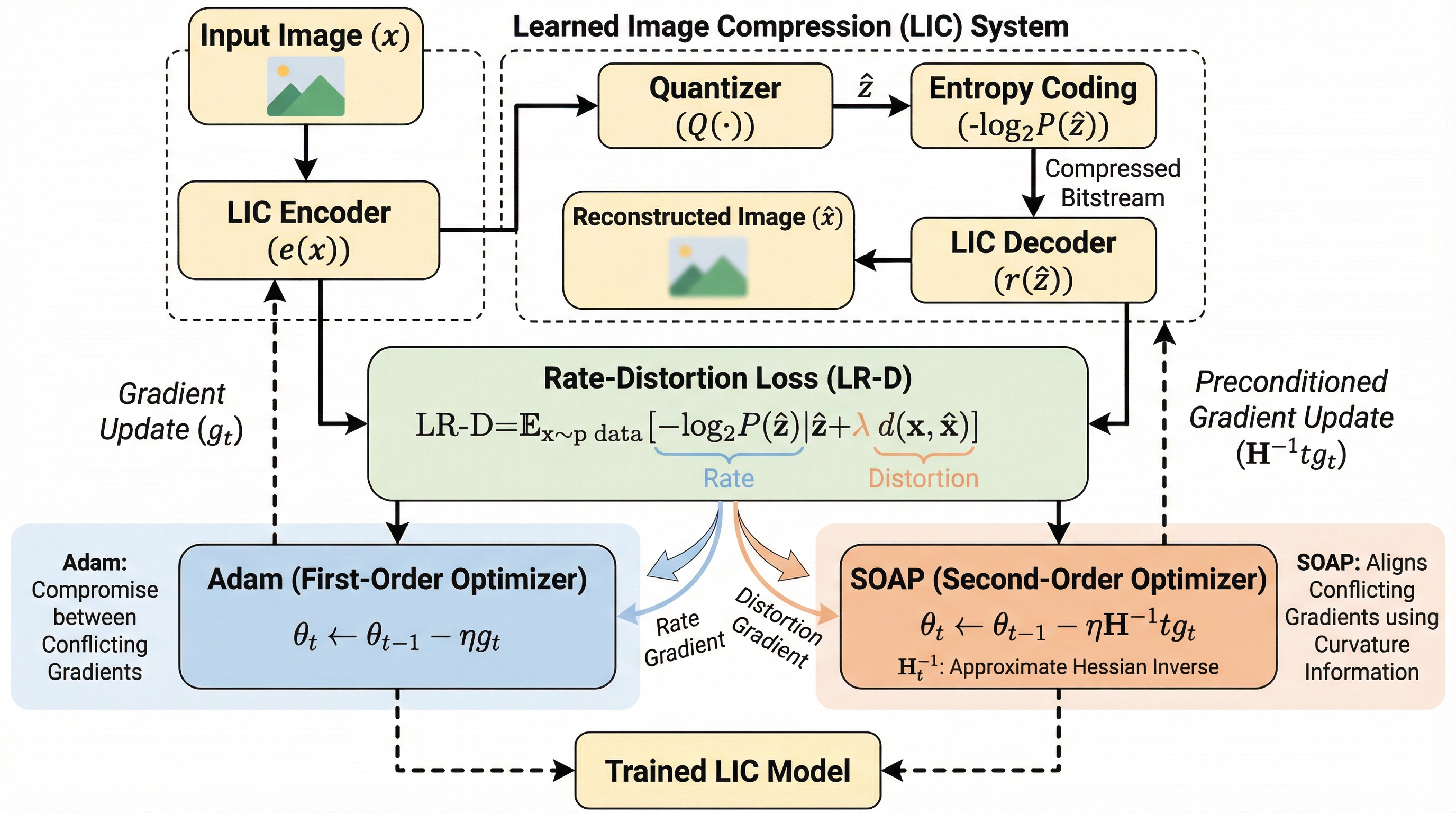

学習型画像圧縮(LIC)の訓練において、従来のAdam等の1次最適化手法はビットレートと歪みの目的関数間で生じる勾配競合により、収束の遅延や性能不足という課題を抱えていたが、本研究は2次準ニュートン最適化手法「SOAP」を導入することでこれを解決した。

TL;DR(結論)

学習型画像圧縮(LIC)の訓練において、従来のAdam等の1次最適化手法はビットレートと歪みの目的関数間で生じる勾配競合により、収束の遅延や性能不足という課題を抱えていたが、本研究は2次準ニュートン最適化手法「SOAP」を導入することでこれを解決した。 SOAPはニュートン・プレコンディショニングを用いることで、ステップ内およびステップ間の更新競合を本質的に解消し、主要なLICモデルにおいて訓練ステップ数を平均70%、実時間を57.7%削減しながら、最終的なBD-Rateを平均3%改善するという極めて高い効率性を実証した。 さらに、2次最適化には活性化値や潜在変数の外れ値を抑制する効果があり、信号伝搬理論に基づく解析によってこの特性が訓練後の量子化(PTQ)に対する堅牢性を高めることが示されたため、計算リソースの限られたハードウェアへの実用的なデプロイにおいても大きな優位性を持つ。

なぜこの問題か

学習型画像圧縮(LIC)のモデル訓練は、限られたビットレート(R)と復元画像の歪み(D)という、互いに相反する二つの目的関数の間で最適なバランスを見つけ出すという、非常に困難な最適化問題に直面している。標準的な手法では、AdamやSGDといった1次最適化手法が広く用いられているが、これらは損失関数の曲率情報を考慮せず、勾配の座標ごとの再スケーリングのみに依存している。そのため、レートと歪みの目的関数が異なる方向へパラメータを更新しようとする「勾配競合」が発生した際、効率的な降下方向を見失い、収束が著しく遅くなったり、最終的なレート歪み性能が理論的な最適値に達しなかったりする問題が常態化していた。例えば、最新のLALICモデルでは、完全なレート歪み曲線を学習するために1000時間を超えるH100 GPUのリソースが必要になるなど、計算コストの増大が研究開発の大きな障壁となっている。 先行研究では、この収束の遅さを解決するために、エネルギー圧縮を促進する補助的な変換(AuxT)を導入して特徴の無相関化を図る手法や、モデルパラメータを相関に基づいて分解して訓練空間を削減するCMD-LICのような手法が提案されてきた。…

核心:何を提案したのか

本研究の核心は、最新の効率的な2次準ニュートン最適化手法である「SOAP」を、学習型画像圧縮(LIC)の訓練プロセスに導入することを提案した点にある。SOAPの最大の特徴は、既存の訓練パイプラインにおいて標準的に使用されているAdamなどの最適化手法を、コード上の変更を最小限に抑えてそのまま置き換えるだけで利用可能な「シームレスなドロップイン置換」として機能することである。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related