プロンプトベースの継続学習において、パラメータ隔離はより優れているのか?

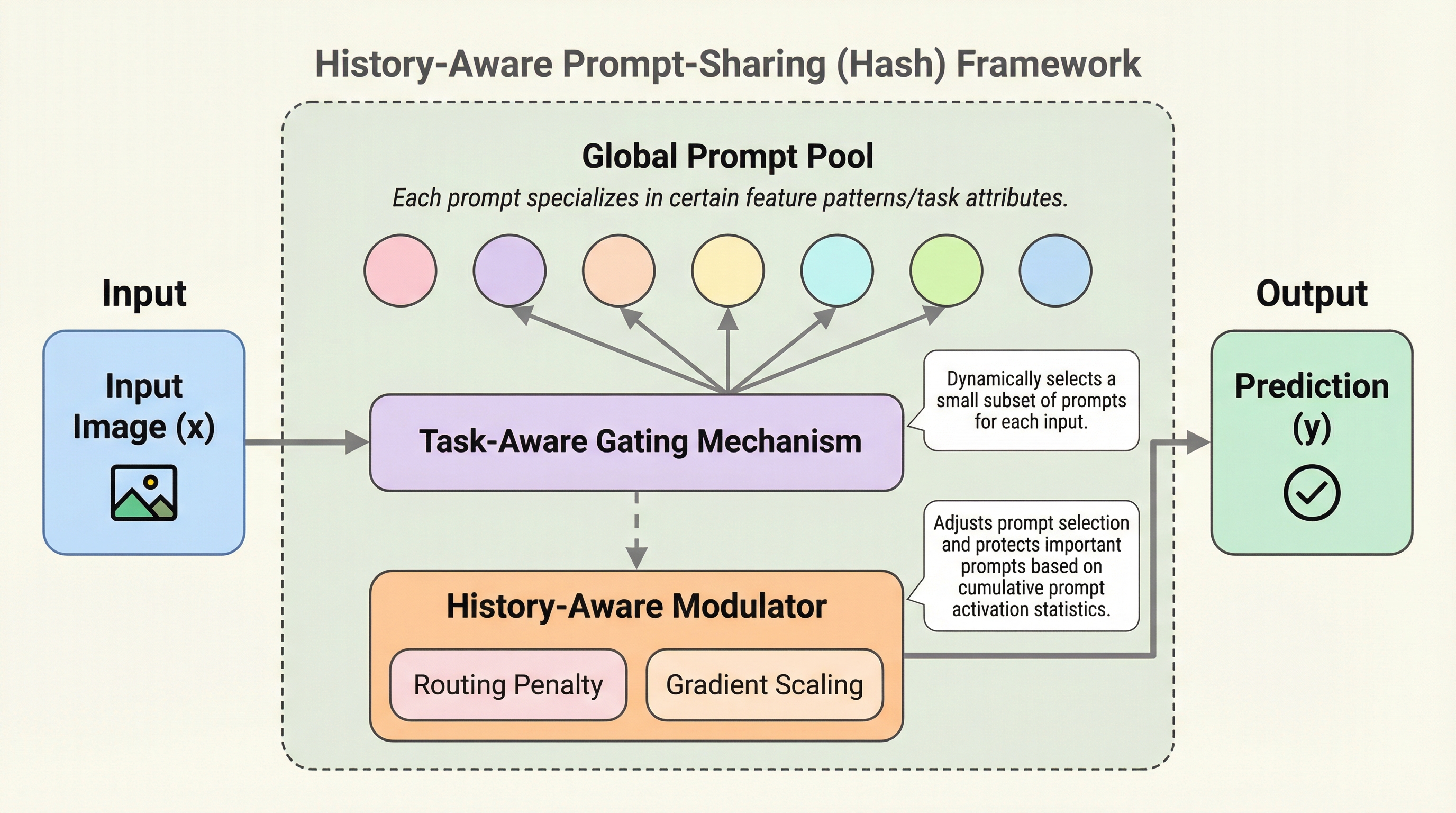

従来のプロンプトベース継続学習はタスクごとに独立したプロンプトを割り当てる手法が主流であったが、本研究では知識共有とパラメータ効率を向上させるために、グローバルなプロンプトプールを共有し、入力に応じて動的にプロンプトを選択するフレームワーク「Hash」を提案している。

TL;DR(結論)

従来のプロンプトベース継続学習はタスクごとに独立したプロンプトを割り当てる手法が主流であったが、本研究では知識共有とパラメータ効率を向上させるために、グローバルなプロンプトプールを共有し、入力に応じて動的にプロンプトを選択するフレームワーク「Hash」を提案している。 タスク認識型のゲートルーティング機構によって少数のプロンプトを疎に活性化させることで、タスク間の協調的な最適化を実現しつつ、累積的な活性化統計に基づく履歴認識型モジュレータを導入することで、頻繁に使用されるプロンプトの過剰な更新を防ぎ、破滅的忘却を効果的に抑制することに成功した。 Split CIFAR-100やSplit ImageNet-Rなどの複数のベンチマークを用いた広範な実験の結果、提案手法は既存の静的なプロンプト割り当て戦略を一貫して上回る精度とパラメータ効率を達成し、長期的な継続学習におけるスケーラビリティと知識の保持能力において優れた性能を示すことが実証された。

なぜこの問題か

継続学習(CL)における最大の課題は、新しいタスクを学習する際に過去に習得した知識が上書きされてしまう破滅的忘却である。近年、事前学習済みのバックボーンネットワークを固定したまま、少数のタスク固有のプロンプトのみを最適化するプロンプトベースの学習が、パラメータ効率と知識の分離を両立する有望な手法として注目されている。 しかし、既存の主流な手法の多くは、各タスクが独立しているという仮定に基づき、タスクごとに固定されたプロンプトのセットを割り当てる「パラメータ孤立」のアプローチを採用している。この硬直的な割り当てには、主に二つの限界が存在すると著者らは指摘している。第一に、関連するタスク間でのパラメータ共有が制限されるため、異種タスクシーケンスにおける多様な容量要件に対応できず、長期的な継続学習に必要な柔軟性が欠如している点である。 第二に、静的なプロンプト割り当てはモデル容量の利用効率を低下させる。タスクによって関連性や複雑さが異なるにもかかわらず、一律のプロンプト数を割り当てることは、計算資源の無駄や表現能力の不足を招く可能性がある。…

核心:何を提案したのか

本論文では、履歴認識型のプロンプト共有フレームワークである「Hash」を提案している。このフレームワークの核心は、すべてのタスクで共有されるグローバルなプロンプトプールを構築し、入力データに応じて最適なプロンプトの組み合わせを動的に選択する点にある。 Hashは、混合エキスパート(Mixture-of-Experts, MoE)の概念をプロンプトチューニングに導入しており、各プロンプトは特定の機能パターンやタスク属性に特化したエキスパートとして機能する。これにより、従来の静的な手法とは異なり、タスク間で知識を柔軟に構成し、再利用することが可能となる。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related