GLOVE:LLMの記憶と環境の再整合のためのグローバル検証器

大規模言語モデル(LLM)を用いたエージェントが、外部の正解ラベルやモデル自身の内省能力に過度に依存することなく、環境の変化に合わせて記憶を自律的に更新するための新しいフレームワーク「GLOVE」を提案する。

TL;DR(結論)

大規模言語モデル(LLM)を用いたエージェントが、外部の正解ラベルやモデル自身の内省能力に過度に依存することなく、環境の変化に合わせて記憶を自律的に更新するための新しいフレームワーク「GLOVE」を提案する。 検索された過去の記憶と最新の観測結果との間に生じる「認知的不協和」を検出し、能動的なプロービング(再実行)を通じて現在の環境における「相対的な真実」を構築することで、古くなった記憶を効果的に排除し、最新の状態へと再整合させる。 Webナビゲーションや離散計画、連続制御といった多様なドメインにおいて、環境のルールや構造が動的に変化する条件下での検証を行い、従来の手法と比較してエージェントのタスク成功率を大幅に向上させ、自己進化の可能性を示した。

なぜこの問題か

大規模言語モデル(LLM)を基盤としたエージェントは、Webの操作から物理的なロボット制御まで、複雑なタスクを自律的に遂行する能力を持ち始めている。これらのエージェントが長期的に活動するためには、過去の経験を記憶として蓄積し、それを将来の計画に役立てることが不可欠である。しかし、現実世界の環境は常に一定ではなく、ウェブサイトのインターフェースが更新されたり、障害物の位置が変わったりといった「環境のドリフト(変化)」が頻繁に発生する。従来のメモリシステムは、一度蓄積した情報を「固定された真実」として扱う傾向があり、環境が変化した際に対応できないという重大な脆弱性を抱えている。この問題の核心は、現実のオープンな環境において、エージェントの記憶が正しいかどうかを判定するための「正解(グランドトゥルース)」を与える評価者が存在しない、あるいはフィードバックが極めて稀であるという点にある。 既存の手法は、主に二つのアプローチでこの問題に対処しようとしてきた。一つは、LLMの高度な推論能力を利用して自己反省(リフレクション)を行い、記憶の矛盾を修正させる方法である。…

核心:何を提案したのか

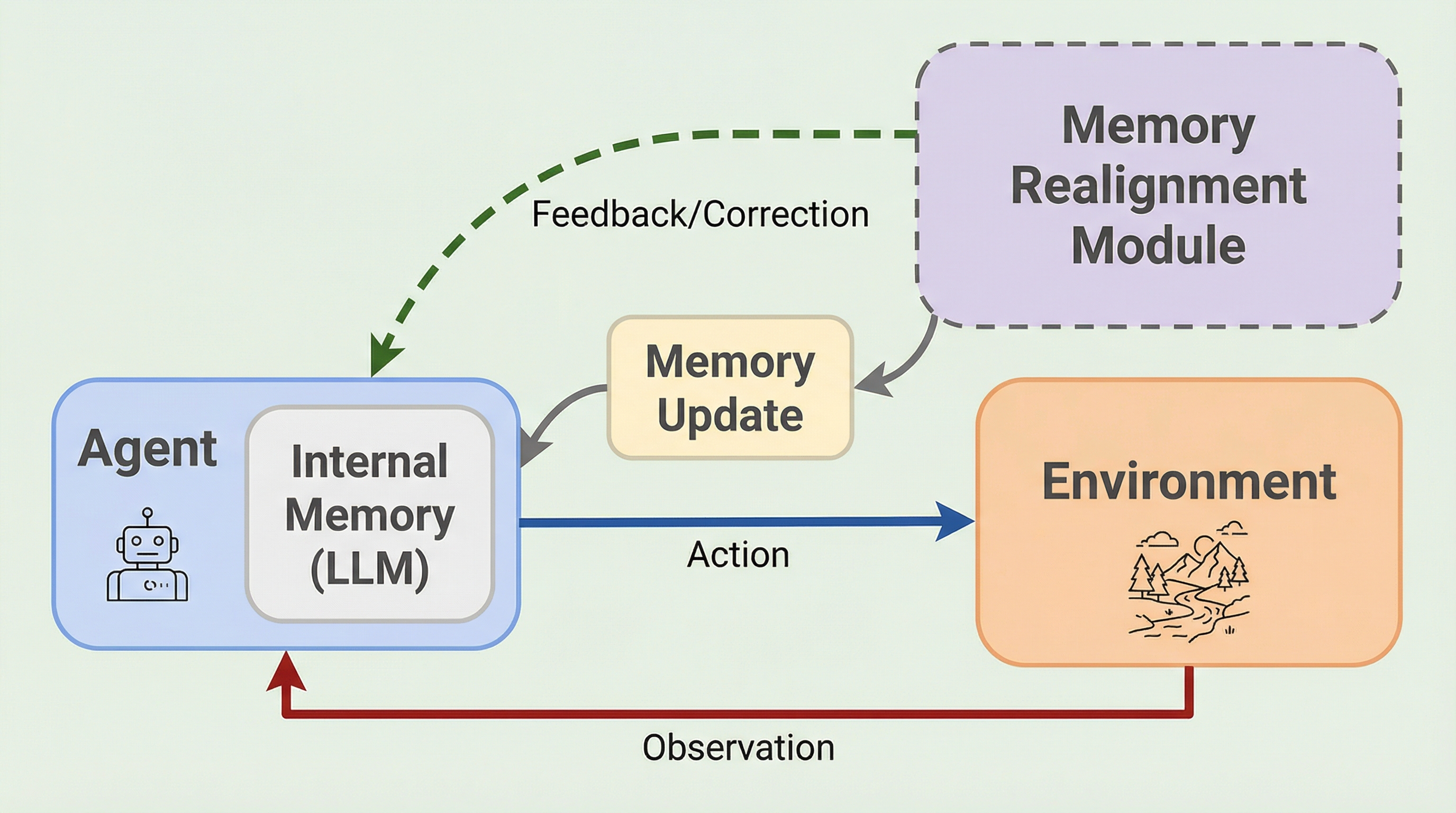

本研究では、LLMエージェントの記憶と環境の間の認識のズレを解消するためのフレームワーク「GLOVE(Global Verifier)」を提案している。GLOVEの最大の特徴は、記憶を「不変の事実」ではなく、常に検証されるべき「環境の振る舞いに関する仮説」として定義し直した点にある。これにより、外部からの明示的な正解ラベルや、LLMの極めて高度な内省能力を前提とすることなく、環境との直接的な相互作用を通じて記憶を最新の状態に保つ「再整合(Realignment)」を可能にする。GLOVEは、エージェントが行動した際に得られる最新の観測結果と、検索された過去の記憶との間に生じる矛盾を「認知的不協和」として捉える。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related