不正確な勾配からビザンチン耐性へ:類似性に基づく加速と最適化

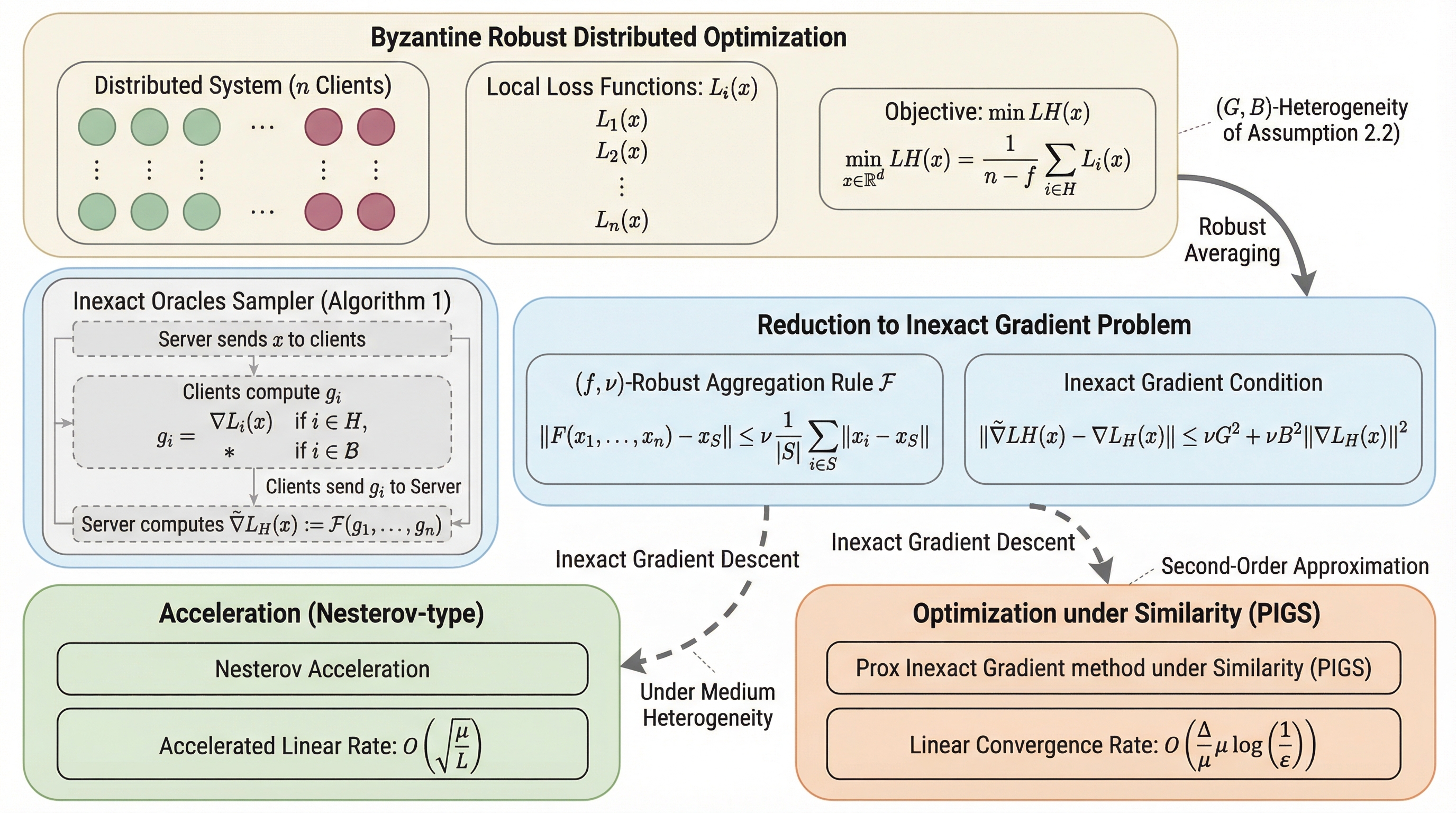

本研究は、分散学習におけるビザンチン故障への対策を「不正確な勾配オラクル」という統一的な理論枠組みに統合し、従来の場当たり的な解析手法を刷新しました。 この枠組みに基づき、通信効率を劇的に改善する「ネステロフ型加速アルゴリズム」と、サーバー側の補助情報を活用して収束を早める「PIGS法」の2つを新たに提案しました。

TL;DR(結論)

本研究は、分散学習におけるビザンチン故障への対策を「不正確な勾配オラクル」という統一的な理論枠組みに統合し、従来の場当たり的な解析手法を刷新しました。 この枠組みに基づき、通信効率を劇的に改善する「ネステロフ型加速アルゴリズム」と、サーバー側の補助情報を活用して収束を早める「PIGS法」の2つを新たに提案しました。 理論解析と実験により、データの不均一性がある過酷な環境下でも理論的限界に近い精度を維持しつつ、従来のロバスト手法を大幅に上回る高速な収束と通信コストの削減を実現することを証明しました。

なぜこの問題か

現代の機械学習において、複数の計算ノードが協力してモデルを構築する分散学習は、大規模なデータ処理と計算資源の活用のために不可欠な技術となっています。しかし、多数の参加者が関与するシステムには、一部のノードが故障したり、悪意のある攻撃者によって操作されたりする「ビザンチン故障」のリスクが常に伴います。標準的な分散勾配降下法(DGD)は、たった一つのビザンチンノードが極端に大きな値や誤った方向の勾配を送信するだけで、全体の平均値が破壊され、学習が全く収束しなくなるという致命的な脆弱性を持っています。この問題に対し、幾何学的中央値やトリム平均といった「ロバストな集約手法」を用いる研究がこれまで行われてきましたが、既存のアプローチには大きな課題がありました。 それは、個別のアルゴリズムや集約手法ごとに専用の解析が行われており、理論的な枠組みが「場当たり的(ad-hoc)」であったという点です。そのため、標準的な勾配降下法を超えた、より複雑で効率的なアルゴリズム、例えば「加速」を用いた手法などをビザンチン環境に導入することが困難でした。…

核心:何を提案したのか

本研究の最大の貢献は、ビザンチン耐性を持つ分散最適化を「不正確な勾配オラクル(Inexact Gradient Oracles)」を用いた最適化問題として定式化したことです。これは、サーバーが受け取る勾配には「加法的な誤差」と「乗法的な誤差」の両方が含まれていると見なすアプローチです。具体的には、誠実なクライアント間のデータの不均一性と、ビザンチンノードの割合という2つの要素を、勾配の不正確さとして統合的に扱います。この抽象化により、ビザンチン耐性の問題を、現在活発に研究されている「不正確な情報を用いた最適化」という広い学術分野の知見と直接結びつけることに成功しました。 この新しい枠組みに基づき、著者は2つの具体的な高速アルゴリズムを提案しています。1つ目は「ビザンチン耐性を持つネステロフ型加速アルゴリズム」です。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related