FreeOrbit4D:幾何学的完全な4D再構成による単眼動画のための学習不要な任意のカメラリダイレクション

単眼動画から任意のカメラ軌道に沿った映像を生成するカメラリダイレクションにおいて、従来の「暗黙的制御」や「明示的ワーピング」では困難だった広角な視点変更と幾何学的な整合性の両立を、追加学習なしで実現する新フレームワーク「FreeOrbit4D」を提案しました。

TL;DR(結論)

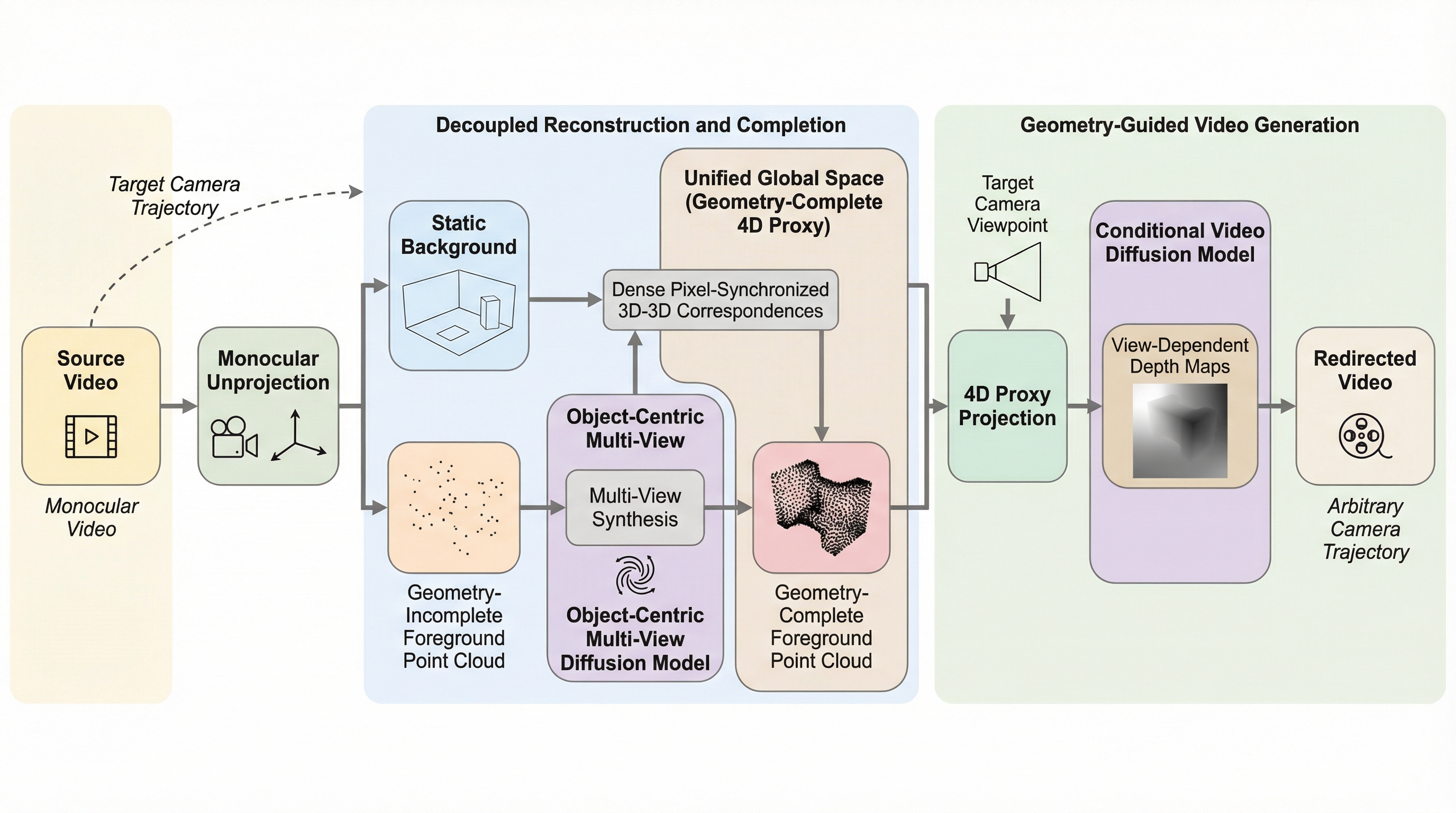

単眼動画から任意のカメラ軌道に沿った映像を生成するカメラリダイレクションにおいて、従来の「暗黙的制御」や「明示的ワーピング」では困難だった広角な視点変更と幾何学的な整合性の両立を、追加学習なしで実現する新フレームワーク「FreeOrbit4D」を提案しました。この手法は、単一の視点からは観測できない物体の裏側や遮蔽された背景を明示的に復元することで、大幅な視点変更時にも映像が崩れない安定性を確保しています。 具体的には、動的なシーンを背景と前景に分離して再構成し、物体中心のマルチビュー拡散モデルを用いて遮蔽領域の形状を補完することで、未観測部分まで含めた「幾何学的に完全な4Dプロキシ」を構築します。このプロキシから生成された深度マップを構造的なガイドとしてビデオ拡散モデルに入力することで、物理的に妥当な形状を維持したまま、自由な視点からの高品質なビデオ合成を可能にしました。 実験では、バレットタイムのような極端なカメラ移動を伴う複雑な動的シーンにおいて、既存手法を凌駕する視覚的品質と時間的な一貫性を達成しました。さらに、構築された明示的な4D表現は、ビデオ生成のガイドに留まらず、特定のフレームでの編集を動画全体に反映させるエディット・プロパゲーションや、高品質な4Dデータの生成といった多様な応用への道を開く画期的な成果となっています。

なぜこの問題か

単一のカメラで撮影された動画から、ユーザーが自由に指定した新しいカメラ軌道に沿ってシーンを再生する技術は、自動運転のシミュレーションや仮想現実、映画のような特殊効果の作成において極めて重要です。しかし、単眼動画からのカメラリダイレクションは、本質的に「不良設定問題」という大きな壁に直面しています。単一の視点から得られる情報は、動的な3Dシーンの極めて限定的な時空間の断片に過ぎず、カメラが大きく移動した際に現れるはずの物体の側面や背面、あるいは背景の遮蔽領域に関する情報は一切含まれていないからです。このため、元のカメラ軌道から大きく外れるような広角のリダイレクションを行うと、未観測領域をどのように埋めるかという幾何学的な曖昧さが生じ、生成された映像に深刻な歪みや不自然な欠損が発生してしまいます。 これまでの研究では、主に2つのアプローチが試みられてきました。一つは、カメラの動きを学習された埋め込みベクトルやテキストプロンプトとしてモデルに注入する「暗黙的制御」です。…

核心:何を提案したのか

本論文では、単眼動画から「幾何学的に完全な4D再構成」を行うことで、追加の学習を一切必要とせずに任意のカメラリダイレクションを可能にする新しいフレームワーク「FreeOrbit4D」を提案しました。この手法の最も革新的な点は、部分的な観測情報しか持たない単一視点の動画から、物体の裏側まで含めた完全な4D幾何学を明示的に推論・回復し、それをビデオ生成のための「構造的な接…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related