FadeMem:効率的なエージェントメモリのための生物学に着想を得た忘却機構

大規模言語モデル(LLM)エージェントの長期運用における課題である情報の過負荷と破滅的忘却を解決するため、人間の「忘却」プロセスを模倣した二層構造のメモリ管理アーキテクチャ「FadeMem」が提案されました。

TL;DR(結論)

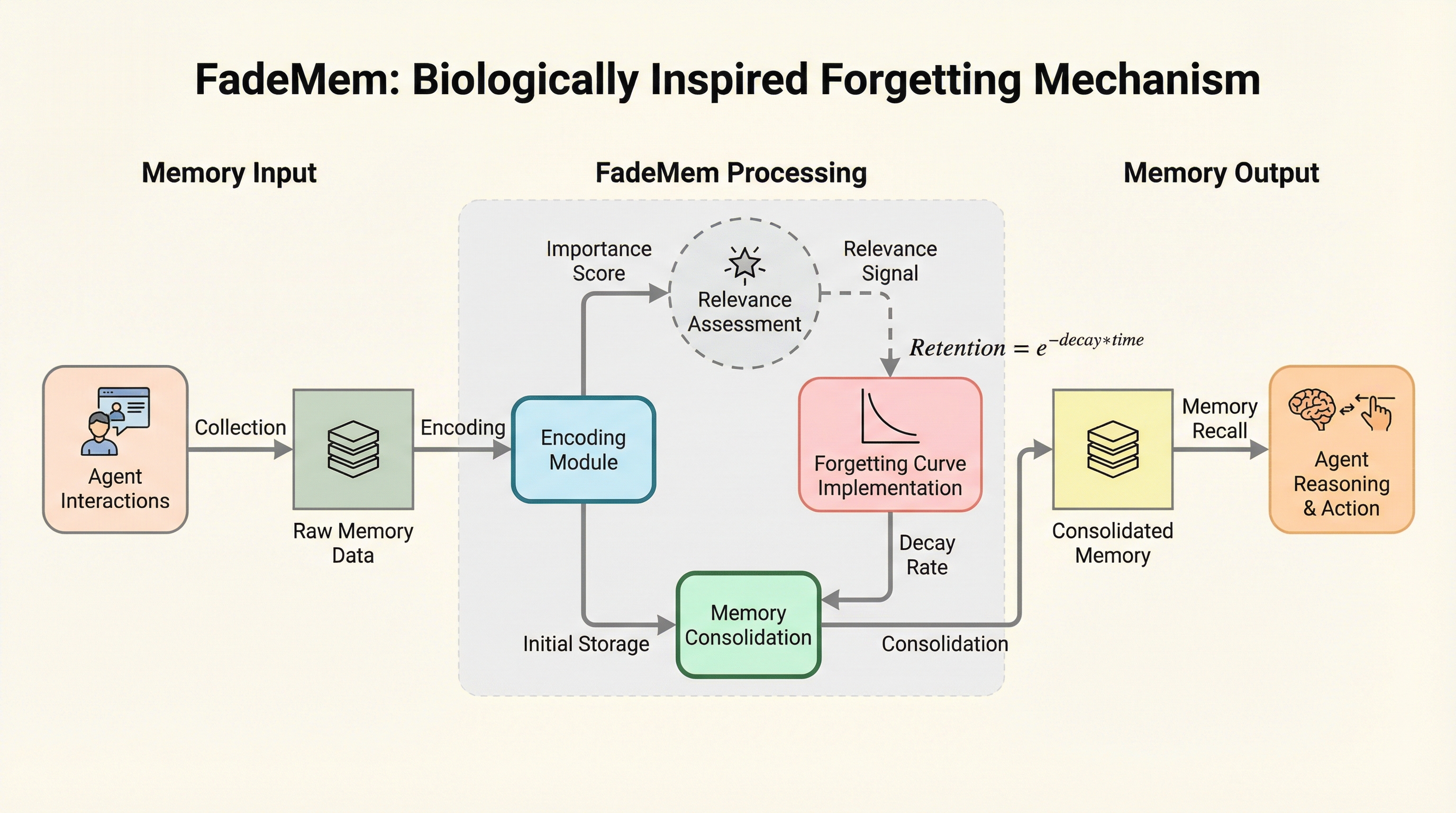

大規模言語モデル(LLM)エージェントの長期運用における課題である情報の過負荷と破滅的忘却を解決するため、人間の「忘却」プロセスを模倣した二層構造のメモリ管理アーキテクチャ「FadeMem」が提案されました。このシステムは、情報の重要度やアクセス頻度、時間経過に基づいて記憶を動的に減衰させる指数関数的な忘却曲線を実装しており、LLMを用いた衝突解決とメモリ融合により情報の整合性を維持します。実験の結果、従来のシステムと比較してメモリのストレージ容量を45%削減しながら、重要な事実の保持率を向上させ、マルチホップ推論や検索精度において優れたパフォーマンスを発揮することが確認されました。

なぜこの問題か

現在の大規模言語モデル(LLM)を用いた自律型エージェントは、長期的な対話や複雑なタスクを遂行する上で、メモリ(記憶)の管理に重大な限界を抱えています。既存のメモリシステムは、コンテキストの境界で情報を完全に失ってしまう「破滅的忘却」か、あるいは逆にすべての情報を無差別に保持しようとしてコンテキスト内が不要な詳細情報で溢れかえる「情報の過負荷」という、極端な二択の問題に直面しています。現在のAIシステムは、情報を「すべて保持する」か「すべて捨てる」かというバイナリ(二値的)な保持戦略を採用していることが一般的であり、これが効率性を著しく損なっています。エージェントとの対話が長くなり、膨大な冗長情報や古い情報が蓄積されるにつれて、情報の検索精度が低下し、パフォーマンスが悪化するという課題が顕著になっています。 人間は、重要でない情報を自然に減衰させ、重要な記憶を強化するという適応的な忘却プロセスを通じて、認知の効率を維持しています。エビングハウスの忘却曲線に代表される生物学的な知見によれば、人間の記憶の強さは、反復、感情的な重要性、関連性などの要因によって調整される予測可能な指数関数的減衰に従います。…

核心:何を提案したのか

本論文では、人間の認知効率を鏡のように映し出す能動的な忘却機構を組み込んだ、生物学に着想を得たエージェントメモリシステム「FadeMem」を提案しています。このシステムの核心は、異なる減衰率を持つ二層構造のメモリ階層(デュアルレイヤー・メモリ・アーキテクチャ)にあります。FadeMemは、情報の「意味的な関連性」「アクセス頻度」「時間的なパターン」によって調整される適応的な指数関数的な減衰関数を実装しています。これにより、各メモリの保持期間が動的に決定され、重要な情報は長期的に保持され、重要度の低い情報は時間の経過とともに自然に消えていく仕組みを実現しました。これは、単に古い情報を消去するのではなく、情報の重要性に応じて「薄れさせる」という、より人間に近い柔軟なメモリ管理を実現しています。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related