LLMの推論プロセスを概念予測器のグラフへと蒸留する手法「GCP」の提案

大規模言語モデル(LLM)を分類タスクに利用する際の高い計算コストと推論遅延を解消するため、LLMの複雑な推論プロセスを「概念予測器のグラフ」として小型モデルに抽出する新しい蒸留枠組み「GCP」が提案されました。

TL;DR(結論)

大規模言語モデル(LLM)を分類タスクに利用する際の高い計算コストと推論遅延を解消するため、LLMの複雑な推論プロセスを「概念予測器のグラフ」として小型モデルに抽出する新しい蒸留枠組み「GCP」が提案されました。 この手法は教師モデルの意思決定を有効非巡回グラフ(DAG)として構造化し、学生モデル内にモジュール化された概念予測器を構築することで、最終的なラベルだけでなく中間的な推論ステップも学習させることを可能にしています。 8つの自然言語処理ベンチマークを用いた実験の結果、限られたアノテーション予算内で高い性能を発揮し、推論の誤りがどの部位で発生したかを特定できる高い解釈性と、効率的で制御可能な学習ダイナミクスを実現したことが確認されました。

なぜこの問題か

現在、大規模言語モデル(LLM)はトピック分類、感情分析、スタンス検出、臨床リスク予測といった様々な判別タスクにおいて、その高い汎用性と推論能力から広く採用されています。従来の分類器とは異なり、LLMはプロンプティングを通じて未知のタスクにも適応できるため、タスクの定義が急速に変化する金融やヘルスケア、大規模なコンテンツモデレーションなどの分野で非常に魅力的な選択肢となっています。しかし、この柔軟性には多大な計算コストと金銭的コストが伴います。例えば、最先端のモデルを用いた推論では、100万トークンあたり5ドルから15ドルのコストが発生し、比較的安価なモデルであっても大規模なコーパスに適用する場合には無視できない費用がかかります。数百万件の文書を扱う金融コンプライアンスのスクリーニングや臨床ノートのトリアージ、電子商取引のレビュー分類など、高いスループットが求められる実務環境において、LLMを直接デプロイし続けることは経済的にも時間的にも非現実的であるという課題がありました。 この問題に対する自然な解決策は、LLMの知識をより小さなモデルに蒸留することです。…

核心:何を提案したのか

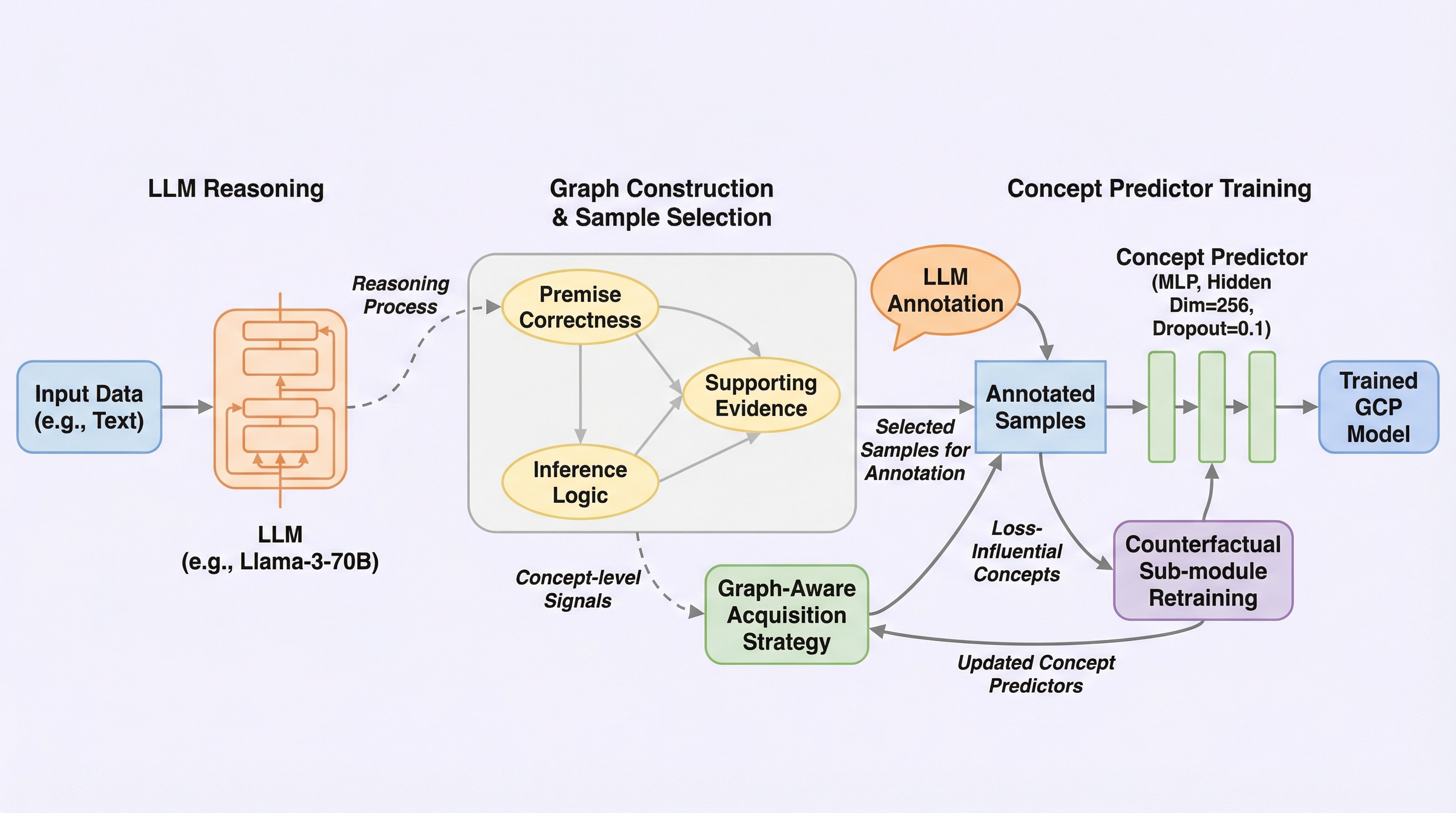

本研究では、推論プロセスを考慮した能動的蒸留フレームワークである「Graph of Concept Predictors(GCP)」を提案しています。GCPの最大の特徴は、教師モデルであるLLMの意思決定プロセスを「有効非巡回グラフ(DAG)」として明示的に表現し、それを学生モデル内のモジュール化された「概念予測器」の集合としてミラーリング(鏡写しに)する点にあります。これにより、単なるラベルの受け渡しではなく、論理的な思考の構造そのものを学生モデルへと移植することが可能になります。 GCPフレームワークは、大きく分けて3つの革新的な要素で構成されています。第一に、推論プロセスを概念ノードのグラフとして定義する「概念予測器グラフ」の構築です。各ノードは中間的な推論状態を表し、ノード間のエッジは概念間の意味的・因果的な依存関係を符号化します。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related