二値判定を越えて、動画内の多様な性差別を捉える:スペイン語マルチモーダルデータセットFineMuSeと階層タクソノミー

オンライン上の性差別は形が複数あり、性差別か非性差別かの二値だけでは、文脈に依存する微妙で暗黙的な表現が見落とされやすく、説明がない自動フラグは透明性の面でも課題になり得ます。 / そこで、スペイン語のソーシャルメディア動画を対象に、二値注釈と詳細注釈を併せ持つFineMuSeと、性差別・非性差別に加えて皮肉とユーモアも扱える三層の階層タクソノミーを提示し、二値検出と詳細検出の両方で多数の大規模言語モデルを評価しています。 / その結果、マルチモーダル大規模言語モデルはニュアンスのある性差別の同定で人手注釈者と競争的な性能を示す一方、視覚的手掛かりで伝わる「複数タイプの併発」を捉える点には難しさが残ると報告されています。

TL;DR(結論)

- オンライン上の性差別は形が複数あり、性差別か非性差別かの二値だけでは、文脈に依存する微妙で暗黙的な表現が見落とされやすく、説明がない自動フラグは透明性の面でも課題になり得ます。

- そこで、スペイン語のソーシャルメディア動画を対象に、二値注釈と詳細注釈を併せ持つFineMuSeと、性差別・非性差別に加えて皮肉とユーモアも扱える三層の階層タクソノミーを提示し、二値検出と詳細検出の両方で多数の大規模言語モデルを評価しています。

- その結果、マルチモーダル大規模言語モデルはニュアンスのある性差別の同定で人手注釈者と競争的な性能を示す一方、視覚的手掛かりで伝わる「複数タイプの併発」を捉える点には難しさが残ると報告されています。

なぜこの問題か

性差別は単一の表現に限られず、社会制度、日常的な相互作用、個人の信念表明など、複数の水準で現れると整理されています。ソーシャルメディアはその影響を増幅し得るため、モデレーション現場では自動化ツールが広く用いられている一方、既存の仕組みは性差別か非性差別かの二値分類にとどまりがちです。その場合、文脈に強く依存する含みや、暗黙的で遠回しな言い回しが、細かなラベルの不足によって拾いにくくなると問題提起されています。さらに、性差別だとフラグを立てるだけで明確な理由が示されないと、透明性が欠け、利用者やモデレーターの信頼を損ね得る点も指摘されています。 研究動向としては、詳細な性差別検出はテキスト中心の資源(例えばXやRedditのデータ)で進んできた一方、マルチモーダルで粒度を上げた研究はミームが主戦場になり、テキストと画像の関係性が焦点になりやすかったと整理されています。これに対して動画は、画面内の映像、音声発話、字幕や画面テキストが相互に作用するため、どのモダリティに根拠があるのかを切り分けつつ、詳細タイプまで扱う枠組みが必要になります。…

核心:何を提案したのか

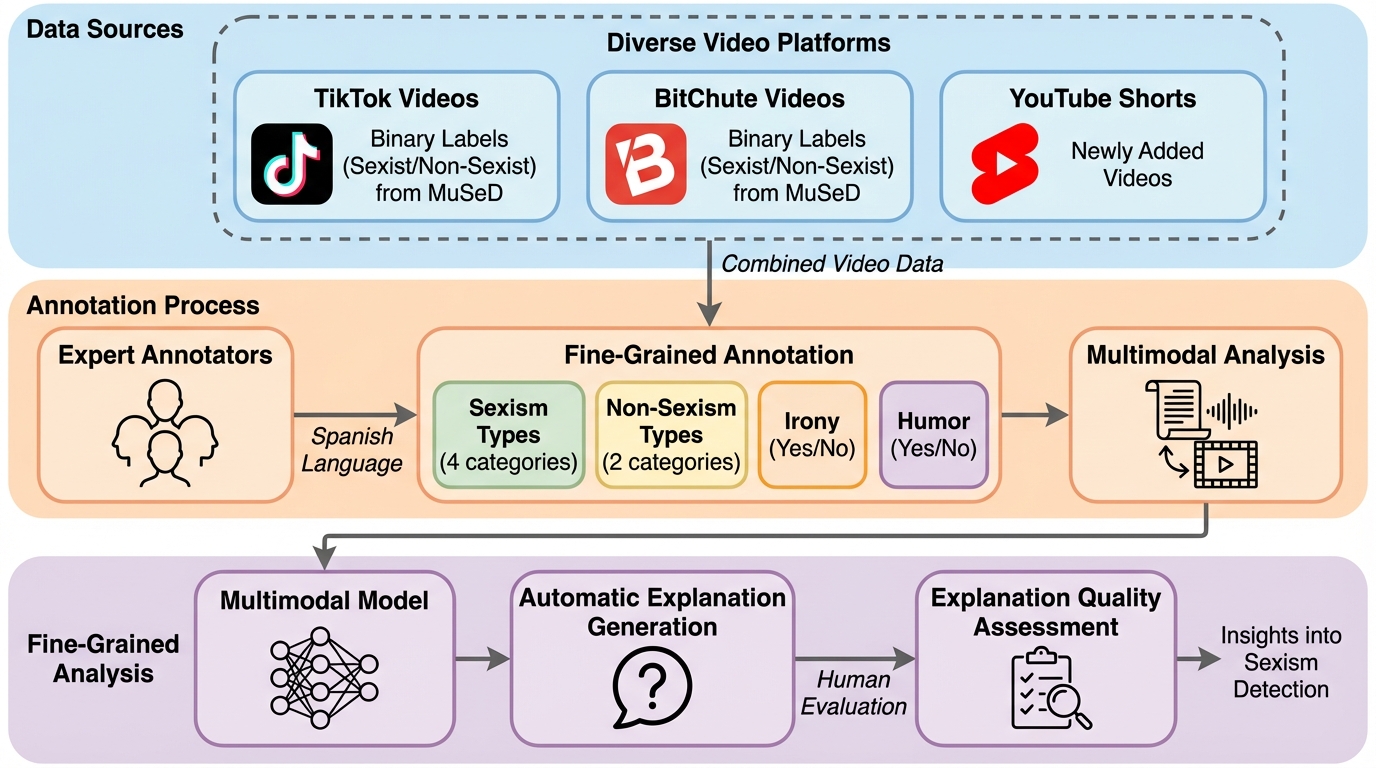

本研究の中心提案は、スペイン語のソーシャルメディア動画を対象にした、マルチモーダルな性差別検出データセットFineMuSeの提示です。FineMuSeは、性差別/非性差別の二値注釈に加えて、より細かなタイプを区別する詳細注釈も含む点が核になっています。データはTikTok、BitChute、YouTube Shortsから収集された合計828本の動画で構成されると明記されています。既存のMuSeDはTikTokとBitChuteの動画400本に二値注釈を付けた基盤であり、FineMuSeはそこにYouTube Shortsから428本を追加し、短尺動画の表現をより広く扱えるよう拡張した位置付けです。 もう一つの提案は、オンライン上の性差別を整理するための包括的な階層タクソノミーです。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related