普遍的な負荷分散原理とその大規模言語モデルサービングへの応用

大規模言語モデル(LLM)の推論サービスにおいて、同期バリアによって生じる計算資源の不均衡が深刻なボトルネックとなっており、実際の運用データではデコード工程の40%以上の時間がアイドリング状態で浪費されていることが判明しました。

TL;DR(結論)

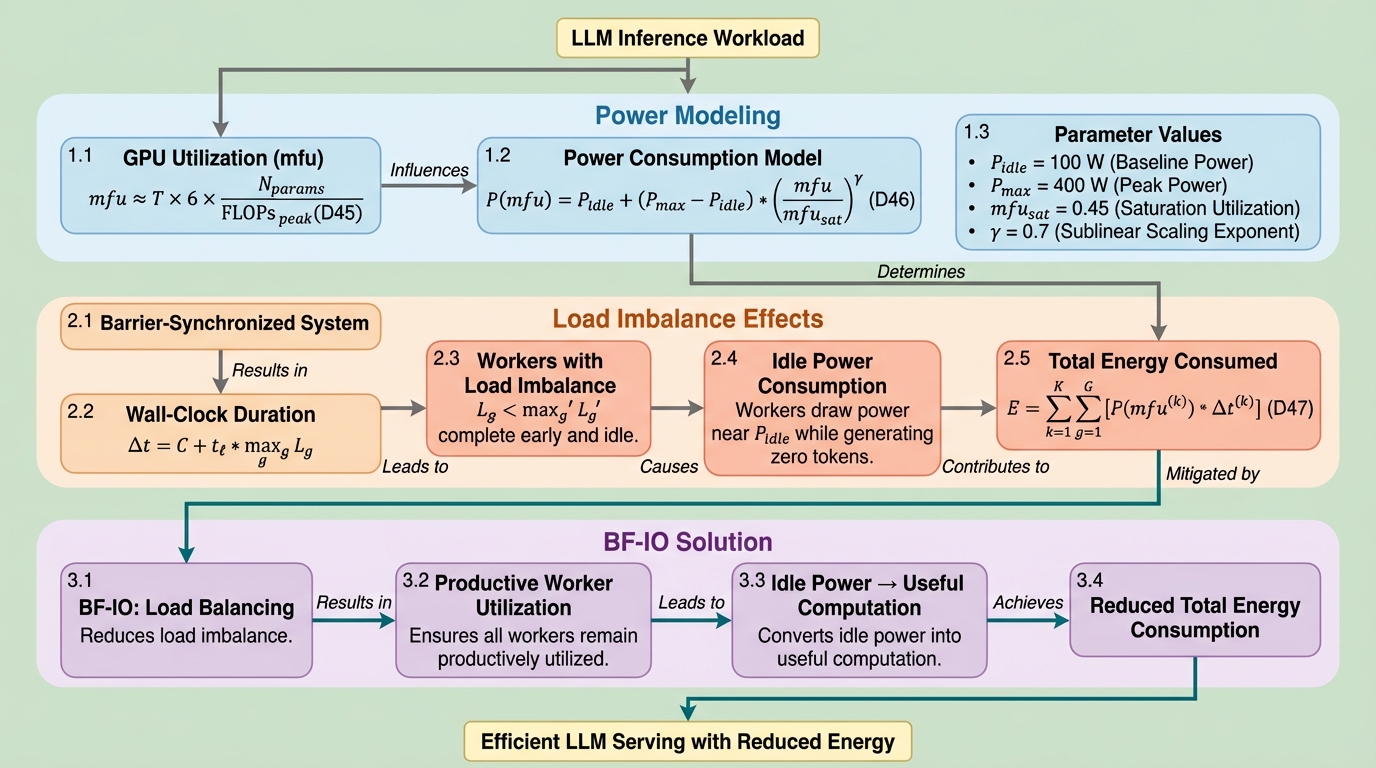

大規模言語モデル(LLM)の推論サービスにおいて、同期バリアによって生じる計算資源の不均衡が深刻なボトルネックとなっており、実際の運用データではデコード工程の40%以上の時間がアイドリング状態で浪費されていることが判明しました。 本研究では、ジョブの全実行時間を予測するのではなく、直近の短い期間の負荷変動のみを考慮して割り当てを決定する「BF-IO(将来均衡整数最適化)」という普遍的な負荷分散原理を提案し、数学的な最適化手法を導入しています。 この手法は、リクエストの移動が困難な制約下でも、システム規模やバッチサイズに応じて分散効率が向上することを理論的に証明しており、実証実験ではスループットの14%向上や消費電力の3.4%削減といった具体的な成果を達成しています。

なぜこの問題か

大規模言語モデル(LLM)の普及に伴い、AIデータセンターにおける推論処理の需要は爆発的に増加しており、それに伴う電力消費と冷却リソースの確保が「エネルギーの壁」と呼ばれる限界に達しつつあります。 LLMの推論は、入力プロンプトを処理するプリフィル段階と、トークンを一つずつ生成するデコード段階の二段階で構成されますが、現在の運用ではデコード段階における計算資源の利用効率の低さが大きな課題となっています。 デコード処理は通常、複数の計算ワーカーに分散して並列実行されますが、各ステップで全ワーカーが同期する「バリア同期」という仕組みが採用されているため、最も処理の遅いワーカーが全体の進行速度を決定してしまいます。 実際の産業界のトレースデータを分析した結果、この同期バリアによって生じるアイドリング時間は、デコードの1ステップあたり平均で40%を超えており、計算リソースの5分の2以上が無駄に消費されていることが明らかになりました。…

核心:何を提案したのか

本研究では、同期バリアと粘着性のある割り当て制約を持つシステムに向けた新しい負荷分散原理として、「BF-IO(Balance Future with Integer Optimization:将来均衡整数最適化)」を提案しました。 この原理の核心は、リクエストの全実行時間を正確に予測しようとする従来のアプローチを捨て、代わりに「ごく近い将来」の負荷変動のみに注目して、ステップごとに整数計画問題を解くという点にあります。 LLMの推論において、生成される回答の最終的な長さを予測することは非常に困難で不正確ですが、現在処理中のジョブが次の数ステップ以内に終了するかどうかを予測することは比較的容易であるという洞察に基づいています。 BF-IOは、各割り当てステップにおいて、短い予測ウィンドウ(ルックアヘッド窓)内での将来的な不均衡を最小化するように、バイナリ変数を用いた整数最適化問題を定式化して解を導き出します。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related