エネルギーベース生成モデル学習のための拡散分類損失

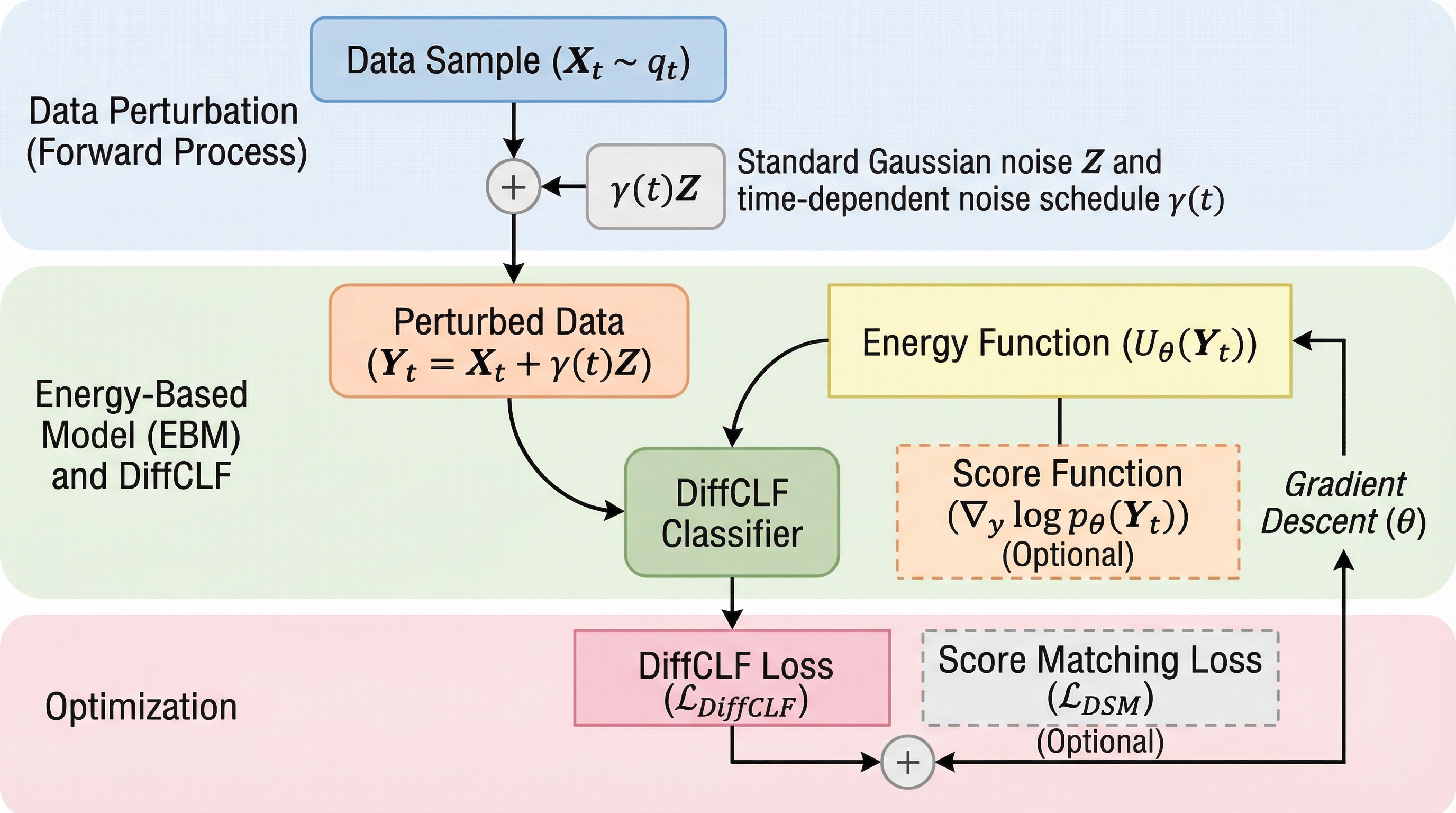

従来のスコアマッチング手法は、離れた高密度領域間の相対的な重みを正しく推定できない「モード盲目性」という根本的な課題を抱えていたが、本研究はこの問題を解決するために、エネルギーベースモデル(EBM)の学習を異なるノイズレベル間での教師あり分類問題として再定義する新しい目的関数「Diffusive Classification(DiffCLF)」を提案した。 DiffCLFは、モデルにどの時間ステップのノイズが付加されたデータであるかを識別させることで、エネルギー関数とその正規化定数を直接的かつ正確に推定することを可能にし、従来のデノイジング・スコアマッチングと容易に組み合わせることができる軽量で柔軟な枠組みを提供するとともに、理論的にも真の分布を一意に復元できることが証明されている。 ガウス混合モデルを用いた検証や、物理学・化学分野でのボルツマンジェネレーターの構築、複数のモデルを組み合わせる合成タスクにおいて、提案手法は既存のスコアベース手法を上回る高い忠実度と広範な適用性を示し、生成品質の維持と正確なエネルギー値の利用を両立させることで、生成AIの応用範囲を大きく広げる成果を達成した。

TL;DR(結論)

従来のスコアマッチング手法は、離れた高密度領域間の相対的な重みを正しく推定できない「モード盲目性」という根本的な課題を抱えていたが、本研究はこの問題を解決するために、エネルギーベースモデル(EBM)の学習を異なるノイズレベル間での教師あり分類問題として再定義する新しい目的関数「Diffusive Classification(DiffCLF)」を提案した。 DiffCLFは、モデルにどの時間ステップのノイズが付加されたデータであるかを識別させることで、エネルギー関数とその正規化定数を直接的かつ正確に推定することを可能にし、従来のデノイジング・スコアマッチングと容易に組み合わせることができる軽量で柔軟な枠組みを提供するとともに、理論的にも真の分布を一意に復元できることが証明されている。 ガウス混合モデルを用いた検証や、物理学・化学分野でのボルツマンジェネレーターの構築、複数のモデルを組み合わせる合成タスクにおいて、提案手法は既存のスコアベース手法を上回る高い忠実度と広範な適用性を示し、生成品質の維持と正確なエネルギー値の利用を両立させることで、生成AIの応用範囲を大きく広げる成果を達成した。

なぜこの問題か

確率的モデリングは現代の機械学習において、複雑なデータ分布を捉えて現実的なサンプルを生成するための基盤となる枠組みである。その中でもエネルギーベースモデル(EBM)は、密度を学習可能なエネルギー関数の負の指数として表現する魅力的な手法であるが、正規化定数の計算が困難であるため、最尤推定を行うには膨大な計算コストを要するサンプリング手順が必要となる。この課題を回避するために、密度の勾配であるスコア関数を学習するスコアマッチング手法が普及し、拡散モデルなどの成功を支えてきた。しかし、スコアベースの手法には「モード盲目性」という致命的な欠陥が存在する。これは、分布が互いに離れた複数の高密度領域(モード)を持つ場合、スコア情報だけでは各モードの相対的な重みの違いを識別できない現象を指す。例えば、重みの異なるガウス混合モデルであっても、モードが十分に離れていればスコア関数はほぼ同一になり、モデルは正しい比率を学習できない。この制限は、単なる画像生成を超えて、エネルギーの正確な値が不可欠なタスクにおいて深刻な問題となる。…

核心:何を提案したのか

本研究では、エネルギーベースの生成モデルを直接学習し、下流タスクでエネルギー値をそのまま利用可能にするための新しい目的関数として「Diffusive Classification(DiffCLF)」を提案している。この手法の核心は、対数密度の推定を、異なるノイズレベルにおけるデータの「教師あり分類問題」として再構成した点にある。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related