勾配最適化が不十分なとき:マルチモーダル学習のための分散的かつアンカリング的な幾何学的正則化

マルチモーダル学習において、強力な勾配最適化を行っても表現空間が特定の領域に固まる「幾何学的崩壊」やモダリティ間の不整合が生じ、特定の情報が他方を抑制するトレードオフが発生することを特定しました。

TL;DR(結論)

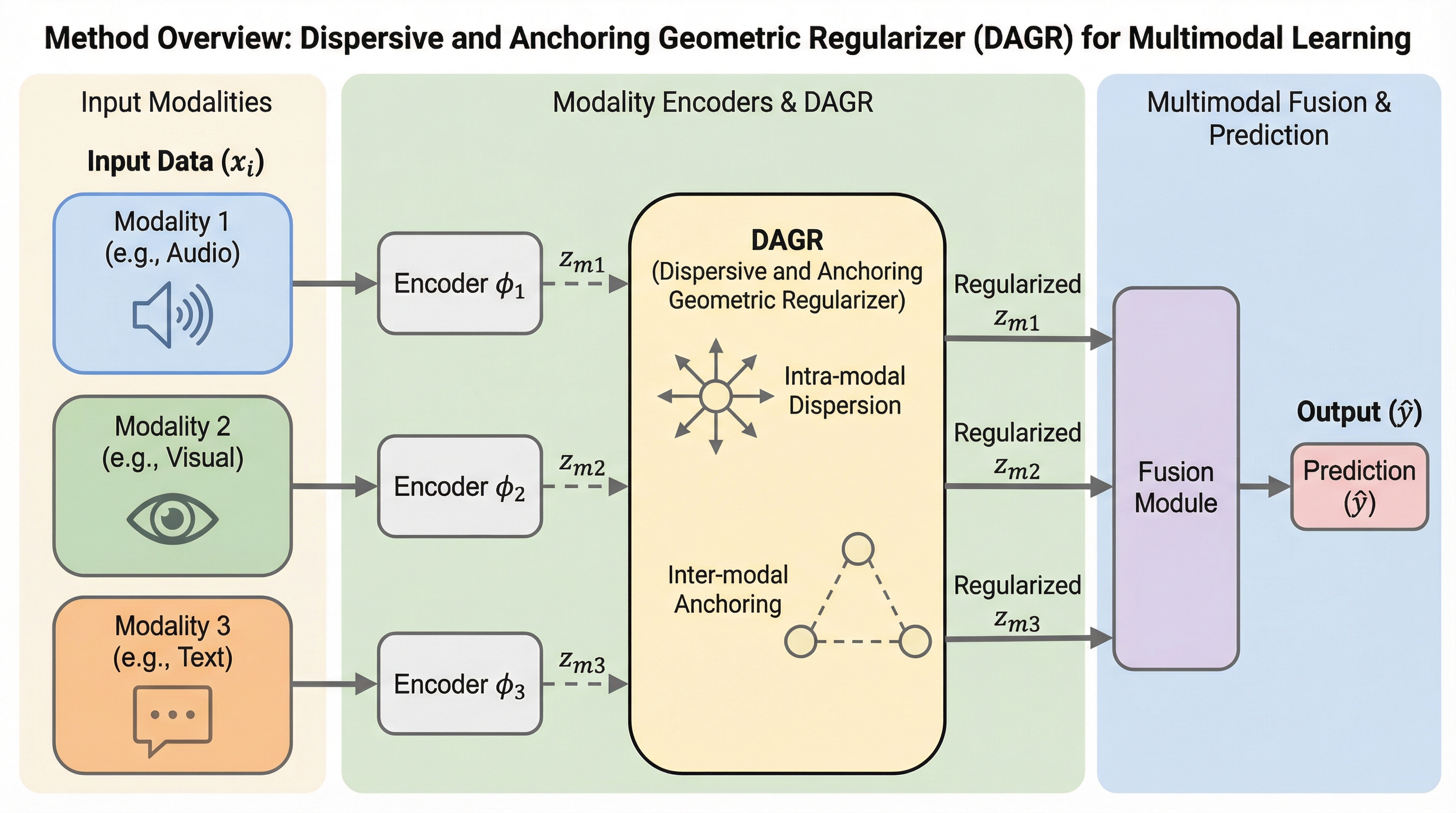

マルチモーダル学習において、強力な勾配最適化を行っても表現空間が特定の領域に固まる「幾何学的崩壊」やモダリティ間の不整合が生じ、特定の情報が他方を抑制するトレードオフが発生することを特定しました。 この課題に対し、各モダリティ内の表現を分散させて多様性を高める「分散正則化」と、サンプル単位でモダリティ間のズレを許容範囲内に抑える「アンカー正則化」を組み合わせた、軽量で構造変更不要なフレームワーク「DAGR」を提案しました。 複数のベンチマークを用いた検証の結果、DAGRは既存の学習手法に容易に統合でき、マルチモーダルな統合精度と個別のモダリティの堅牢性を同時に向上させ、表現空間の質を根本から改善することを数学的・実験的に実証しました。

なぜこの問題か

マルチモーダル学習の本来の目的は、視覚、音声、テキストといった異なる種類のデータ(モダリティ)から得られる補完的な情報を統合し、単一のモダリティでは到達できない高度な認識能力や堅牢性を獲得することにあります。しかし、実際の学習現場では「モダリティ・トレードオフ」と呼ばれる深刻な問題が頻発しています。これは、特定のモダリティの学習が進む一方で、別のモダリティの寄与が抑制され、結果として一部の情報の恩恵を受けられなくなる現象です。これまでの研究では、この原因は主に最適化のプロセス、すなわち勾配の衝突や特定のモダリティへの勾配の集中にあると考えられてきました。そのため、多くの既存手法は勾配の重み付けを調整したり、学習率を動的に変更したりすることで、この不均衡を解消しようと試みてきました。 しかし、本論文の著者らは、たとえ勾配のバランスを慎重に整えたとしても、依然としてモデルの内部表現には「幾何学的な病理」が残ることを指摘しています。具体的には、二つの主要な失敗モードが特定されました。第一に「モダリティ内表現の崩壊」です。…

核心:何を提案したのか

本論文の核心的な提案は、マルチモーダル学習における表現空間の幾何学的構造を直接的に制御するための軽量な正則化フレームワーク「DAGR(Dispersive and Anchoring Geometry Regularizer)」です。DAGRは、モデルのアーキテクチャを一切変更することなく、既存のエンコーダが出力する中間表現に対して幾何学的な制約を課す「プラグアンドプレイ」な手法として設計されています。このフレームワークは、互いに補完し合う二つの幾何学的軸で構成されています。 第一の軸は「モダリティ内分散」です。これは、同じモダリティに属する異なるサンプル同士が表現空間内で互いに反発し合うように促す制約です。これにより、表現が特定の方向に潰れるのを防ぎ、空間全体を有効に活用して多様な特徴を保持できるようにします。第二の軸は「モダリティ間アンカー」です。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related