最小限の深層学習アーキテクチャの体系的な特性評価:収束、枝刈り、量子化の統一的解析

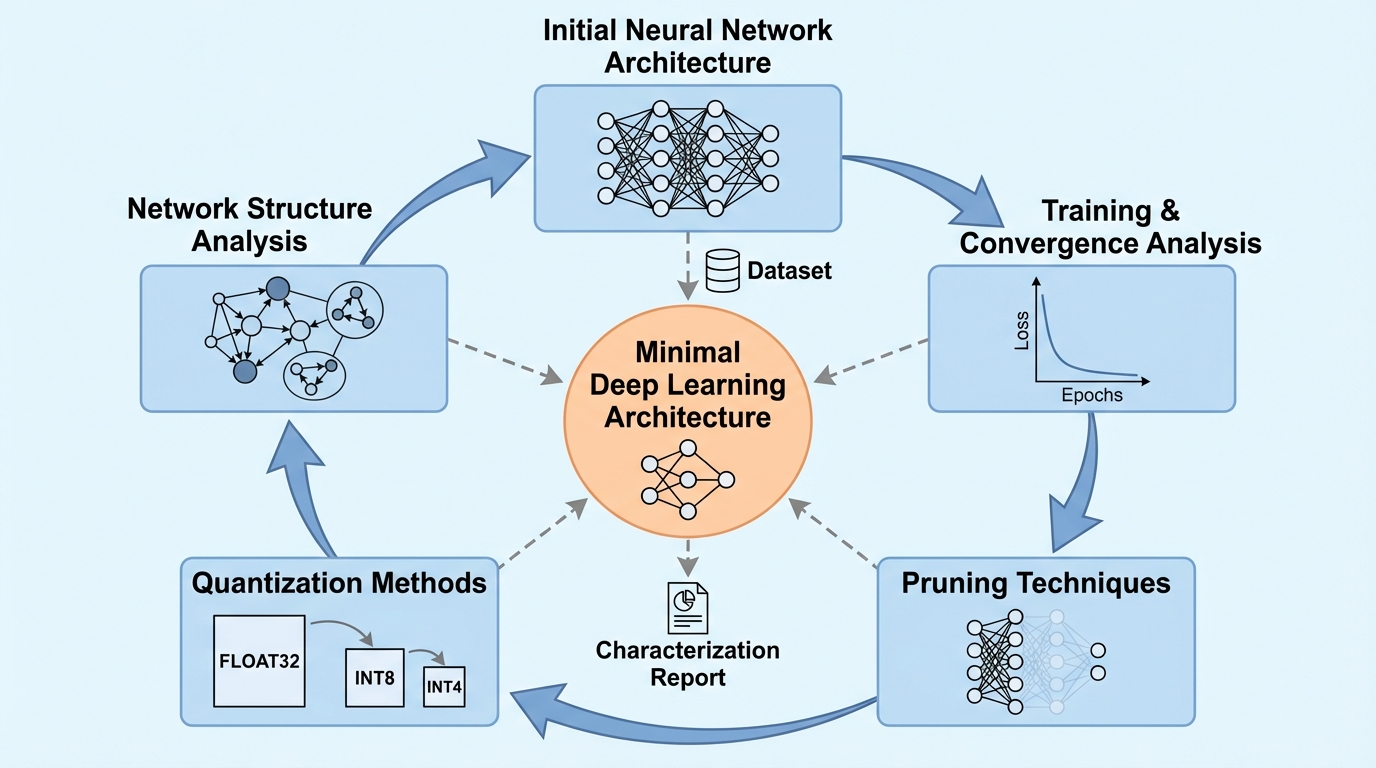

本研究は、深層ニューラルネットワーク(DNN)、畳み込みニューラルネットワーク(CNN)、およびビジョン・トランスフォーマー(ViT)を対象に、特定のタスクを解決するために必要な「最小限のアーキテクチャ」を特定するための統一的な計算手法を提案し、学習の収束性、枝刈りへの耐性、量子化の堅牢性を体系的に解析した。

TL;DR(結論)

本研究は、深層ニューラルネットワーク(DNN)、畳み込みニューラルネットワーク(CNN)、およびビジョン・トランスフォーマー(ViT)を対象に、特定のタスクを解決するために必要な「最小限のアーキテクチャ」を特定するための統一的な計算手法を提案し、学習の収束性、枝刈りへの耐性、量子化の堅牢性を体系的に解析した。 実験の結果、ネットワークの内部的な形状(ノードの増減パターン)よりも学習可能なパラメータの総数が性能と安定性を決定する支配的な要因であることが判明し、学習ダイナミクスが「不安定」「学習」「過学習」という3つの明確な段階を経て推移することを明らかにした。 深いアーキテクチャは浅いものと比較して枝刈りに対して最大60%程度の高い冗長性を保持しており、一方で量子化による精度低下はパラメータ数が少ないモデルや複雑なデータセットを扱う場合に顕著になるという、リソース制約下での効率的なモデル設計のための重要な指針を提示した。

なぜこの問題か

深層学習ネットワークは画像認識をはじめとする多様な分野で目覚ましい成果を上げているが、特定のタスクを確実に解決するために必要最小限となるアーキテクチャを正確に特定することは、依然として困難な課題として残されている。最小限のネットワーク構造を理解することは、学習プロセスにおいて本質的に必要とされる自由度を明らかにすることに直結し、将来的なAIシステムの拡張性や計算リソースの効率を極限まで高めるために極めて重要である。これまでの研究では、巨大なモデルには実質的に不要なパラメータが大量に含まれており、適切な枝刈りを行うことで精度を維持したまま大幅な軽量化が可能であることが示されてきたが、それらが最小構成においてどのように機能するかは不明瞭であった。また、計算コストやメモリ使用量を削減するために数値の精度を落とす量子化技術も広く利用されているが、これらの要素が互いにどのように関連し、モデルの安定性に寄与しているかは十分に解明されていない。特に、ネットワークの深さや層の形状(ノード数の増減パターン)が、学習の収束の安定性や、枝刈り・量子化に対する耐性にどのような影響を与えるのかを体系的に評価する枠組みが不足していた。…

核心:何を提案したのか

本研究は、最小限のニューラルネットワークにおける安定した学習を分析するための統一的な手法を提案している。この手法は、多層パーセプトロン(DNN/MLP)、畳み込みニューラルネットワーク(CNN)、およびビジョン・トランスフォーマー(ViT)という、現代の深層学習を支える3つの主要なアーキテクチャを網羅的に対象としている点が特徴である。まず、隠れ層の幅を増加、減少、または一定に保つといった様々な「形状」を持つ膨大なアーキテクチャのセットに対して、構造化された設計スイープを実施した。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related