SPQ:SVD・プルーニング・量子化を組み合わせた大規模言語モデル圧縮のアンサンブル手法

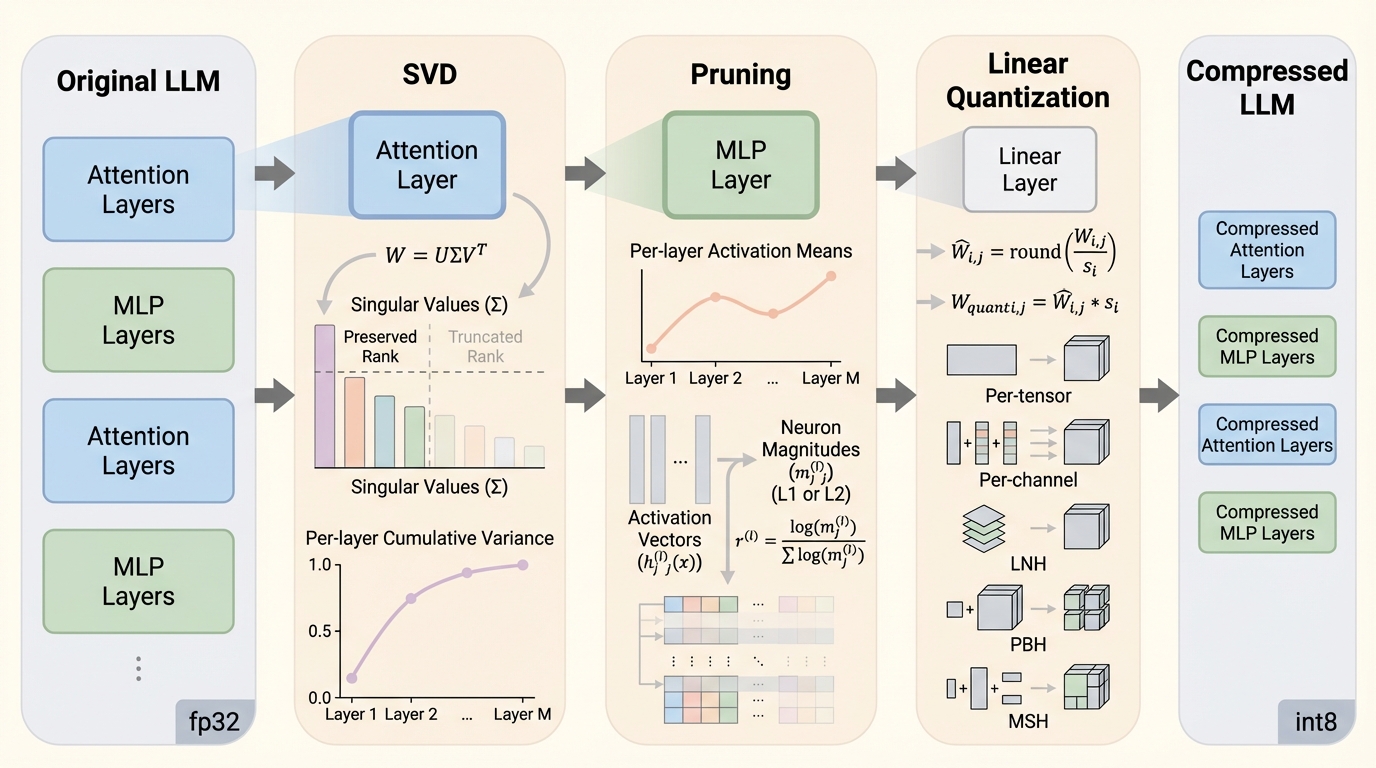

注意層・MLP層・全線形層で非効率の原因が異なる前提に立ち、各層で相性の良い圧縮を割り当てて組み合わせることで、同じ圧縮率でも単独手法よりパープレキシティを良くできると報告されています。 / 注意の射影は分散保持に基づくSVDで低ランク化し、MLPは活性化統計でニューロン単位の構造化プルーニングを行い、最後に全線形層へ学習後8ビットの対称線形量子化を適用する流れです。 / LLaMA-2-7Bでは最大75%の重みメモリ削減(6.86 GB)とWikiText-2のパープレキシティ改善(5.47→4.91)が示され、GPTQより少ないメモリ(7.16 GB)で最大1.9倍のスループット向上も示されています。

TL;DR(結論)

- 注意層・MLP層・全線形層で非効率の原因が異なる前提に立ち、各層で相性の良い圧縮を割り当てて組み合わせることで、同じ圧縮率でも単独手法よりパープレキシティを良くできると報告されています。

- 注意の射影は分散保持に基づくSVDで低ランク化し、MLPは活性化統計でニューロン単位の構造化プルーニングを行い、最後に全線形層へ学習後8ビットの対称線形量子化を適用する流れです。

- LLaMA-2-7Bでは最大75%の重みメモリ削減(6.86 GB)とWikiText-2のパープレキシティ改善(5.47→4.91)が示され、GPTQより少ないメモリ(7.16 GB)で最大1.9倍のスループット向上も示されています。

なぜこの問題か

大規模言語モデルは自然言語の理解と生成で強い性能を示す一方、モデル規模の拡大に伴って計算コストとメモリコストが増え、リソース制約のある環境やリアルタイム性が求められる場面での展開が難しくなると述べられています。そこで、性能を保ちながら重みメモリを削減する圧縮が重要になりますが、代表的な圧縮である低ランク化、構造化プルーニング、量子化は、それぞれ得意な対象と副作用が異なります。本文抜粋では、SVDとプルーニングは強い圧縮をかけた場合にパープレキシティが悪化し得る点が明記されており、単一手法で攻め切るのが難しい背景が示されています。加えて、Transformer系の内部には注意層とMLP層のように役割が異なる構成要素があり、全層へ一律の圧縮を適用すると、圧縮が効きにくい箇所や品質劣化を招きやすい箇所が混在しやすくなります。つまり「どの層に何を適用するか」という層の異質性を踏まえた設計が、現実の圧縮では重要な論点になります。さらに、圧縮はメモリだけでなく推論スループットにも影響しますので、品質(パープレキシティや下流ベンチマークの正解率)と、実運用上の速度(tokens/sec)の両面から見た設計が必要になります。…

核心:何を提案したのか

提案は、SPQ(SVD-Pruning-Quantization)というアンサンブル型の圧縮パイプラインです。中核の主張は、圧縮で狙う「非効率の源」が層ごとに違うため、単一の圧縮方法を全体へ均一に適用するのではなく、圧縮手法を層に合わせて分担させるほうが、同一の圧縮率に揃えたときにパープレキシティ面で有利になり得る、という点です。SPQでは、(1) MLP層には活性化に基づく構造化プルーニングを適用して冗長なニューロンを除去し、(2) 注意層には分散保持の基準でSVDを打ち切る低ランク化を適用して注意の射影をコンパクトな因子へ分解し、(3) そのうえで全線形層に学習後の8ビット線形量子化をかけ、重み表現を一様に圧縮します。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related