ShapLoRA:シャープレイ値に着想を得た重要度推定による大規模言語モデルへの低ランク適応の割り当て

大規模言語モデル(LLM)の微調整において、従来のLoRAは全ての層に一律のランクを割り当てていたが、本研究では各ランクの重要度をゲーム理論の「シャープレイ値」に着想を得た「Shapley sensitivity」で測定し、最適なランク割り当てを行うShapLoRAを提案した。

TL;DR(結論)

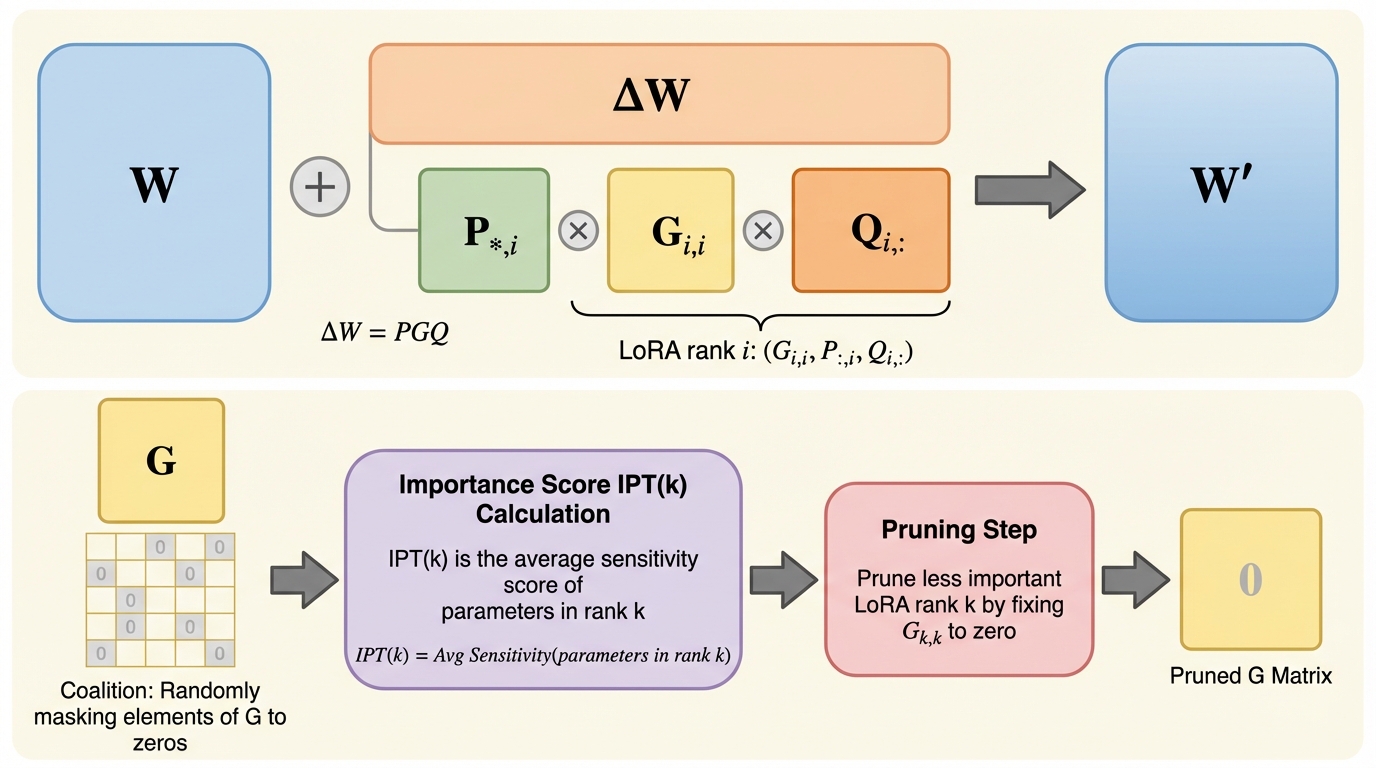

大規模言語モデル(LLM)の微調整において、従来のLoRAは全ての層に一律のランクを割り当てていたが、本研究では各ランクの重要度をゲーム理論の「シャープレイ値」に着想を得た「Shapley sensitivity」で測定し、最適なランク割り当てを行うShapLoRAを提案した。 この手法は、勾配ベースの感度測定と、複数のLoRAランクが協力してモデルの性能に寄与する「提携」の概念を組み合わせることで、従来のAdaLoRAやAutoLoRAなどが抱えていた重要度推定の不透明さや信頼性の低さを解決し、より説明可能なランク削減を可能にしている。 LLaMA-3 8Bを用いた検証では、質問応答や数学的推論、一般的な指示チューニングなどの多様なタスクにおいて、既存の主要なPEFT手法を同等以下のパラメータ数で上回る性能を達成し、特にValueモジュールのランクが重要であるといったモデル内部の特性も明らかにした。

なぜこの問題か

大規模言語モデル(LLM)は、自然言語処理の多様なタスクや専門的な評価ベンチマークにおいて優れた能力を示しているが、その全パラメータを微調整(フルファインチューニング)するには、膨大なGPUメモリと計算資源が必要となる。この課題を解決するために、全パラメータの1%未満を調整するだけで効果的な適応を可能にするパラメータ効率の良い微調整(PEFT)手法が注目されており、その中でも低ランク適応(LoRA)は広く採用されている代表的な手法である。しかし、標準的なLoRAは、Transformerの各層や線形モジュールに対して一律のランクを割り当てており、モデルの性能を最大限に引き出す余地が残されていた。近年の研究では、LLMのバックボーンに対して適切にランクを割り当てることで性能が向上することが示されているが、既存のランク割り当て手法には大きな限界が存在していた。 例えば、AdaLoRAのような手法は勾配ベースの感度を用いて重要度を測定するが、これは他のパラメータが変化しないという仮定に基づいた指標であり、モデルの異なる状態における重要性を考慮できていないため、信頼性が低いと指摘されている。…

核心:何を提案したのか

本研究では、ゲーム理論に基づく属性測定手法である「シャープレイ値(Shapley Value)」に着想を得た、新しいLoRAランク割り当てフレームワーク「ShapLoRA」を提案した。シャープレイ値は、複数のプレイヤーが協力してゲームを行う際に、各プレイヤーの貢献度を公平に評価するための指標である。ShapLoRAでは、各LoRAランクをゲームのプレイヤーと見なし、それらが組み合わさった「提携(coalition)」の中で各ランクがどれだけモデルの性能に寄与しているかを評価する。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related