SCOPEは何を変えたのか:極端に偏った連合科学データをグローバル合意つきコアセットで軽く学ぶ

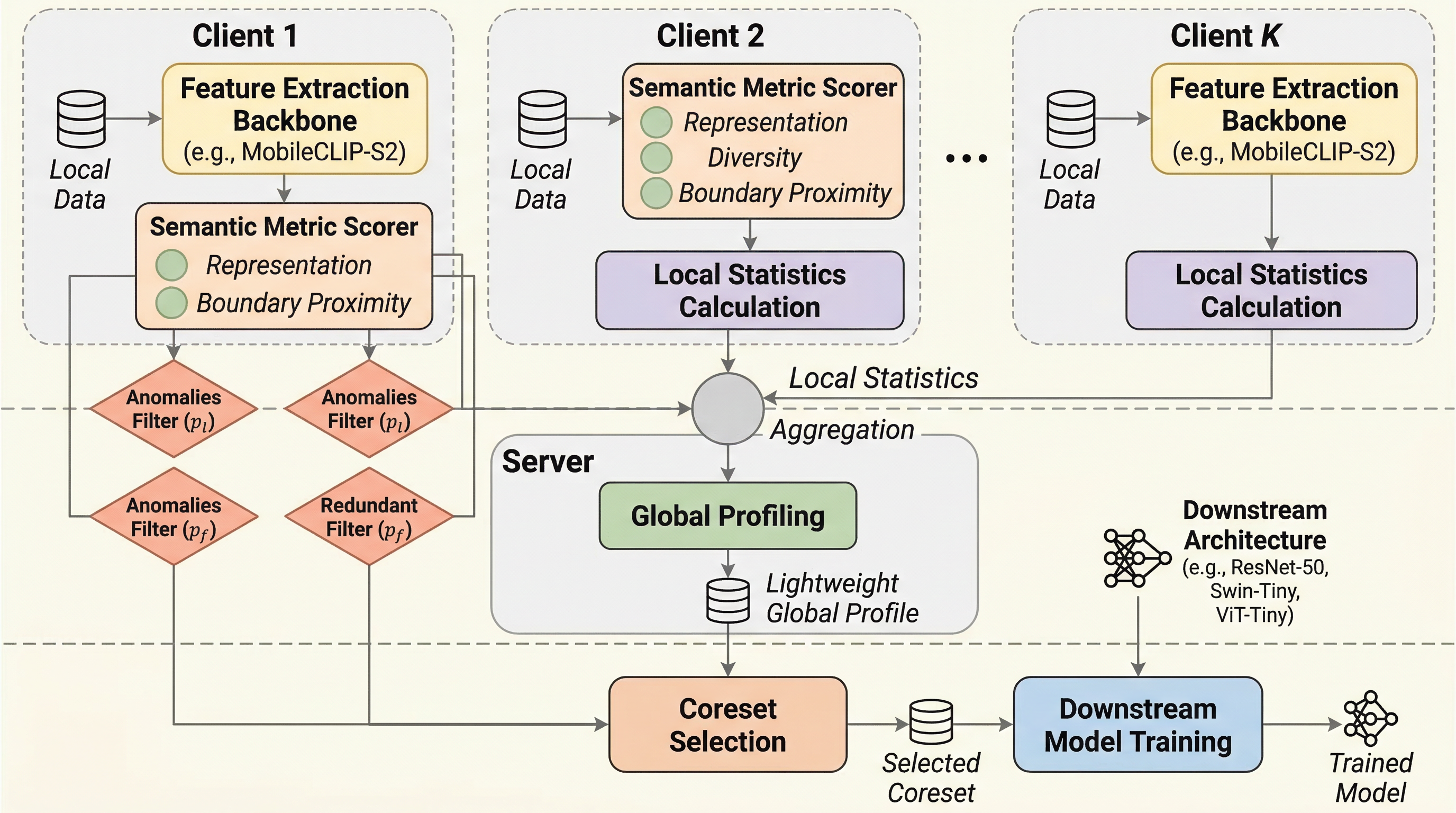

科学データの連合学習では、データを中央集約できないだけでなく、クライアントごとに極端なクラス不均衡や長い尾を引く分布があり、素朴なコアセット選択がむしろ希少な重要サンプルを落としてしまいます。SCOPE はこの問題を「各点の意味的な役割を見て残す」方向から組み替えました。 中核は、共有の表現空間で各サンプルに代表性・多様性・境界近接度という三つの尺度を与え、各クライアントが送るのは特徴ベクトルではなく軽量な数値指標だけにすることです。サーバはそれを集約して全体合意を作り、各クライアントはその合意に沿って異常点を落とし、希少だが大事な境界サンプルを残します。 実験では CIFAR-10、CIFAR-100、Tiny-ImageNet、UHCS で、SCOPE が 128倍から512倍の上り通信削減、7.72倍の実時間短縮、FLOP/VRAM 削減を達成しつつ、極端な偏り条件で既存法より高い精度と安定した収束を示しました。特に全データ利用より高精度になる条件がある点が面白く、「全部残す」こと自体がノイズになる場面を定量化しています。

TL;DR(結論)

- 科学データの連合学習では、データを中央集約できないだけでなく、クライアントごとに極端なクラス不均衡や長い尾を引く分布があり、素朴なコアセット選択がむしろ希少な重要サンプルを落としてしまいます。SCOPE はこの問題を「各点の意味的な役割を見て残す」方向から組み替えました。

- 中核は、共有の表現空間で各サンプルに代表性・多様性・境界近接度という三つの尺度を与え、各クライアントが送るのは特徴ベクトルではなく軽量な数値指標だけにすることです。サーバはそれを集約して全体合意を作り、各クライアントはその合意に沿って異常点を落とし、希少だが大事な境界サンプルを残します。

- 実験では CIFAR-10、CIFAR-100、Tiny-ImageNet、UHCS で、SCOPE が 128倍から512倍の上り通信削減、7.72倍の実時間短縮、FLOP/VRAM 削減を達成しつつ、極端な偏り条件で既存法より高い精度と安定した収束を示しました。特に全データ利用より高精度になる条件がある点が面白く、「全部残す」こと自体がノイズになる場面を定量化しています。

なぜこの問題か

科学分野の連合学習は、一般的なスマホ連合学習とは少し違います。顕微鏡、分光器、材料観察装置のような高解像度計測器が各拠点にあり、それぞれが異なる条件・目的でデータを吐くため、分布が強く偏ります。希少イベントは本当に少なく、一方で頻出パターンは大量にある。しかも装置ごとの癖やノイズも強い。こうした環境では、単に全データでローカル学習して FedAvg するだけだと、頭数の多いクラスやクライアントの癖が全球モデルを支配しがちです。

核心:何を提案したのか

SCOPE は、直交射影で得た意味情報を使って連合学習用の代表集合を作る方法です。要するに「代表的な点」「新しい点」「境界に効く点」を混ぜて残し、ただ量を減らすのではなく、残した後の学習が偏らないようにする設計です。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related