VoxelHound:四脚ロボットのための全周・マルチモーダル占有予測を現実環境で成立させる

車載前提の占有予測は、低い視点、高い揺れ、遮蔽、照明変化が激しい四脚ロボット環境ではそのまま使いにくく、しかも全周画像と複数センサを同時に扱う実データ基盤が不足していました。 提案は二本立てで、まず 360 度パノラマ・LiDAR・熱・偏光をそろえた PanoMMOcc データセットを整備し、次に姿勢揺れ補償 VJC と情報融合 MIPF を備えた VoxelHound を導入しています。 PanoMMOcc 上で VoxelHound は 23.34% mIoU を達成し、同条件の比較法を上回りました。特に C+L+T+P の全モーダル構成は、照明変化や複雑な境界での頑健性を押し上げています。

TL;DR(結論)

- 車載前提の占有予測は、低い視点、高い揺れ、遮蔽、照明変化が激しい四脚ロボット環境ではそのまま使いにくく、しかも全周画像と複数センサを同時に扱う実データ基盤が不足していました。

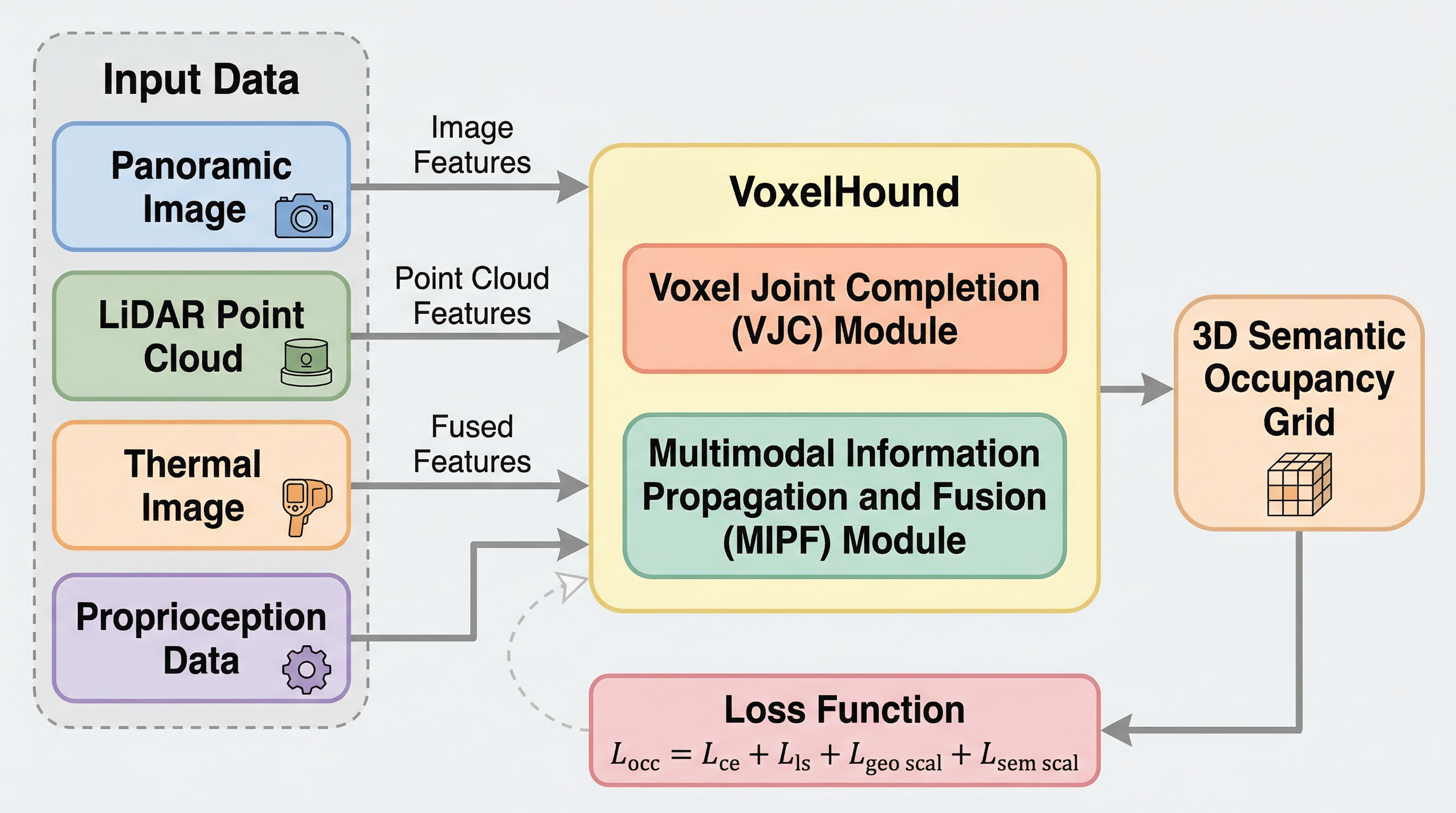

- 提案は二本立てで、まず 360 度パノラマ・LiDAR・熱・偏光をそろえた PanoMMOcc データセットを整備し、次に姿勢揺れ補償 VJC と情報融合 MIPF を備えた VoxelHound を導入しています。

- PanoMMOcc 上で VoxelHound は 23.34% mIoU を達成し、同条件の比較法を上回りました。特に C+L+T+P の全モーダル構成は、照明変化や複雑な境界での頑健性を押し上げています。

なぜこの問題か

四脚ロボットに求められる知覚は、車とはかなり違います。自動運転の占有予測は、多視点のピンホールカメラや車載 LiDAR を前提に発展してきました。これらの設定では、視点は比較的安定し、センサ位置も高く、道路構造もある程度整っています。ところが四脚ロボットは、地面に近い低視点で動き、歩容に伴って pitch や roll が大きく変わり、自己遮蔽も起きやすく、さらに林地、キャンパス、住宅地、緑地のような非構造環境へ入り込みます。車向けの設計をそのまま持ち込むと、見えている世界の幾何とセンサ運動の前提が合いません。

核心:何を提案したのか

提案の核心は二つあります。第一は PanoMMOcc です。これは四脚ロボット向けでは初の、実環境・全周・マルチモーダル占有予測データセットとして位置づけられています。パノラマ RGB、熱画像、偏光画像、LiDAR の四モーダルを同期し、四脚ロボットが現実に歩いた状態で dense occupancy annotation を付けています。既存の Occupancy 系ベンチマークが車載・多視点・道路中心だったのに対し、こちらは四脚ロボットの視点、揺れ、遮蔽、複雑地形を正面から扱います。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related