内省的翻訳:構造化された自己内省による低リソース機械翻訳の改善

isiZuluやisiXhosaといった低リソース言語の機械翻訳において、限定的な学習データに起因する誤訳や情報の欠落、意味の歪みを解決するため、モデルが自らの出力を批判的に評価し修正する「内省的翻訳(Reflective Translation)」フレームワークが提案されました。 この手法は、GPT-3.

TL;DR(結論)

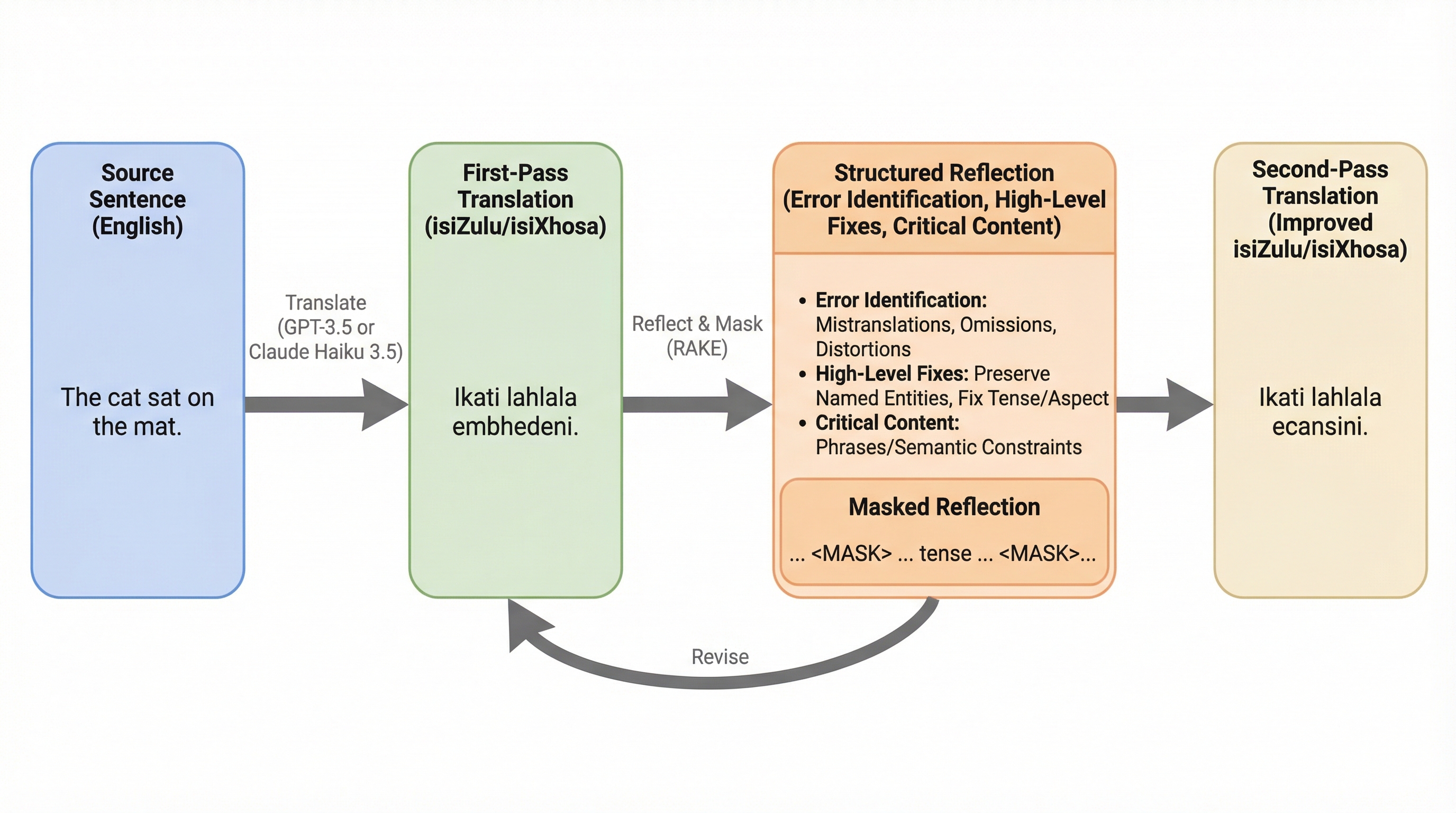

isiZuluやisiXhosaといった低リソース言語の機械翻訳において、限定的な学習データに起因する誤訳や情報の欠落、意味の歪みを解決するため、モデルが自らの出力を批判的に評価し修正する「内省的翻訳(Reflective Translation)」フレームワークが提案されました。 この手法は、GPT-3.5やClaude Haiku 3.5を用い、初期翻訳の生成、エラー特定を含む構造化された自己批判の作成、そしてその批判に基づいた修正翻訳の生成という多段階のプロンプト処理を行い、追加の学習やラベル付きデータなしで翻訳の忠実度を向上させます。 評価の結果、BLEUおよび意味的妥当性を測るCOMETスコアにおいて統計的に有意な改善が確認され、特にCOMETにおいて顕著な向上が見られたことから、推論時の自己修正ステップが低リソース言語の翻訳品質を効果的に高めることが実証されました。

なぜこの問題か

機械翻訳(MT)は、人間を介さずに異なる言語間で情報を交換することを可能にする極めて重要な技術ですが、その効果は言語的な正確さ、意味の忠実度、そして文脈の一貫性に大きく依存しています。近年の大規模言語モデル(LLM)は、特定のタスクに向けた微調整を行わなくても強力な翻訳性能を示していますが、リソースが乏しい言語の設定においては依然として大きな課題が残されています。具体的には、isiZulu(イシズールー語)やisiXhosa(イシコサ語)といったアフリカの言語では、学習に利用できる並列コーパスが極めて限定的であり、言語的なリソースも不足しています。このような低リソースな環境では、翻訳モデルが「ハルシネーション(幻覚)」を引き起こしたり、重要な情報を省略したり、意味を不自然に歪めて出力したりする問題が頻繁に発生します。これは、モデルがターゲット言語の構造や語彙を十分に学習できていないために起こる現象です。 これまでの研究では、モデルに自らの出力を批判させ改善させる「自己内省(Self-reflection)」の能力が、推論の質や事実の一貫性を向上させることが示唆されてきました。…

核心:何を提案したのか

本論文が提案するのは、構造化された自己内省を通じて低リソース言語の機械翻訳品質を向上させる「内省的翻訳(Reflective Translation)」というプロンプトフレームワークです。この手法の核心は、翻訳を一種の「制約付き推論(Constrained Reasoning)」として捉える点にあります。つまり、ターゲット言語の文章はソース言語の意味を厳密に保持しなければならないという強い制約が存在し、その制約をモデル自身に評価・管理させるアプローチです。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related