命令チューニングのデータはどれを残すべきか:ニューロン活性で選ぶ NAIT の考え方

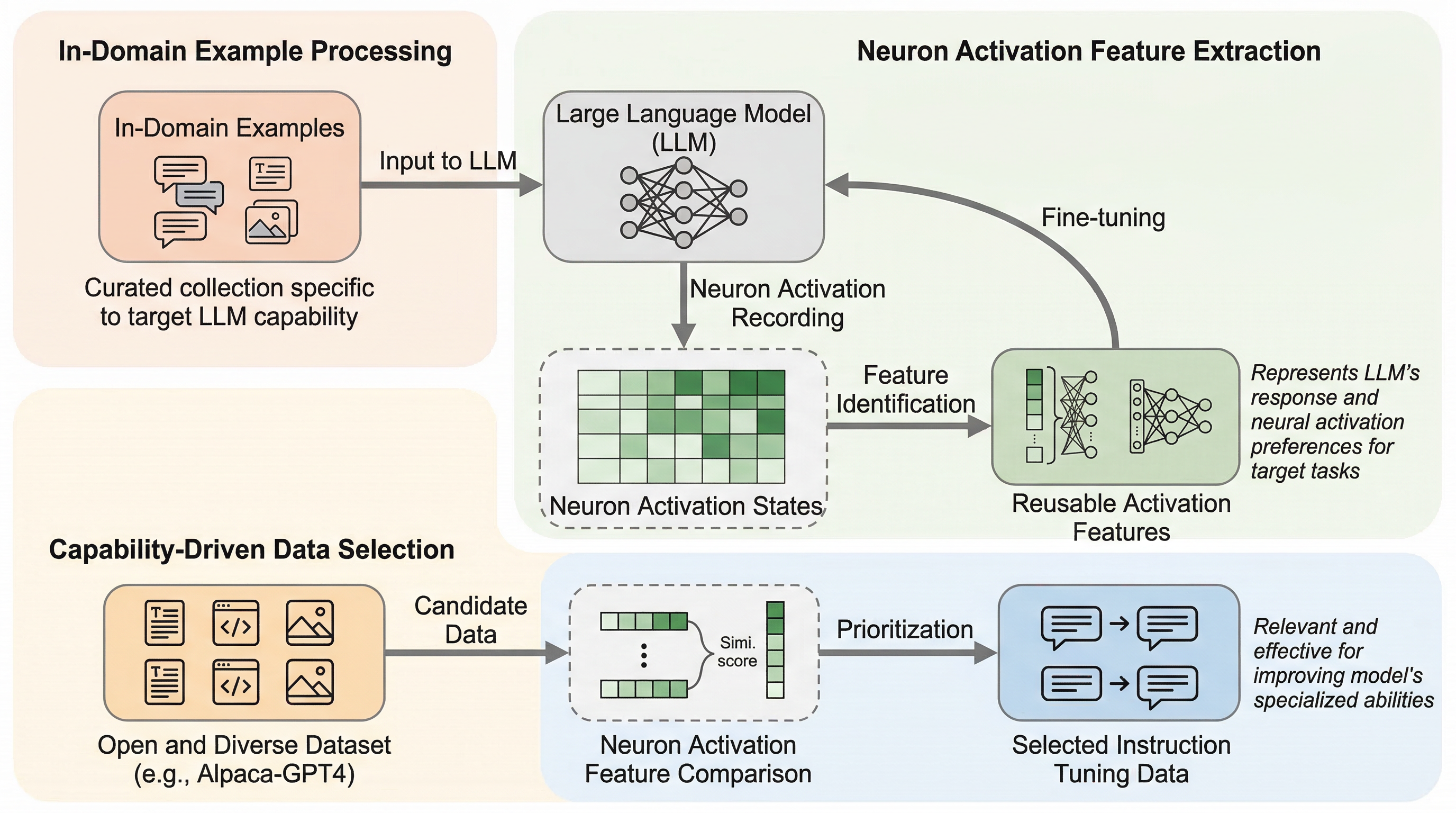

命令チューニングでは、データを増やせば必ず強くなるわけではなく、冗長なデータや狙いとずれたデータは性能を落とすことがあります。NAIT は、モデル内部のニューロン活性が目標能力にどれだけ沿うかを使って、少量でも効くデータを選ぶ枠組みです。 仕組みは、目標能力の in-domain データを通したときの活性方向を抽出し、その方向に近い instruction データだけを高く評価して選ぶ、というものです。外部高性能モデルや不確実性推定より軽く、狙った能力に合わせてデータ選別できます。 実験では、Alpaca-GPT4 全量での instruction tuning や既存の選別法より、Alpaca-GPT4 の 10% を NAIT で選んだほうが平均性能が上がり、論理推論やプログラミング由来の活性特徴が広い転移性を持つこと、さらに複数タスクで共通に効く安定したコア部分集合があることも示されました。

TL;DR(結論)

- 命令チューニングでは、データを増やせば必ず強くなるわけではなく、冗長なデータや狙いとずれたデータは性能を落とすことがあります。NAIT は、モデル内部のニューロン活性が目標能力にどれだけ沿うかを使って、少量でも効くデータを選ぶ枠組みです。

- 仕組みは、目標能力の in-domain データを通したときの活性方向を抽出し、その方向に近い instruction データだけを高く評価して選ぶ、というものです。外部高性能モデルや不確実性推定より軽く、狙った能力に合わせてデータ選別できます。

- 実験では、Alpaca-GPT4 全量での instruction tuning や既存の選別法より、Alpaca-GPT4 の 10% を NAIT で選んだほうが平均性能が上がり、論理推論やプログラミング由来の活性特徴が広い転移性を持つこと、さらに複数タスクで共通に効く安定したコア部分集合があることも示されました。

なぜこの問題か

Instruction Tuning は、大規模言語モデルに「指示に従う」「潜在能力を表面化させる」「下流タスク性能を伸ばす」という三つの役割を担わせる重要な工程です。ところが、最近の知見ではデータを多く入れればよいとは言えず、過剰な instruction データはむしろ性能を落としうると報告されています。LIMA が 1,000 件規模の高品質データで強い性能を出したことは、その象徴です。

核心:何を提案したのか

提案手法 NAIT は、Neuron-Aware Instruction Tuning data selection の略で、ターゲット能力に関連するニューロン活性パターンをもとに instruction データを選ぶ枠組みです。考え方の芯は非常に明快です。モデルがあるサンプルを処理したとき、その活性パターンが目標能力の活性特徴に近いほど、そのサンプルはその能力の向上に寄与しやすい、とみなします。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related