DecoVLN:観測・推論・補正を分離して長距離の視覚言語ナビゲーションを安定化する

視覚言語ナビゲーションでは、長い指示に従って移動する間に観測履歴が膨らみ、しかも途中の小さな行動ミスが累積して大きな逸脱へつながるため、長期記憶と誤り修正の両方がボトルネックになります。 DecoVLN は、観測と推論を分離したうえで、指示との関連性・見た目の多様性・時間的な広がりを同時に見る適応的メモリ精製と、trusted region 内の状態行動対だけを集める補正学習を組み合わせます。 R2R と RxR の Val-Unseen で同条件の既存法を上回り、R2R では SR 56.3、SPL 50.5、RxR では SR 54.2、SPL 46.3、nDTW 63.5 を達成し、実環境デモでも頑健性を示しました。

TL;DR(結論)

- 視覚言語ナビゲーションでは、長い指示に従って移動する間に観測履歴が膨らみ、しかも途中の小さな行動ミスが累積して大きな逸脱へつながるため、長期記憶と誤り修正の両方がボトルネックになります。

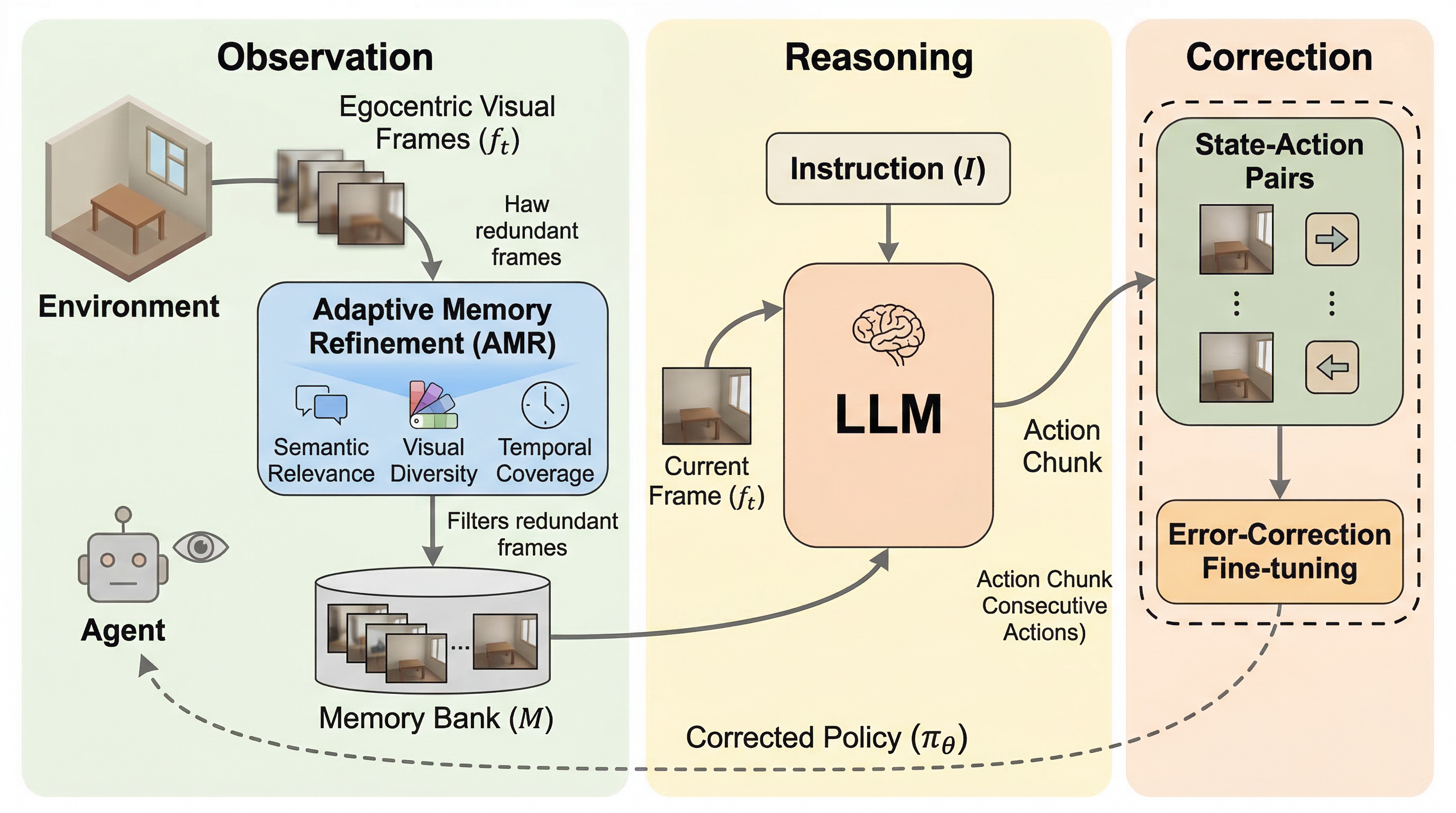

- DecoVLN は、観測と推論を分離したうえで、指示との関連性・見た目の多様性・時間的な広がりを同時に見る適応的メモリ精製と、trusted region 内の状態行動対だけを集める補正学習を組み合わせます。

- R2R と RxR の Val-Unseen で同条件の既存法を上回り、R2R では SR 56.3、SPL 50.5、RxR では SR 54.2、SPL 46.3、nDTW 63.5 を達成し、実環境デモでも頑健性を示しました。

なぜこの問題か

Vision-and-Language Navigation は、自然言語の指示を読み取り、未知の 3D 環境を自律移動する課題です。短い経路なら、いま見えている視界と直前の行動だけで何とかなることもあります。しかし実際の指示は長く、曲がり角やランドマークの記述が複数続き、途中で見える景色も連続的に変わります。すると、過去に見た重要な手掛かりを適切に覚えつつ、現在の視界に合わせて方針を微調整しなければなりません。

核心:何を提案したのか

提案の中心は DecoVLN です。名前のとおり、Observation、Reasoning、Correction を分離して設計しています。移動しながら継続的に視界を取り込み、すべてをそのまま推論へ渡すのではなく、まずメモリ側で価値の高いフレームだけを残します。その圧縮された履歴と最新の視界をもとに、行動 chunk をまとめて出力し、さらに trusted region 内で得られた状態行動対で補正学習を行います。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related