ESPIRE:VLMの身体化空間推論を「位置特定」と「実行」に分けて診断するベンチマーク

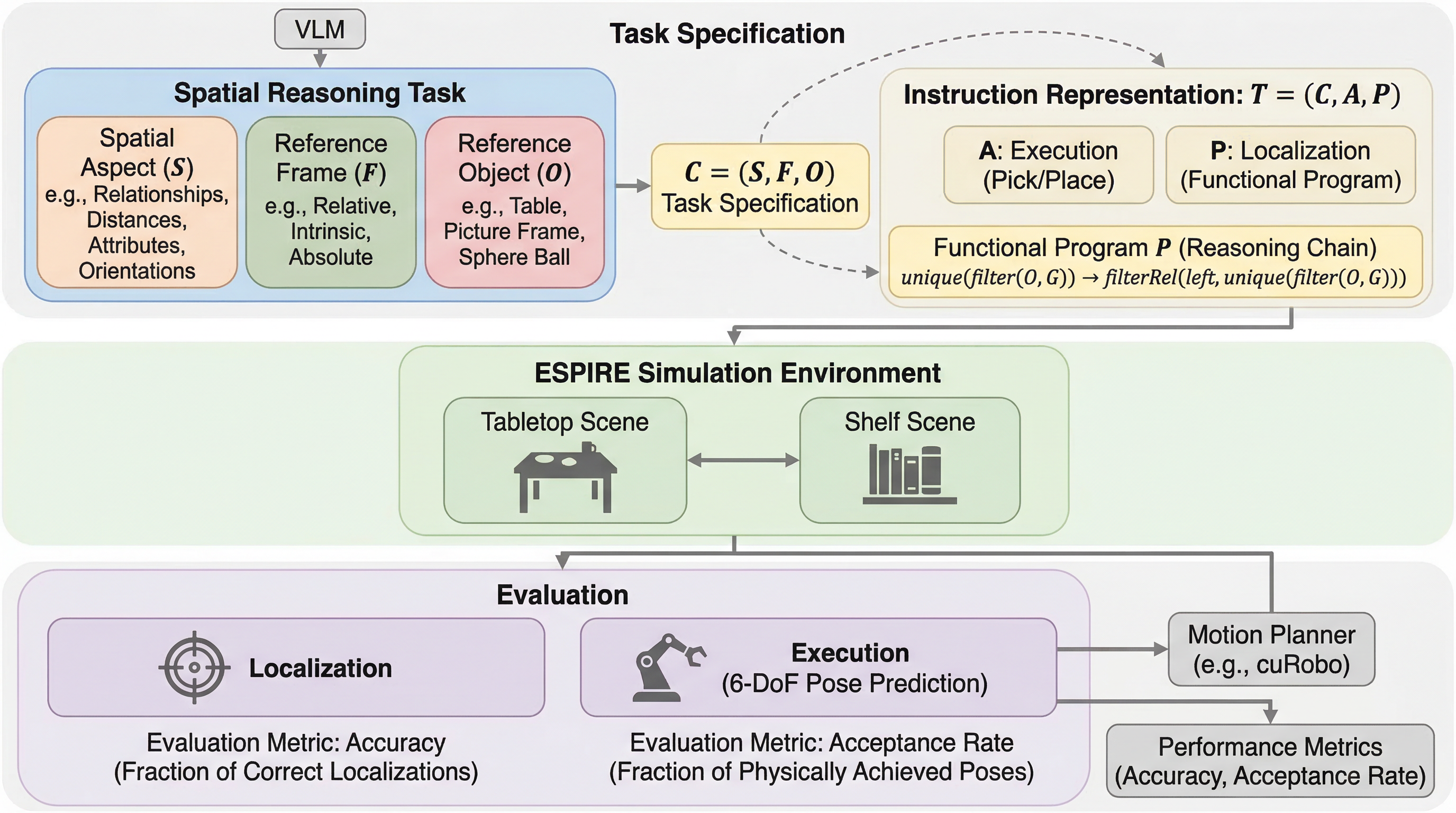

ESPIRE は、Vision-Language Model の身体化空間推論を、静的なVQAではなく、物理シミュレーション上のロボット課題として評価する診断ベンチマークであり、位置特定と動作実行をどちらも生成問題として扱います。 148種類の空間推論タイプ、65の命令ファミリ、計2,220タスクという広い設計により、距離・向き・関係・参照枠のどこで崩れるかを細かく見られるようにしています。 実験では、VLMは概して「対象がどこにあるか」はそこそこ分かる一方、「そこにどう手を入れ、どの向きで扱うか」は大きく弱く、特に orientation reasoning と place タスクが深いボトルネックであることが示されました。

TL;DR(結論)

- ESPIRE は、Vision-Language Model の身体化空間推論を、静的なVQAではなく、物理シミュレーション上のロボット課題として評価する診断ベンチマークであり、位置特定と動作実行をどちらも生成問題として扱います。

- 148種類の空間推論タイプ、65の命令ファミリ、計2,220タスクという広い設計により、距離・向き・関係・参照枠のどこで崩れるかを細かく見られるようにしています。

- 実験では、VLMは概して「対象がどこにあるか」はそこそこ分かる一方、「そこにどう手を入れ、どの向きで扱うか」は大きく弱く、特に orientation reasoning と place タスクが深いボトルネックであることが示されました。

なぜこの問題か

VLM が画像と言語を扱えるようになり、ロボットや embodied AI へ接続したいという期待は急速に高まりました。ところが、従来の評価は、その期待に対して少し平面的でした。多くのベンチマークは静止画像や動画に対し、「左はどれか」「奥にあるのは何か」といった質問応答をさせます。これ自体は空間理解の一部を測りますが、ロボットが本当に必要とするのは、答えを言えることではなく、対象を定位し、実際に取りに行き、向きを合わせて操作できることです。

核心:何を提案したのか

中心にある提案は、身体化空間推論のための診断ベンチマーク ESPIRE です。ポイントは三つあります。第一に、評価を物理シミュレーション上で行い、視覚と言語の出力がそのままロボット行動に接続される形へ寄せたこと。第二に、タスクを localization と execution に分解し、それぞれを生成問題として扱ったこと。第三に、空間推論の設計を体系化し、どの空間文脈で失敗するのかを細かく追えるようにしたことです。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related