不均衡ドメインにおける汎化のためのネガティブ優位な対照学習

不均衡ドメイン一般化(IDG)において、ドメインシフトとラベルシフトが複雑に絡み合うことで決定境界が歪む問題を解決するため、事後分布の不一致と決定境界のマージンを考慮した新しい理論的汎化境界を導出した。

TL;DR(結論)

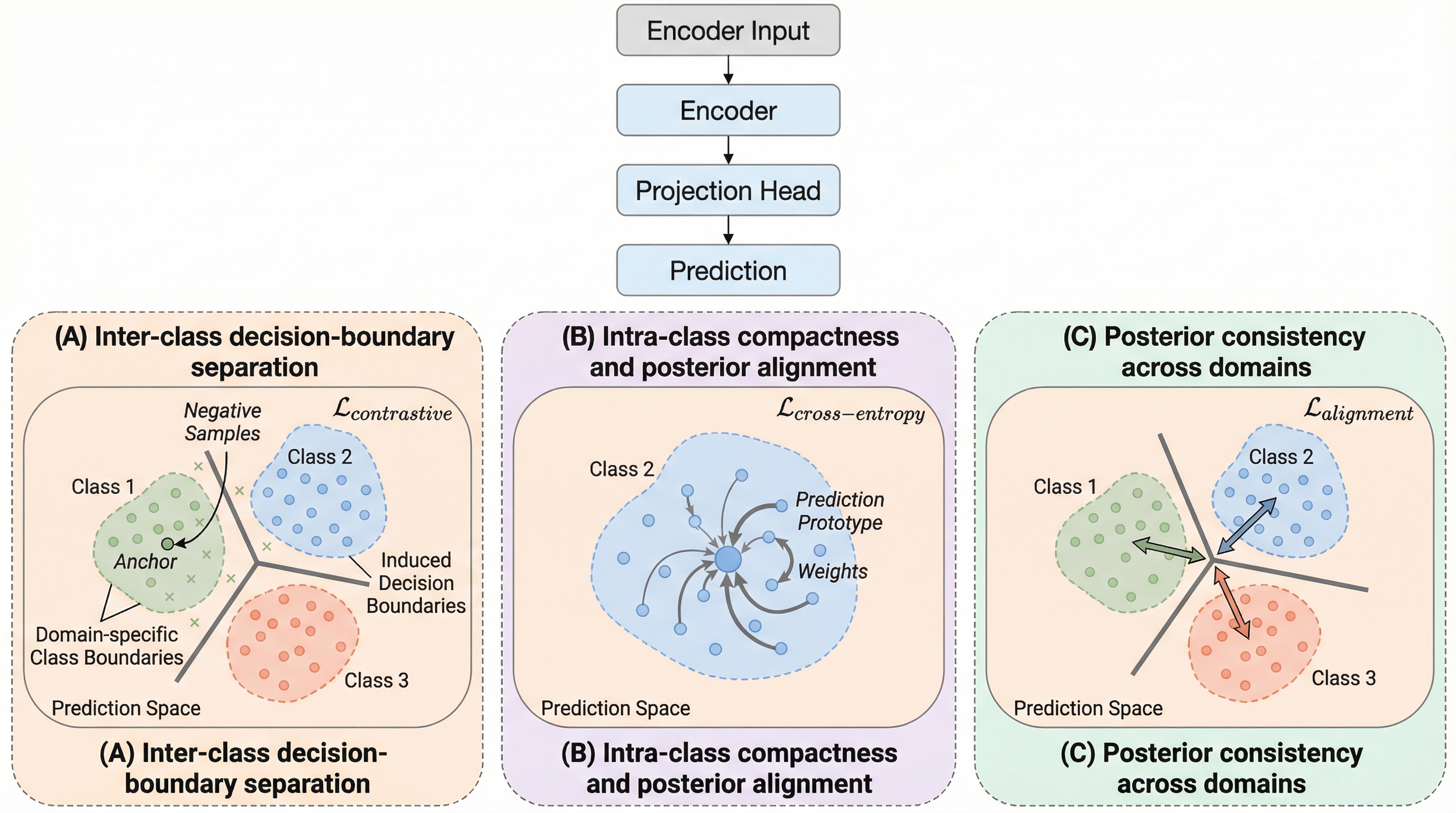

不均衡ドメイン一般化(IDG)において、ドメインシフトとラベルシフトが複雑に絡み合うことで決定境界が歪む問題を解決するため、事後分布の不一致と決定境界のマージンを考慮した新しい理論的汎化境界を導出した。 提案手法のNegative-Dominant Contrastive Learning(NDCL)は、少数クラスでも豊富かつ均衡な「ネガティブサンプル」を主信号として活用し、多数派クラスへの決定境界の偏りを自然に補正する対照学習アルゴリズムである。 主要なベンチマークを用いた広範な実験により、NDCLは21種類の最新手法を上回る性能を示し、特にドメインごとに異なる不均衡が存在する困難な設定において、少数派クラスの識別精度と未知ドメインへの汎化能力を大幅に向上させた。

なぜこの問題か

現実世界のアプリケーションでは、天候の変化やスタイルの違いといったドメインシフトに加え、クラスごとのサンプル数が極端に偏るラベルシフトが同時に発生することが一般的である。例えば、特定の医療機関において希少な細胞タイプが極端に少なく、他の機関では異なる分布を示すといった状況が挙げられる。このような不均衡ドメイン一般化(IDG)の設定では、ドメイン間の不均一なロングテール分布がモデルの決定境界を著しく歪ませる原因となる。既存のドメイン一般化(DG)研究の多くは、入力空間の分布の違いである共変量シフトの解決に焦点を当てており、ラベル分布がドメイン間で異なるラベルシフトの影響を軽視してきた。 ラベルシフトが存在する場合、単純なドメイン整合戦略を適用すると、異なるクラスのサンプル同士を誤って整合させてしまうリスクがある。例えば、病院Aで多い疾患と病院Bで多い別の疾患を、ドメインの違いを埋めようとするあまり同じ特徴空間に押し込めてしまうといった弊害が生じる。また、サンプルが豊富なドメインやクラスが学習プロセスを支配し、少数派のドメインやクラスの固有の特性が抑制されるという問題もある。…

核心:何を提案したのか

本研究の核心は、IDGにおける汎化性能を保証するための理論的枠組みを構築し、それに基づいた新しい学習アルゴリズム「NDCL」を提案した点にある。まず理論面では、H-divergenceを拡張し、事後分布の不一致と決定境界のマージンを明示的に組み込んだ新しい汎化境界を導出した。この理論は、従来のドメイン一般化理論が入力分布の整合に固執していたのに対し、事後分布の一貫性とクラス間の明確な分離が重要であることを示唆している。不均衡が事後分布を乱し、決定境界を歪ませる様子を数理的に表現したことで、直接的に決定境界を制御する手法の妥当性を裏付けている。 技術的な核心となるNDCLは、クラスの補集合である「ネガティブサンプル」が少数クラスにとっても豊富であり、かつクラス間で比較的均衡しているという観察に基づいている。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related