MoCo:モデル連携研究のためのワンストップショップ

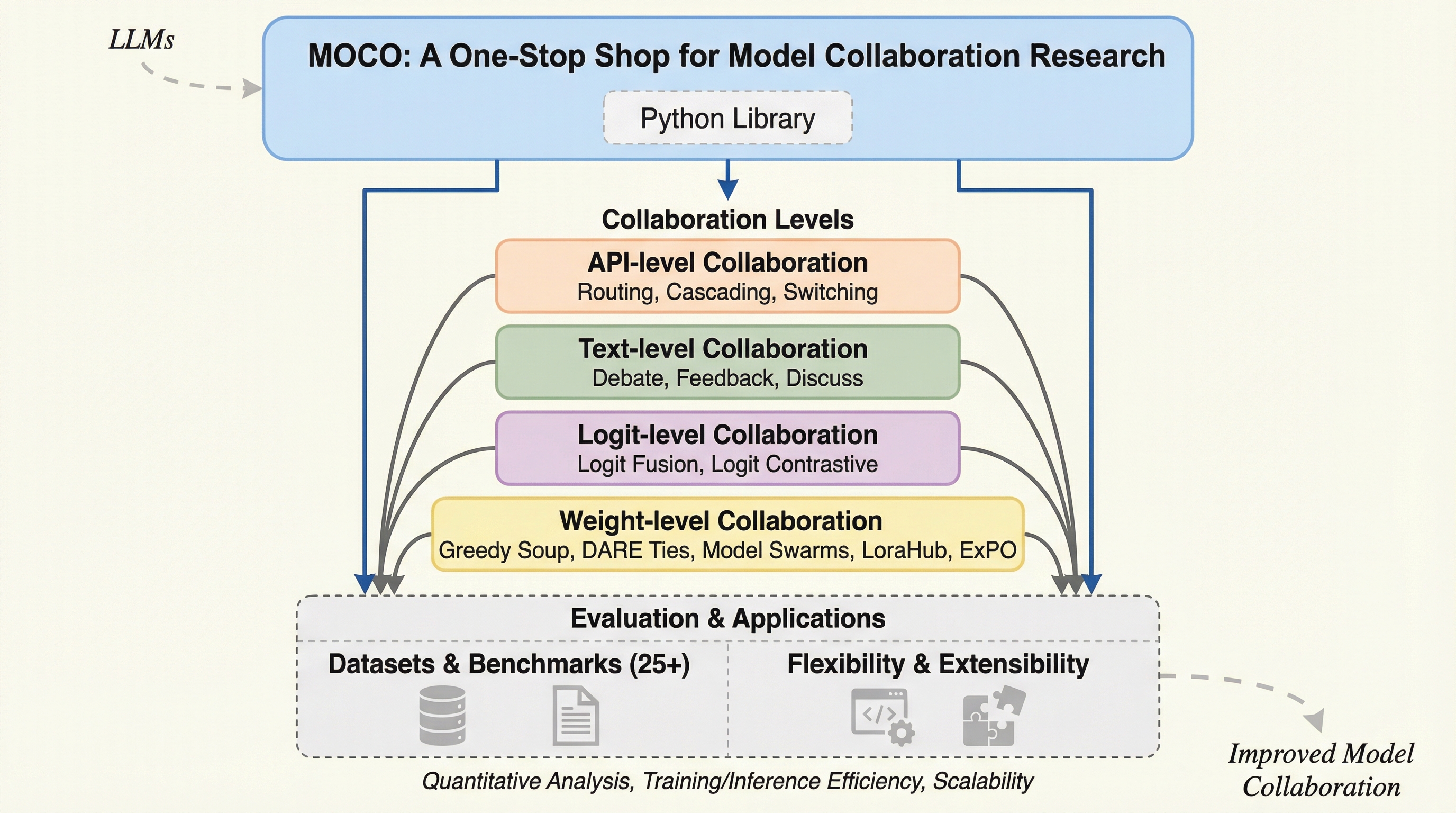

MoCoは、単一の巨大な言語モデルを超えて、複数のモデルが互いに協力し補完し合う「モデル連携」という研究分野を確立し、統合するための包括的なPythonライブラリである。 APIレベルのルーティングからテキストレベルの討論、ロジットの融合、モデル重みのマージまで、4つの階層に分類される26の手法と、25の評価用データセットを一つのフレームワークに集約している。 広範な実験の結果、連携戦略は平均して61.0%の設定で単一モデルを凌駕し、最も効果的な手法では最大25.8%の向上を記録しており、モデル数や多様性の向上が性能向上に直結することを実証した。

TL;DR(結論)

MoCoは、単一の巨大な言語モデルを超えて、複数のモデルが互いに協力し補完し合う「モデル連携」という研究分野を確立し、統合するための包括的なPythonライブラリである。 APIレベルのルーティングからテキストレベルの討論、ロジットの融合、モデル重みのマージまで、4つの階層に分類される26の手法と、25の評価用データセットを一つのフレームワークに集約している。 広範な実験の結果、連携戦略は平均して61.0%の設定で単一モデルを凌駕し、最も効果的な手法では最大25.8%の向上を記録しており、モデル数や多様性の向上が性能向上に直結することを実証した。

なぜこの問題か

従来の言語モデル研究は、単一の巨大なモデルを構築することに主眼が置かれてきたが、近年では複数のモデルを組み合わせる「モデル連携」の重要性が認識されつつある。モデル連携とは、異なるデータで訓練され、異なる得意分野を持つ複数のモデルが、互いに議論し、役割を分担し、補完し合うことで複雑な問題を解決するアプローチを指す。しかし、この分野の研究はこれまで、自然言語処理の異なる研究コミュニティによってバラバラに行われており、手法間の直接的かつ厳密な比較が不足していた。例えば、ある研究ではモデル間の議論(Debate)に焦点を当て、別の研究ではモデルの重みを統合するマージ手法を提案するといった具合に、個別の課題に対する場当たり的な解決策として扱われることが多かった。 このような断片的な状況は、モデル連携を一つの体系的な学問体系として確立する上での大きな障害となっている。また、既存の手法を大規模に評価するための統一されたインフラストラクチャが存在しないため、どの手法がどのような状況で最適なのかを判断することが困難であった。…

核心:何を提案したのか

本研究では、モデル連携研究を加速させるためのワンストップなプラットフォームとして「MoCo」を提案している。MoCoは、モデル連携アルゴリズムの実行、ベンチマーク、および比較を大規模に行うことができるPythonライブラリである。このライブラリの最大の特徴は、モデル間で行われる情報交換のレベルに応じて、連携手法を4つの階層に分類して整理している点にある。具体的には、APIレベル、テキストレベル、ロジットレベル、そして重みレベルの4層である。MoCoには、これら4つの階層にわたる合計26種類のモデル連携手法が実装されており、既存の主要なアルゴリズムを網羅している。 さらに、推論、質疑応答、コーディング、安全性、数学、科学など、多岐にわたる分野をカバーする25種類の評価用データセットが組み込まれている。ユーザーはこれらの既存データセットを利用するだけでなく、独自のデータやプロンプトを柔軟に持ち込んで評価を行うことも可能である。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related