LatentMem: マルチエージェントシステムのためのカスタマイズ可能な潜在メモリ

大規模言語モデル(LLM)を用いたマルチエージェントシステム(MAS)において、従来のメモリ設計が抱えていた「役割に応じたカスタマイズの欠如によるメモリの均質化」と「膨大な履歴データによる情報の過負荷」という2つの根本的なボトルネックを解決するため、学習可能な潜在メモリフレームワーク「LatentMem」が提案されました。 このフレームワークは、生の対話軌跡を保存する軽量な経験バンクと、エージェントの役割プロファイルに基づいてコンパクトな潜在メモリを生成するメモリコンポーザーで構成されており、タスクレベルの報酬信号を直接メモリ生成に反映させる「潜在メモリポリシー最適化(LMPO)」によって最適化されます。 実験の結果、LatentMemは既存のメモリ手法と比較して最大19.36%の性能向上を達成し、トークン使用量を50%削減、推論時間を約3分の2に短縮することに成功したほか、未知のドメインやシステムに対しても高い汎用性と適応性を示すことが確認されました。

TL;DR(結論)

大規模言語モデル(LLM)を用いたマルチエージェントシステム(MAS)において、従来のメモリ設計が抱えていた「役割に応じたカスタマイズの欠如によるメモリの均質化」と「膨大な履歴データによる情報の過負荷」という2つの根本的なボトルネックを解決するため、学習可能な潜在メモリフレームワーク「LatentMem」が提案されました。 このフレームワークは、生の対話軌跡を保存する軽量な経験バンクと、エージェントの役割プロファイルに基づいてコンパクトな潜在メモリを生成するメモリコンポーザーで構成されており、タスクレベルの報酬信号を直接メモリ生成に反映させる「潜在メモリポリシー最適化(LMPO)」によって最適化されます。 実験の結果、LatentMemは既存のメモリ手法と比較して最大19.36%の性能向上を達成し、トークン使用量を50%削減、推論時間を約3分の2に短縮することに成功したほか、未知のドメインやシステムに対しても高い汎用性と適応性を示すことが確認されました。

なぜこの問題か

大規模言語モデル(LLM)を基盤としたマルチエージェントシステム(MAS)は、複数のエージェントが協力または競争することで、個別のエージェントの能力を超える複雑なタスクを解決する強力な枠組みとして台頭しています。このシステムの成功において中心的な役割を果たすのがマルチエージェントメモリであり、これはエージェントが他者や環境との相互作用を通じて経験を蓄積、保持、再利用することを可能にし、一貫した調整と継続的な適応を支えるメカニズムです。しかし、既存のメモリ設計には、システムの性能と効率を制限する2つの大きな課題が存在しています。 第一の課題は「メモリの均質化」です。既存の多くの手法は、すべてのエージェントに対して画一的なメモリ戦略を採用しており、エージェントごとの機能的な異質性や役割の違いを無視しています。これにより、各エージェントが自身の役割を遵守する能力が損なわれ、エージェント間でのエラーの相関が増幅されることで、システム全体の堅牢性が弱まり、長期的な適応が妨げられるという問題が生じています。 第二の課題は「情報の過負荷」です。…

核心:何を提案したのか

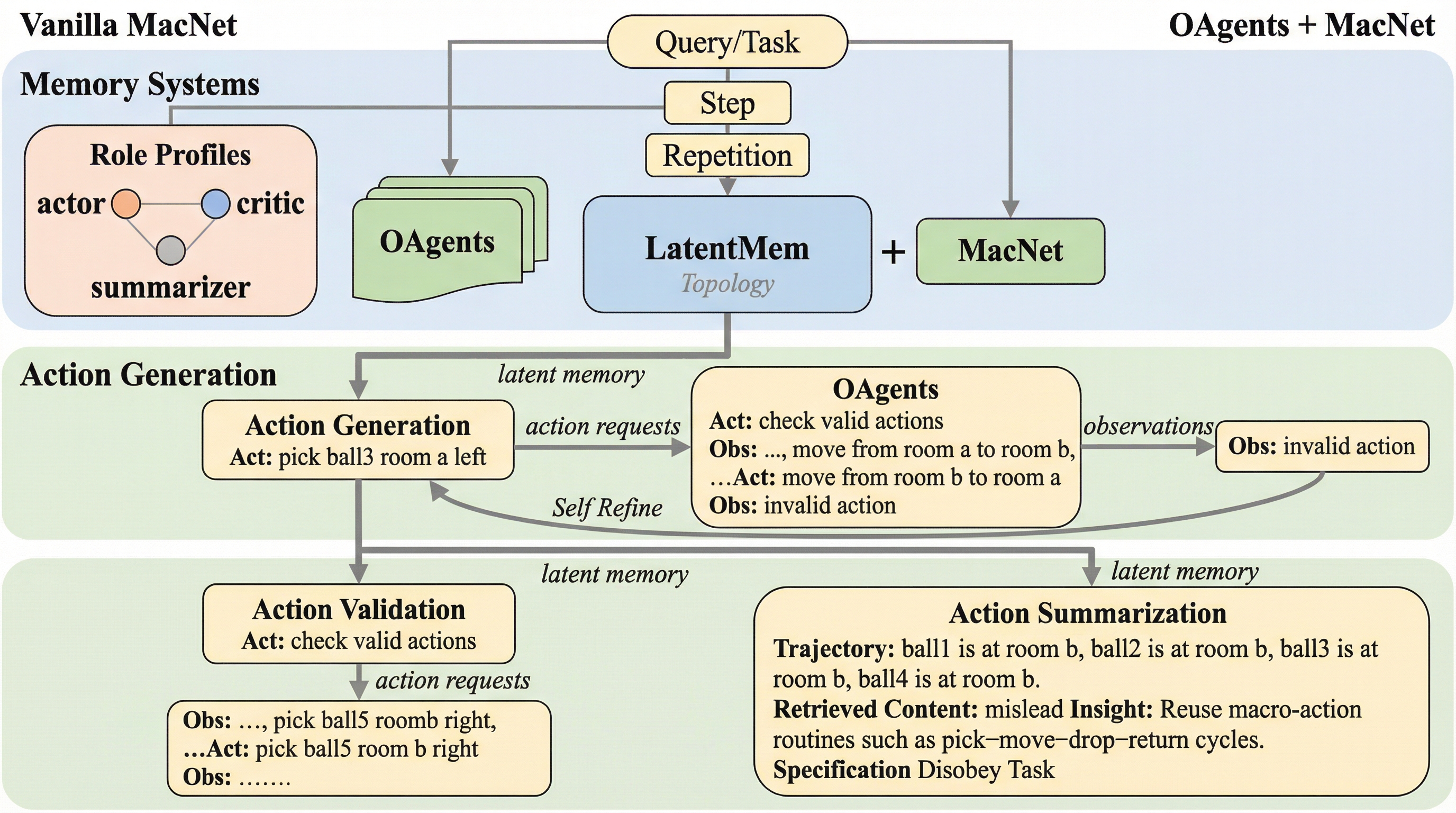

本研究では、トークン効率の高い潜在メモリ生成を通じて、エージェントごとのメモリカスタマイズを実現する新しいフレームワーク「LatentMem」を提案しています。LatentMemは、従来の手動で設計されたメモリパターンに頼るのではなく、潜在空間からエージェント固有の情報を抽出するというアプローチを採用しています。このフレームワークは、主に「経験バンク」と「メモリコンポーザー」という2つのコアコンポーネントで構成されています。 経験バンクは、過去のMAS実行における生の相互作用軌跡を軽量な形式で保存し、必要に応じて検索するためのモジュールです。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related