推論言語モデルの「パラメトリック知識」アクセスを改善する:段階的思考の手がかりとRLVR

数学やコードのように段階的な推論トレースを自動で出せる推論言語モデルでも、モデル内部のパラメータに保存された世界知識を思い出す場面では、最良の知識アクセス用の推論を標準状態で十分に引き出せないことが、閉じた質問応答で確認されています。

TL;DR(結論)

- 数学やコードのように段階的な推論トレースを自動で出せる推論言語モデルでも、モデル内部のパラメータに保存された世界知識を思い出す場面では、最良の知識アクセス用の推論を標準状態で十分に引き出せないことが、閉じた質問応答で確認されています。

- 質問文に短い手がかりとして「think step-by-step」を足すだけで知識リコール指標が統計的に有意に上がる一方、数学ベンチマークでは改善せず悪化する例もあり、知識想起と数学推論が同じ推論習慣で最適化されていない可能性が示されています。

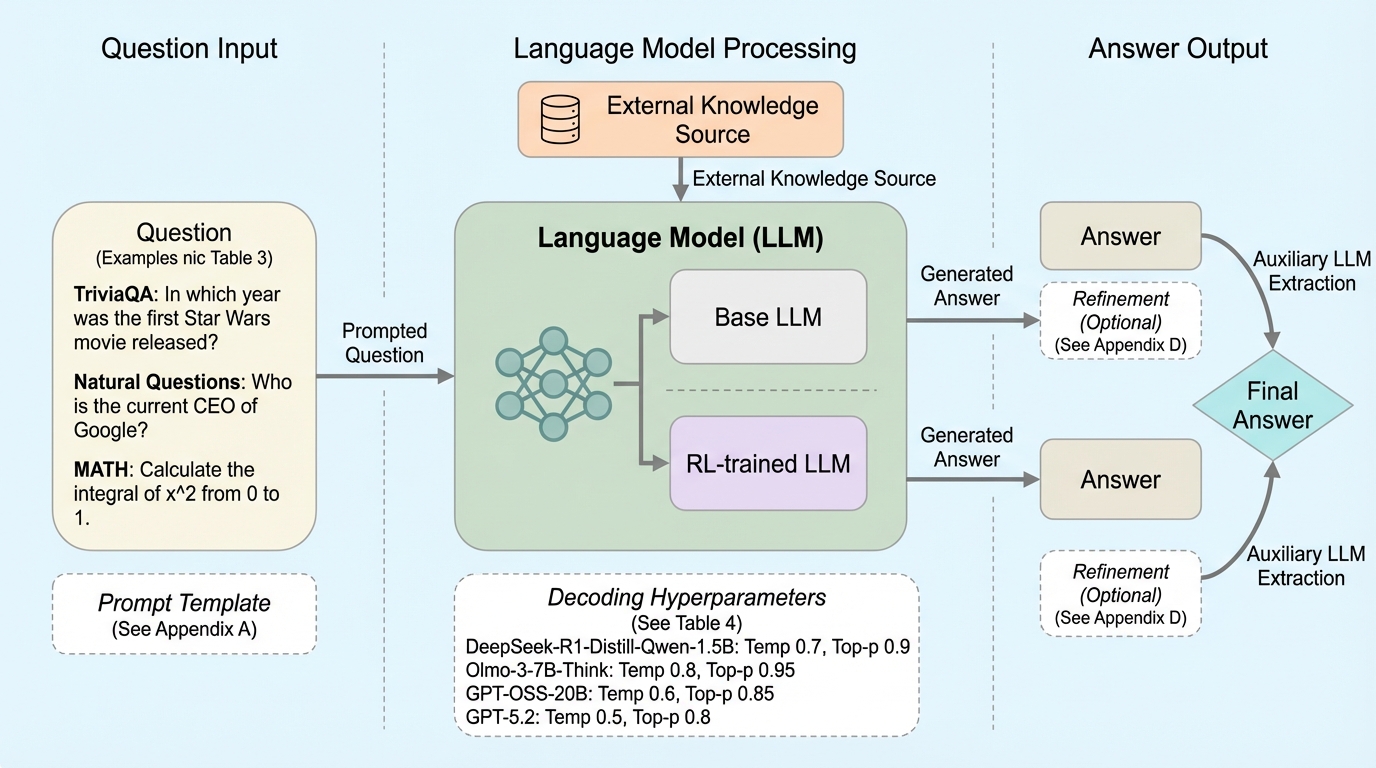

- そこでTriviaQAを用い、最終回答の正しさだけを検証可能な報酬としてRLVRでGPT-OSS-20Bをオンライン学習すると、TriviaQAだけでなくNatural Questions、HotpotQA、SimpleQA、StrategyQAにも性能向上が波及しましたが、推論トレースが人間にとって分かりやすく良くなったかは定性的に捉えにくいと報告されています。

なぜこの問題か

推論言語モデルは、強化学習などを通じて段階的な推論トレースを出力し、数学やコーディングのような多段推論が必要な課題で高い性能を示してきました。ところが、モデルが学習済みパラメータの中に保持している事実知識を「必要なときに思い出す」作業は、数学での演繹手順とは性質が異なる可能性があります。論文では例として、キャンベラがオーストラリアの首都であることを想起する際に、主要都市や計画首都という概念を辿る思考が助けになるかもしれないと述べています。ここで重要なのは、知識想起に役立つ推論が、必ずしも数学のように明確な手順や検証可能な中間過程を持つとは限らない点です。推論トレースを出せること自体と、知識を引き出すために適切な概念連想を自発的に行えることは、同じ能力としては扱いにくいです。 この研究が扱うのは、外部文書を参照しない閉じた質問応答であり、情報源がモデル内部に限定されるため「知っているのに出てこない」というギャップが性能に直結します。著者らは、推論モデルが標準状態で知識想起に最適な推論をしていないなら、わずかな入力上の手がかりや、検証可能な報酬を用いた学習で改善できる余地があると考えています。…

核心:何を提案したのか

提案の中心は二段構えです。第一に、推論言語モデルが閉じた質問応答で世界知識を想起する際、標準のプロンプトだけでは最良の推論を引き出せないことを、簡単な介入で可視化する点です。具体的には、質問に「think step-by-step」という短い手がかりを追加する条件を設け、知識リコール指標が統計的に有意に改善することを示しています。一方で、同じ手がかりが数学ベンチマークでは助けにならず、複数モデルで精度が下がることも同時に観察し、知識想起の推論が数学推論と同じ最適化状態ではないことを示唆しています。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related