チェーンからDAGへ:LLMにおける推論のグラフ構造の探究

大規模言語モデル(LLM)の内部的な推論プロセスは、従来の「思考の連鎖(CoT)」のような単純な線形構造ではなく、複数の前提や分岐、再利用を含む「有向非巡回グラフ(DAG)」として空間的に符号化されていることを明らかにしました。

TL;DR(結論)

大規模言語モデル(LLM)の内部的な推論プロセスは、従来の「思考の連鎖(CoT)」のような単純な線形構造ではなく、複数の前提や分岐、再利用を含む「有向非巡回グラフ(DAG)」として空間的に符号化されていることを明らかにしました。 モデルの中間層にある隠れ状態から、推論ステップの論理的な深さやステップ間の距離といった幾何学的な情報を、軽量な線形プローブを用いて高精度に抽出できることが判明し、推論構造がモデル内部で直接的に表現されていることが示されました。 検証の結果、このグラフ構造の再現性はモデルの規模が大きくなるほど向上し、さらに内部での構造保持の正確さが最終的な回答の正誤と密接に関連していることが確認されたため、モデルの知能や推論の健全性を測る新たな指標としての有効性が示唆されています。

なぜこの問題か

大規模言語モデル(LLM)が複雑な多段階の推論をどのように内部で表現し、計算しているのかを解明することは、人工知能のメカニズムを理解する上で極めて重要な課題となっています。これまでの研究の多くは、推論を「思考の連鎖(Chain-of-Thought)」という概念に基づき、ステップが一つずつ順番に並ぶ線形なプロセスとして捉えてきました。しかし、現実世界における論理的な思考や数学的な証明は、必ずしも一本道ではありません。一つの結論を導き出すために複数の独立した前提を組み合わせたり、途中で得られた中間的な知見を後の複数の場面で再利用したり、あるいは推論の過程が並列的に分岐して後に再び統合されたりすることが一般的です。このような複雑な依存関係を表現するには、単純な鎖状の構造よりも、ノードとエッジで構成される「有向非巡回グラフ(DAG)」の方が自然であり、かつ正確です。 一方で、モデルがテキストとして出力する推論の過程(ラショナール)が、必ずしもモデル内部の実際の計算プロセスを忠実に反映しているとは限らないという懸念も強く指摘されています。…

核心:何を提案したのか

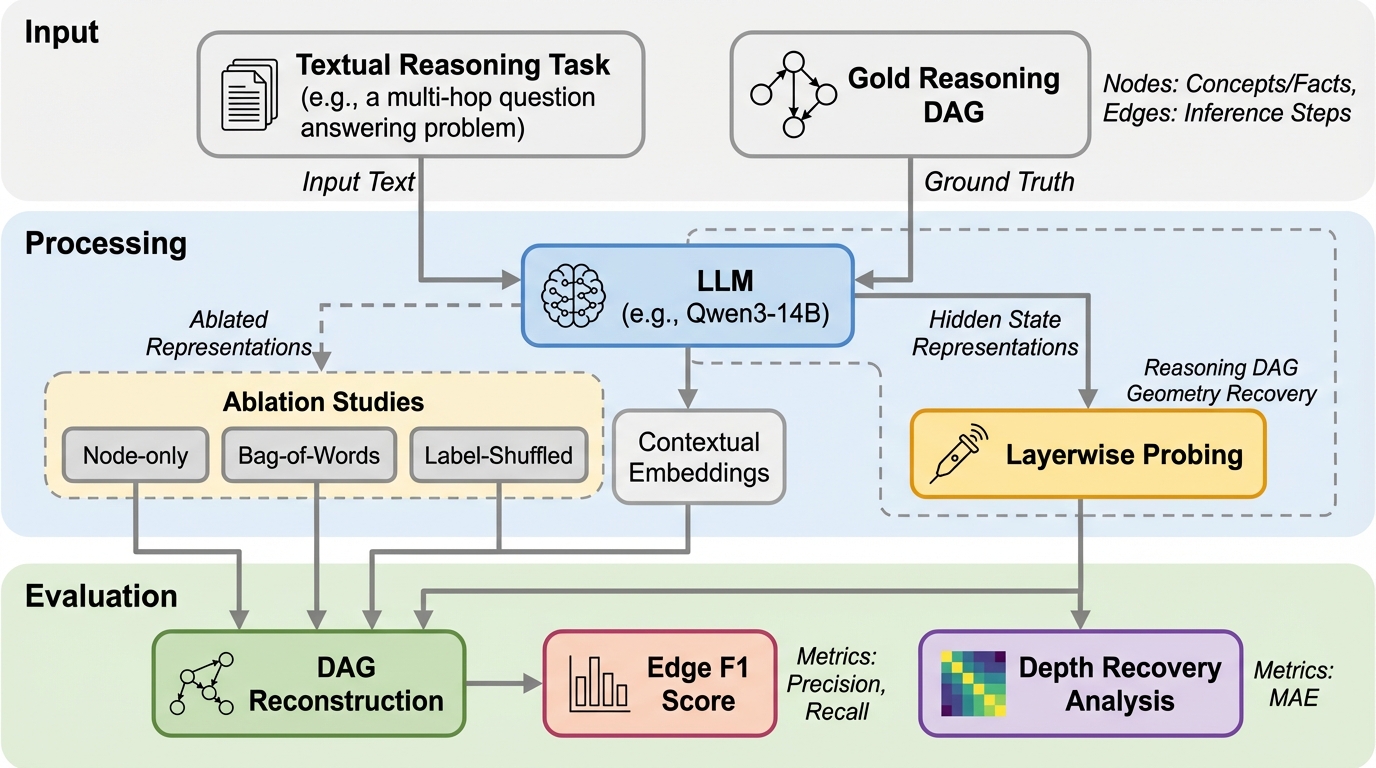

本研究では、LLMの内部表現に推論のグラフ構造がどのようにエンコードされているかを定量的に評価するための新しいフレームワーク「Reasoning DAG Probing」を提案しました。この提案の核心は、推論の各ステップをグラフの「ノード」と見なし、それらの間の論理的な依存関係を「エッジ」として定義した上で、モデルの中間層から得られるベクトル表現(隠れ状態)の中に、グラフの幾何学的なプロパティが線形にアクセス可能な形で存在するかを検証する点にあります。具体的には、各推論ステップが結論からどれだけ離れているかを示す「ノードの深さ」と、二つのステップが論理構造上でどれだけ密接に関連しているかを示す「ノード間の距離」という二つの主要な幾何学的指標を導入しました。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related