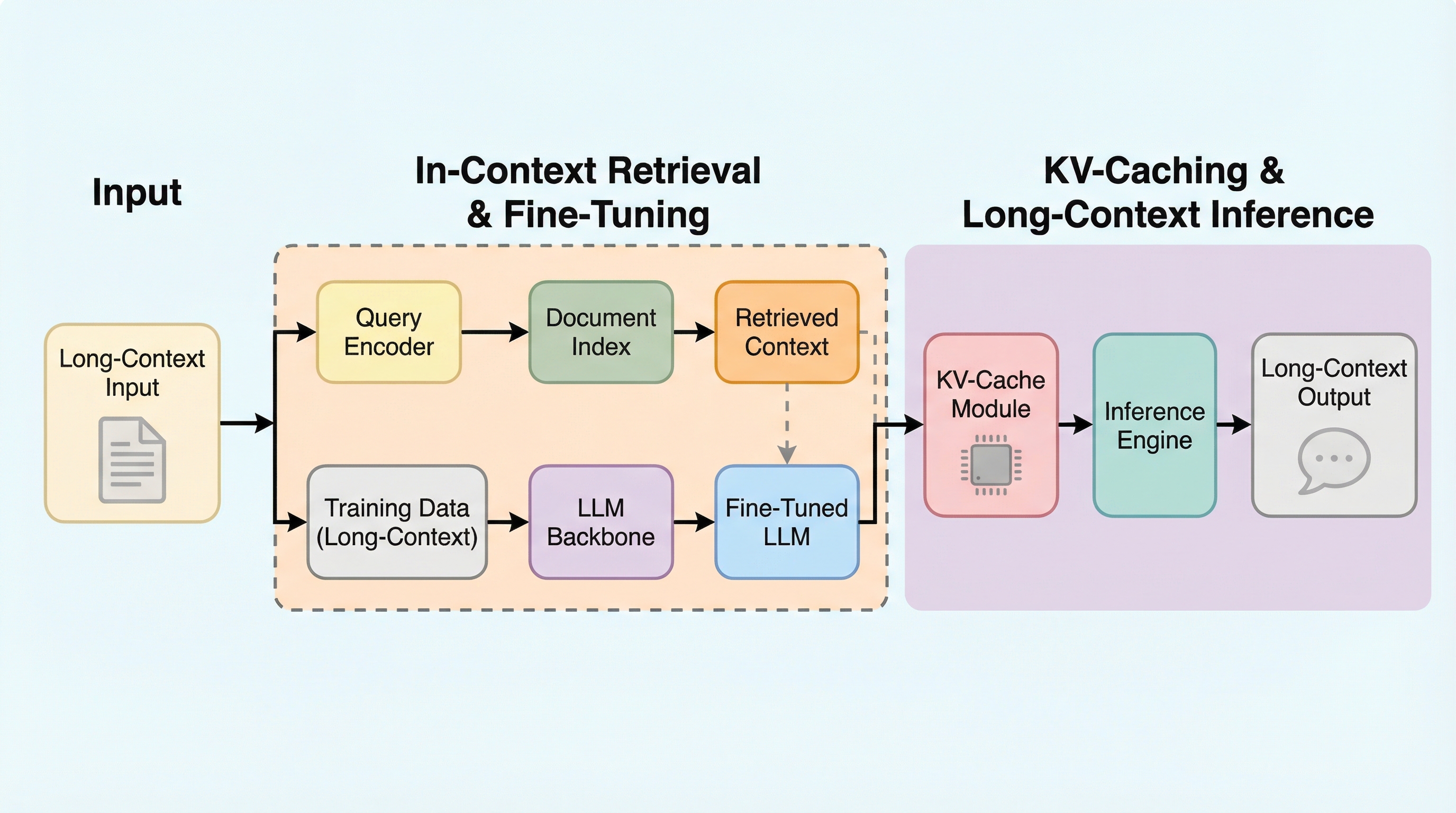

長文コンテキスト言語モデルにおけるインコンテキスト検索と効率的なKVキャッシュのためのファインチューニングの探索

長文コンテキスト言語モデル(LCLM)は数百万トークンの処理が可能ですが、従来のRAG(検索拡張生成)に性能で及ばないことが多いため、本研究ではGRPOを用いた強化学習により、膨大な情報から必要な情報を選択的に抽出・利用する能力の向上を試みました。

TL;DR(結論)

長文コンテキスト言語モデル(LCLM)は数百万トークンの処理が可能ですが、従来のRAG(検索拡張生成)に性能で及ばないことが多いため、本研究ではGRPOを用いた強化学習により、膨大な情報から必要な情報を選択的に抽出・利用する能力の向上を試みました。 実験の結果、特定のドメイン内タスクではベースモデルを最大で20ポイント上回る大幅な改善を達成しましたが、ドメイン外のタスクでは金融分野で9ポイント向上する一方で選択肢問題ではRAGに劣るなど、タスクの性質によって性能の向上幅に大きなばらつきがあることが判明しました。 また、KVキャッシュ圧縮技術に対する頑健性も向上し、推論効率の改善に寄与する可能性が示されましたが、性能向上の主な要因はアテンションによる文書ランキングの精度向上ではなく、ノイズの多い文脈におけるタスク実行の頑健性が高まったことにあると分析されています。

なぜこの問題か

現代の言語モデルは、数百万トークンに及ぶ非常に長い文脈窓を持つようになり、理論上は文書集合全体を一度に読み込ませることが可能となりました。これにより、従来のRAG(検索拡張生成)のように外部の検索パイプラインを構築・管理する手間を省ける可能性があります。しかし、先行研究によれば、依然として標準的なRAGシステムの方が長文コンテキストモデルよりも優れた性能を示すケースが多く、モデルが膨大な入力の中から真に重要な情報を特定して活用する能力には課題が残っています。この性能差は、モデルが文脈内の膨大なノイズに惑わされ、必要な情報に適切に焦点を当てられないことに起因すると考えられています。 また、長文コンテキストを扱う上での大きな障壁として、推論時の計算コストとメモリ消費が挙げられます。特に、キーと値のペアを保存するKVキャッシュのサイズは文脈長に比例して増大するため、これを圧縮する技術が不可欠となっています。しかし、KVキャッシュを圧縮するとモデルの性能が低下することが一般的であり、微調整によってこの性能低下を抑え、頑健性を高めることができるかどうかはこれまで十分に解明されていませんでした。…

核心:何を提案したのか

本研究では、LCLMがインコンテキスト学習においてRAGシステムのように振る舞うことを学習させるために、GRPO(Group Relative Policy Optimization)を用いた強化学習アプローチを提案しました。従来の教師あり微調整(SFT)はモデルを特定の学習経路に固定してしまう傾向がありますが、GRPOを用いることで、モデルが多様な戦略を探索し、どの情報が回答に真に必要かを自ら発見できるようにしました。この手法は、複数の出力をサンプリングし、グループ内での相対的な優位性に基づいてポリシーを更新するため、モデルがより効果的な情報の取捨選択方法を自律的に獲得することが期待されます。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related