ChunkWise LoRA:メモリ効率の良い低ランク適応と高速化されたLLM推論のための適応的シーケンス分割

従来の低ランク適応(LoRA)は、入力される全てのトークンに対して一律に固定されたランクを適用していましたが、本研究ではトークンの複雑さに応じてシーケンスを可変長のチャンクに分割し、動的にランクを割り当てる「ChunkWise LoRA」を提案しました。

TL;DR(結論)

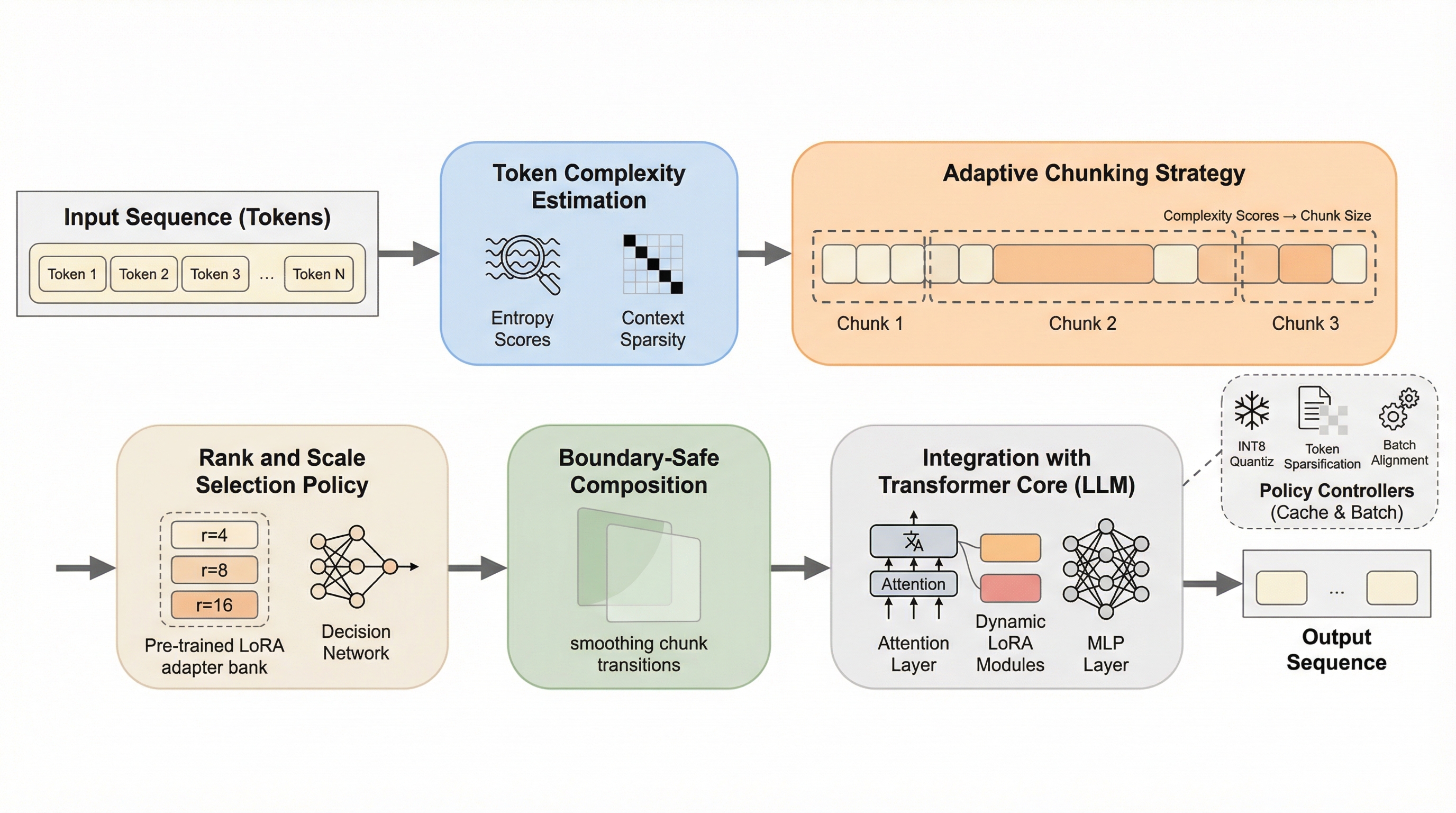

従来の低ランク適応(LoRA)は、入力される全てのトークンに対して一律に固定されたランクを適用していましたが、本研究ではトークンの複雑さに応じてシーケンスを可変長のチャンクに分割し、動的にランクを割り当てる「ChunkWise LoRA」を提案しました。この手法は、定型文のような単純な領域には低いランクを、高度な推論が必要な複雑な領域には高いランクを割り当てることで、計算資源の最適化を図り、LLaMA-7Bにおいて推論遅延を最大34パーセント、メモリ使用量を38パーセント削減することに成功しています。タスクの精度を維持または向上させつつ、既存のFlashAttentionや推論フレームワークと完全な互換性を保っており、再学習なしで実用的な大規模言語モデルの効率的な展開を可能にする画期的なフレームワークです。

なぜこの問題か

大規模言語モデル(LLM)の急速な普及に伴い、特定のドメインやタスクに合わせてモデルを微調整する必要性が高まっています。低ランク適応(LoRA)は、元のモデルの重みを固定したまま少量の学習可能なパラメータを追加することで、効率的な微調整を実現する手法として広く採用されてきました。しかし、既存のLoRA手法には、入力される全てのトークンに対して一律に固定されたランク設定を適用するという根本的な制約が存在します。実際のテキストデータは非常に不均質であり、定型的なプロンプトや予測しやすい表現といった単純な領域と、新しいエンティティの導入や多段階の推論を必要とする複雑な領域が混在しています。 現在のLoRAは、このようなトークンごとの難易度の違いを無視して一律の計算資源を割り当てているため、簡単な領域に対しては過剰な計算を行い、逆に難解な領域に対しては表現能力が不足するという非効率性が生じています。推論時のスループットとメモリ使用量は依然として大きな課題であり、特にリアルタイム性が求められるアプリケーションやリソースが限られた環境での展開において、この固定的なアプローチがボトルネックとなっています。…

核心:何を提案したのか

本研究では、推論時にシーケンスをトークンの複雑さに基づいて可変長のチャンクに分割し、各チャンクに対して最適なLoRAランクとスケーリングを割り当てる「ChunkWise LoRA」という動的なフレームワークを提案しました。この手法の核心は、学習済みの低ランク部分空間を再利用しながら、局所的な難易度に応じてアクティブにする次元の数を柔軟に変更する点にあります。具体的には、ランタイムスケジューラがトークンの難易度をリアルタイムで推定し、それに基づいて適応的なチャンク分割を行い、各チャンクにふさわしいランクを「ランク梯子(rank-ladder)」メカニズムから選択します。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related