AgentLongBench: 環境ロールアウトによるロングコンテキスト・エージェントのための制御可能なロングベンチマーク

大規模言語モデルが自律型エージェントへと進化する中で、動的で膨大なコンテキストの管理が不可欠となっていますが、従来のベンチマークは静的な検索タスクに偏っており、エージェントと環境の複雑な相互作用をシミュレートできていないという課題がありました。

TL;DR(結論)

大規模言語モデルが自律型エージェントへと進化する中で、動的で膨大なコンテキストの管理が不可欠となっていますが、従来のベンチマークは静的な検索タスクに偏っており、エージェントと環境の複雑な相互作用をシミュレートできていないという課題がありました。 本研究では、水平思考パズル(Lateral Thinking Puzzles)に基づき、エージェントが環境やツールとやり取りする過程をシミュレートする「AgentLongBench」を提案し、知識集約型と知識不要型のシナリオ、さらに情報の密度が異なる形式を用いて、最大400万トークンに及ぶ動的なコンテキストにおける推論能力を評価しました。 検証の結果、最新のモデルやメモリシステムは静的な検索には長けているものの、ワークフローに不可欠な動的な情報の統合に苦戦しており、特にツール応答のような高密度な情報を処理する際の「最小必要トークン数(ACL)」が性能低下の主要な要因であることが明らかになりました。

なぜこの問題か

大規模言語モデル(LLM)が単なるチャットボットから自律型エージェントへと急速に進化する中で、複雑なワークフローを実行するために膨大な履歴情報を統合する能力が求められています。エージェントが過去の情報を適切に処理できない場合、推論の断片化やハルシネーション、計画の誤りといった致命的な問題が発生します。しかし、既存の評価フレームワークの多くは、依然として受動的な読解タスクに不釣り合いなほど焦点を当てています。例えば、NeedleBenchやBABILong、L-Evalといった従来のベンチマークは、人工的に連結された文書の中から孤立した事実を見つけ出すような、静的な検索能力を優先して評価する傾向があります。 このようなパラダイムは、エージェントの本質的な行動を見落としています。現実世界での問題解決は、動的なツールの使用や非線形な推論を伴い、エージェント自身の決定に基づいてコンテキストが刻々と進化していくものです。現在のデータセットに見られるような固定されたユーザーとAIの対話とは異なり、自律的な運用ではAIと環境の相互作用による独自の軌跡が生成されます。…

核心:何を提案したのか

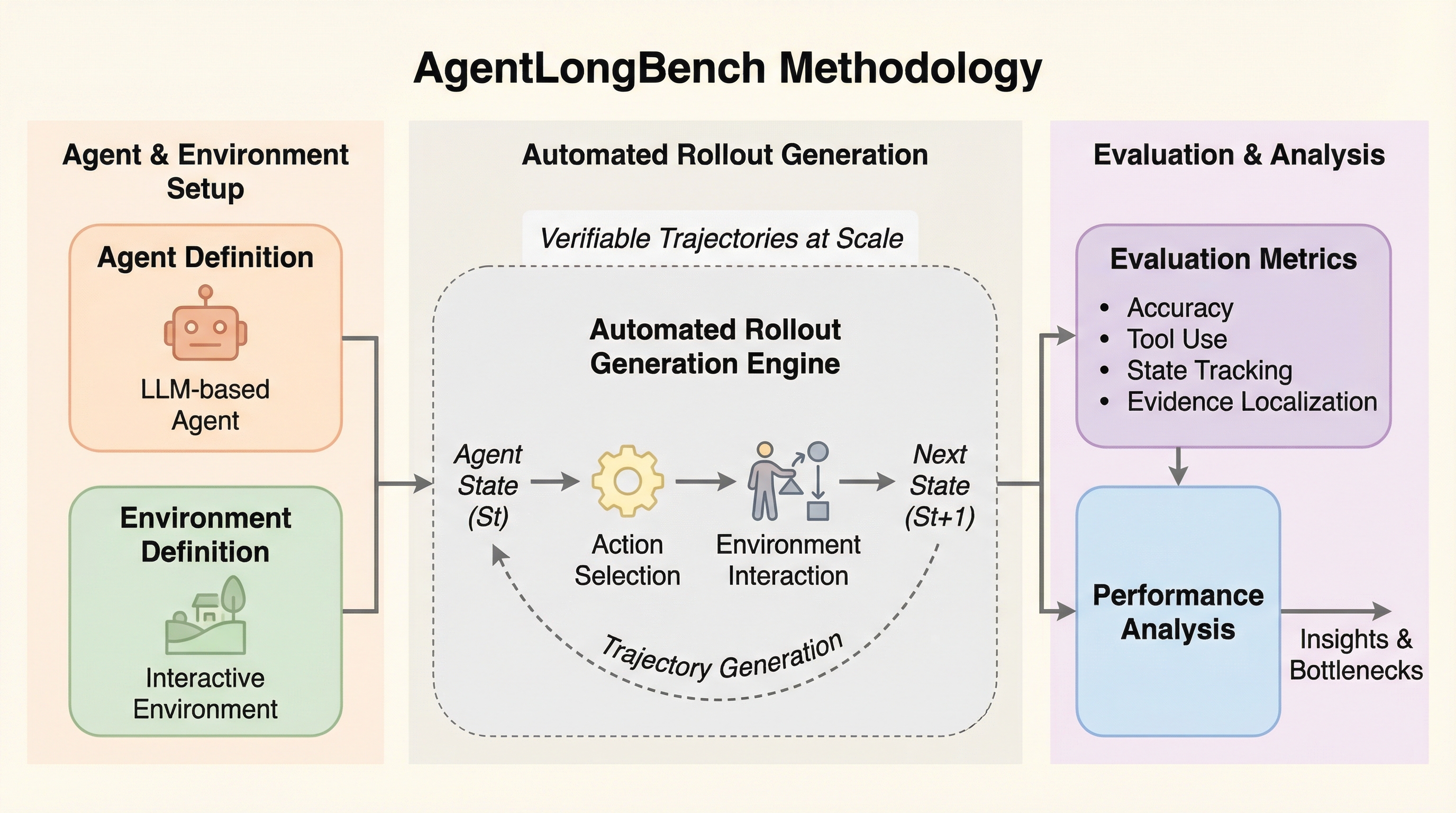

本研究では、環境ロールアウトのシミュレーションを通じてエージェントを評価する、制御可能で拡張性の高いベンチマーク「AgentLongBench」を提案しました。このフレームワークの最大の特徴は、水平思考パズル(Lateral Thinking Puzzles)を基盤としている点にあります。水平思考パズルは、エージェントが論理的な制約を満たしながら、一連の反復的な質問を通じて隠された状態を再構築することを要求します。このプロセスは、自律型エージェントが行う複雑な調査ワークフローの厳密な代理指標として機能します。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related