アテンションパターンが存在する理由:統一的な時間的視点による分析

大規模言語モデル(LLM)のアテンションパターンを統一的に説明する理論的枠組み「TAPPA」を提案し、アテンションが予測可能(Predictable)なものと予測不能(Unpredictable)なものに分類されることを数学的に示した。

TL;DR(結論)

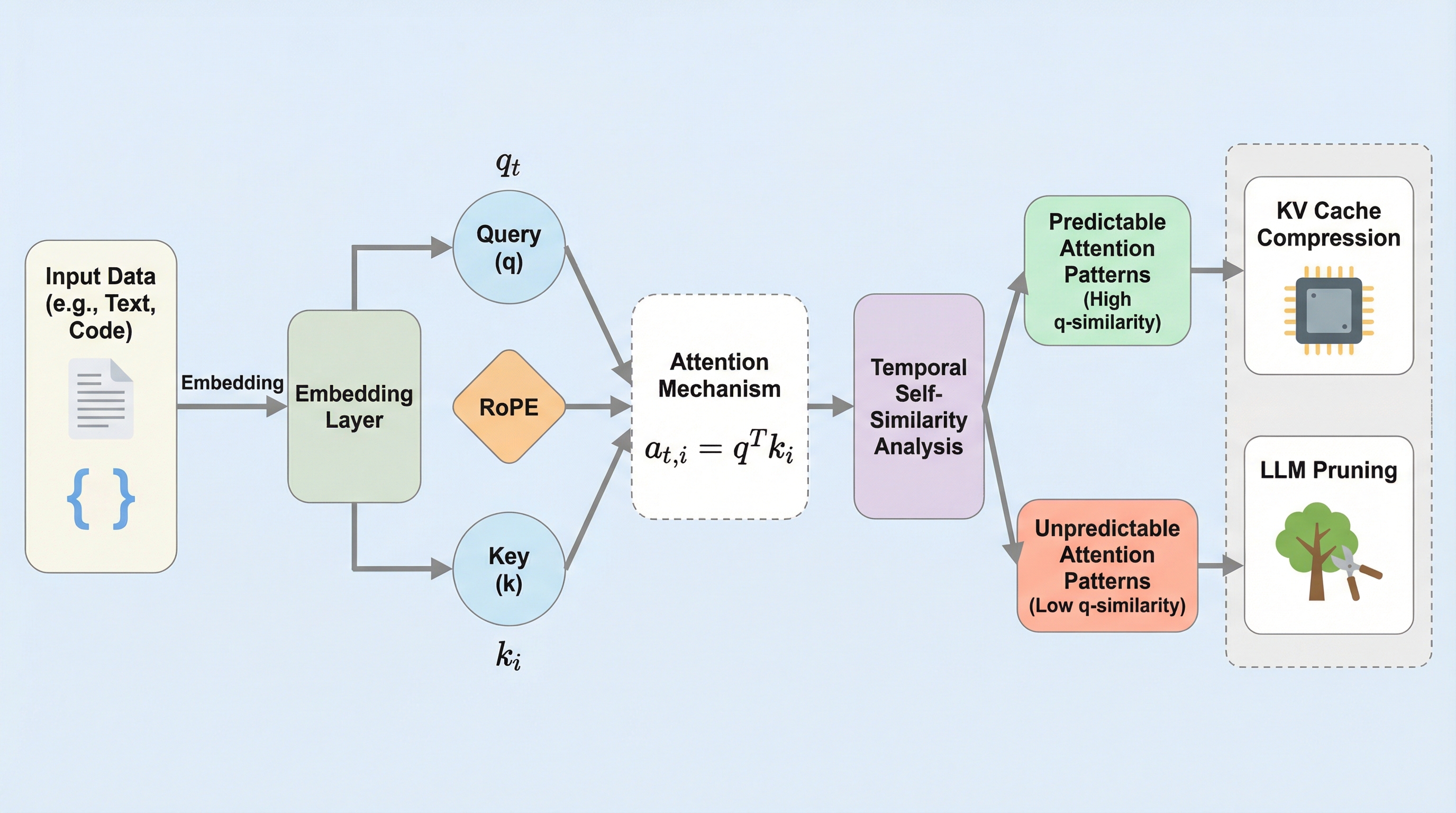

大規模言語モデル(LLM)のアテンションパターンを統一的に説明する理論的枠組み「TAPPA」を提案し、アテンションが予測可能(Predictable)なものと予測不能(Unpredictable)なものに分類されることを数学的に示した。アテンションの挙動を決定する主要な要因はクエリの自己類似性(q-similarity)であり、これが高い場合には垂直方向の再アクセス、対角線状のシーケンシャル、周期的なシーズナルといった構造的なパターンが形成される。この理論をKVキャッシュの圧縮やモデルの枝刈りに応用した結果、提案指標であるq-similarityを用いることで従来手法を上回る性能向上が確認され、推論の効率化とモデルの理解深化に寄与することが実証された。

なぜこの問題か

大規模言語モデル(LLM)のトレーニングと推論において、アテンションパターンは極めて重要な役割を果たしている。これまでの研究では、アテンションシンク、リトリーバルヘッド、対角線状のトレースといった個別のパターンが特定されてきたが、それらの観察は断片的であり、統一的な説明が欠けていた。同じアテンションの定式化の下で、なぜ特定のヘッドが特定のパターンを採用するのかという根本的な要因は、これまで明確にされてこなかった。アテンションメカニズムの概念的な理解を深めることは、モデルの設計や推論戦略の改善に直結するため、非常に重要である。特に、KVキャッシュの圧縮やモデルの枝刈りといった効率化技術を設計する上で、アテンションの挙動を予測する理論的根拠が求められている。 既存の分析の多くは、特定の現象(例えば最初のトークンへのアテンション集中)のみに焦点を当てており、多様なパターンが共存する理由を包括的に説明できていない。また、位置エンコーディング(RoPE)の影響を単独で分析する研究はあるが、動的な入力コンテンツとの相互作用まで完全にモデル化しているものは少ない。…

核心:何を提案したのか

本研究では、自己回帰的な推論を時間的な視点から捉え直し、アテンションパターンの形成を説明する統一フレームワーク「TAPPA(Temporal Attention Pattern Predictability Analysis)」を提案した。TAPPAは、アテンションの分布を時間軸に沿った時系列データとして扱い、その変化の源泉をクエリベクトルの進化に求める。このフレームワークの核心は、アテンションパターンを「予測可能なパターン」と「実質的にランダムに見える予測不能なパターン」の二つに分類した点にある。予測可能なパターンには、再アクセス(Re-access)、シーケンシャル(Sequential)、シーズナル(Seasonal)といった、明確な規則性を持つものが含まれる。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related