ThinkStream:動画を見ながら考え、必要な瞬間だけ答えるストリーミング映像推論

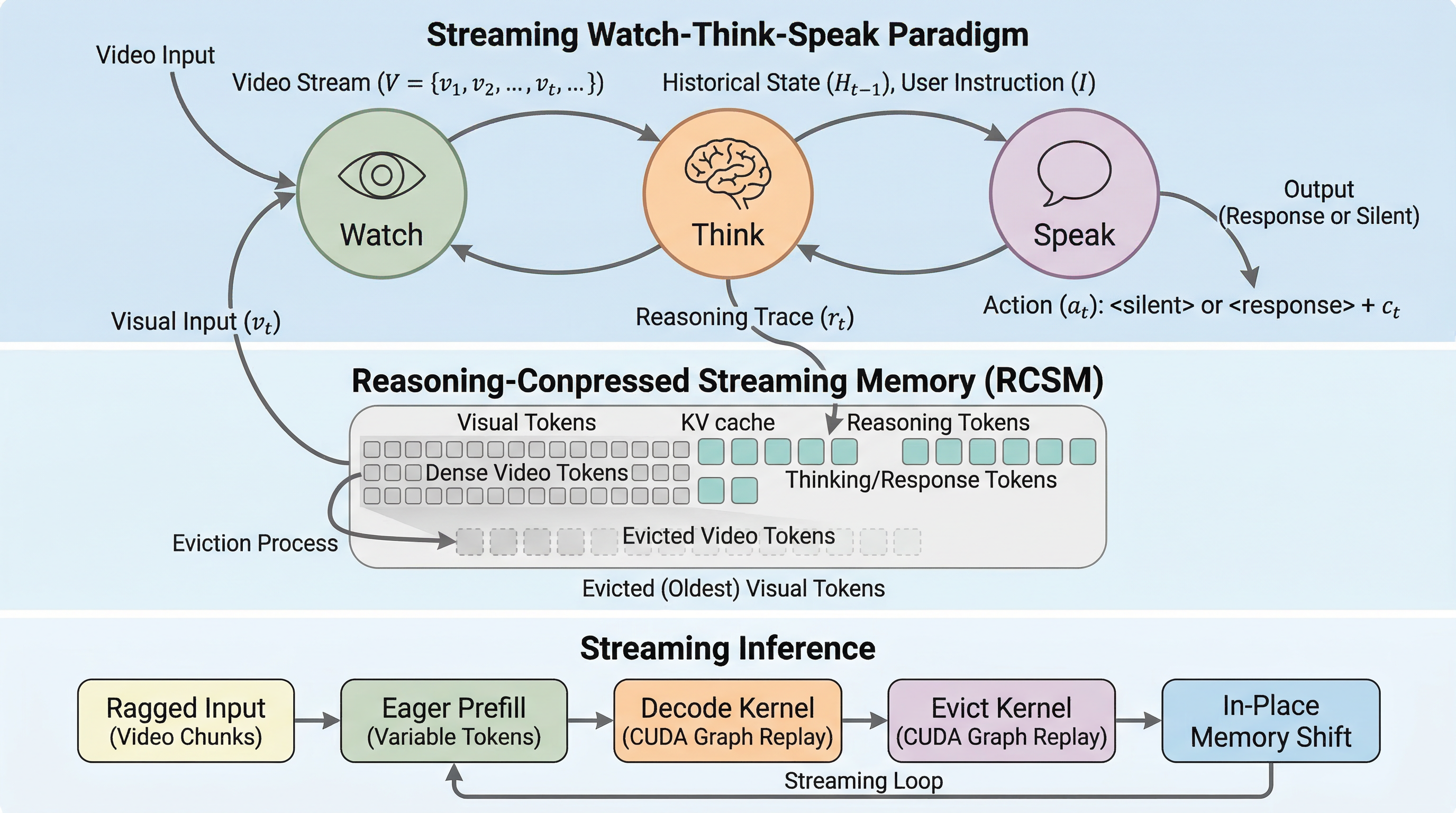

ThinkStreamは、動画を小さな塊ごとに受け取りながら短い推論を更新し、答えるべき瞬間だけ応答する Watch–Think–Speak 方式を導入しました。 中核は、途中の推論トークンを意味圧縮された記憶として残す RCSM と、正答・出力形式・応答タイミングを同時に学習する RLVR です。 OVO-Benchで平均59.66、StreamingBench Real-Timeで平均75.00を達成し、長い動画でも推論遅延を0.5秒未満に抑えながら既存のオンライン系モデルを上回りました。

TL;DR(結論)

- ThinkStreamは、動画を小さな塊ごとに受け取りながら短い推論を更新し、答えるべき瞬間だけ応答する Watch–Think–Speak 方式を導入しました。

- 中核は、途中の推論トークンを意味圧縮された記憶として残す RCSM と、正答・出力形式・応答タイミングを同時に学習する RLVR です。

- OVO-Benchで平均59.66、StreamingBench Real-Timeで平均75.00を達成し、長い動画でも推論遅延を0.5秒未満に抑えながら既存のオンライン系モデルを上回りました。

なぜこの問題か

継続的に流れ続ける動画を相手にするとき、従来の動画推論は根本的に不利です。多くの手法は、十分な文脈がたまってから一度に考えるバッチ型を前提にしています。これだと、答えを返すまで待ち時間が長くなり、動画が長くなるほど計算量もメモリも膨らみます。ユーザーが「まな板どこに置いた?」と尋ねた瞬間に返したい場面では、最後まで見てから考える設計はそもそも用途に合いません。

核心:何を提案したのか

中核提案は Watch–Think–Speak というストリーミング動画推論の定式化です。各時刻で新しい動画チャンクを受け取るたびに、モデルはまず短い reasoning block を生成し、そのうえで二択を行います。十分な証拠がそろっていれば

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related