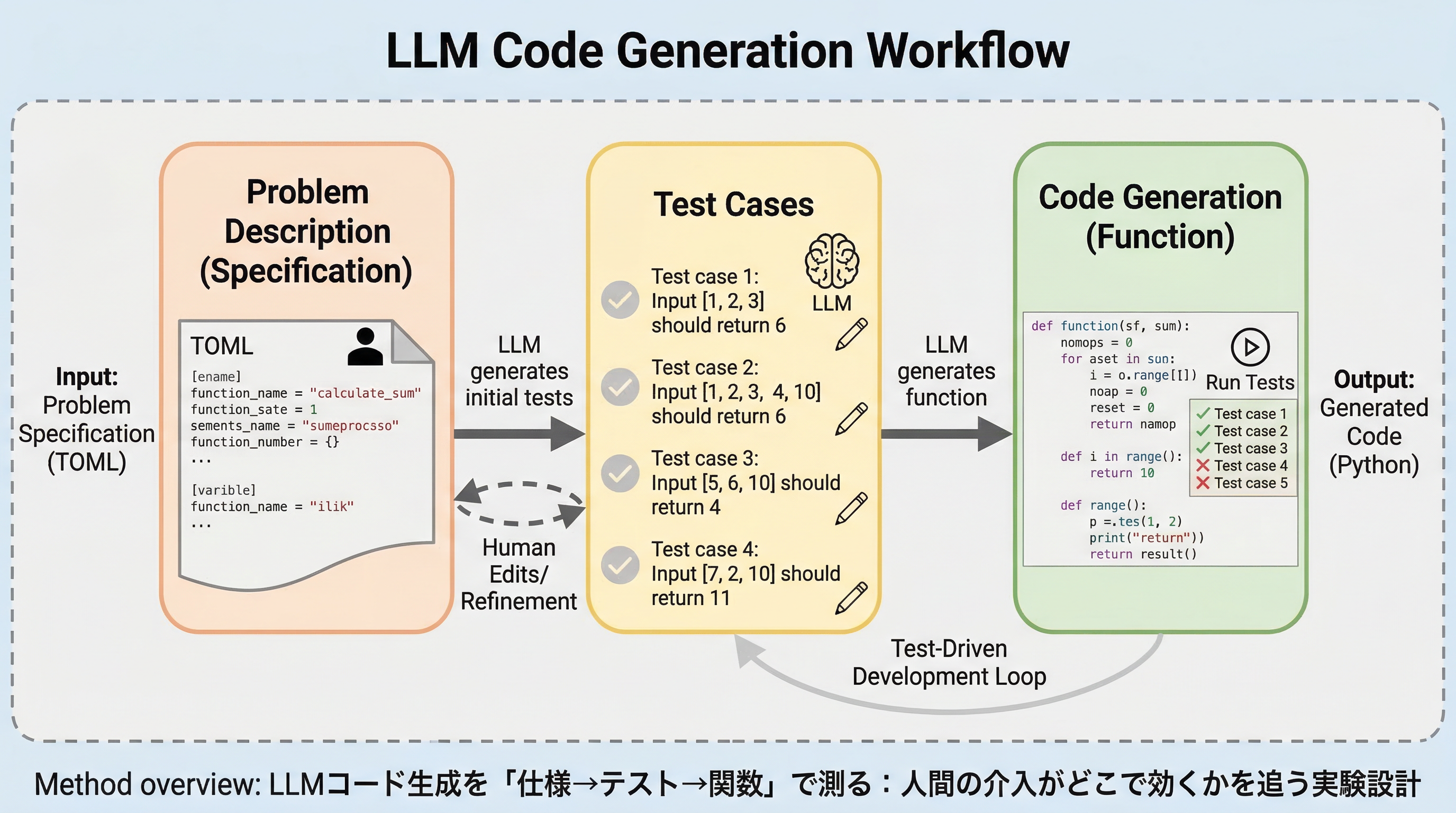

LLMコード生成を「仕様→テスト→関数」で測る:人間の介入がどこで効くかを追う実験設計

CURRANTEというVS Code拡張を使い、仕様記述とテスト精緻化への人間介入がLLMコード生成の正確さと効率にどう効くかを測る登録報告です。

TL;DR(結論)

- この論文は、LLM のコード生成性能そのものを誇る研究ではなく、仕様記述とテスト精緻化への人間の介入が、生成コードの正確さと効率にどう影響するかを測る登録報告です。中核にあるのは CURRANTE という VS Code 拡張で、利用者が「仕様」「テスト」「関数生成」の三段階を順に進める実験環境を作り、その全操作を細かく記録する点にあります。

- 研究の主眼は、単にコードが通ったかではなく、PassAll、PassRate、TestCoverage、TestDiversity、TimeToPass、TestEdits、SuiteRegenerations などを通じて、「人間がどこに手を入れると LLM 生成が良くなるのか」を分解して見ることにあります。つまり、生成モデルだけでなく、人間とツールの協働プロセス全体を評価対象にしているわけです。

- 重要なのは、この論文が Stage 1 Registered Report であり、まだ実験結果を報告する段階ではないことです。それでも価値があるのは、LLM コーディング支援を「なんとなく便利」ではなく、仕様設計・テスト設計・対話ログまで含めて再現可能に測る土台を先に固めているからです。

なぜこの問題か

LLM のコード生成は、いまや開発現場のかなり手前まで入り込んでいます。自然言語で指示を出すと関数や補完候補が返ってきて、そのまま実装を進められる場面も増えました。しかし、その便利さの裏で、何をどこまで人間が明示すべきかは、まだかなり曖昧です。特に、要件を雑に伝えたときに起きる取り違えや、テストの弱さによって見逃されるバグは、単にモデルの能力不足だけでは片づけられません。

核心:何を提案したのか

論文の提案は、新しいコード生成アルゴリズムではありません。提案の中心は、CURRANTE という VS Code 拡張を使って、仕様駆動・テスト駆動の LLM コード生成を観察可能な形にした実験設計です。利用者はまず問題仕様を構造化して入力し、その仕様から LLM が生成したテスト群を見て調整し、最後にそのテストを満たす関数を生成させます。つまり、「仕様 → テスト → 関数」という順序を GUI の中に固定し、その過程で何が起きたかを細かくログとして残せるようにしています。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related