Social-R1:LLMの「答え先行の後付け推論」を抑え、人間らしい社会的推論を鍛える

ToMBench-Hardで社会的推論のショートカットを露出させ、SIPに沿う多次元報酬で推論過程全体を監督するSocial-R1を提案した論文です。

TL;DR(結論)

- この論文の中心は、LLM が社会的推論で使いがちな「答え先行の後付け理由づけ」を正面から問題化し、それを壊すための訓練データと強化学習枠組みをセットで出したことにあります。著者らはこの失敗を Reasoning Parasitism、その代表形を Answer-driven Backfilling と呼び、標準ベンチでは高得点でも本当に心の状態を読めているとは限らないと示します。

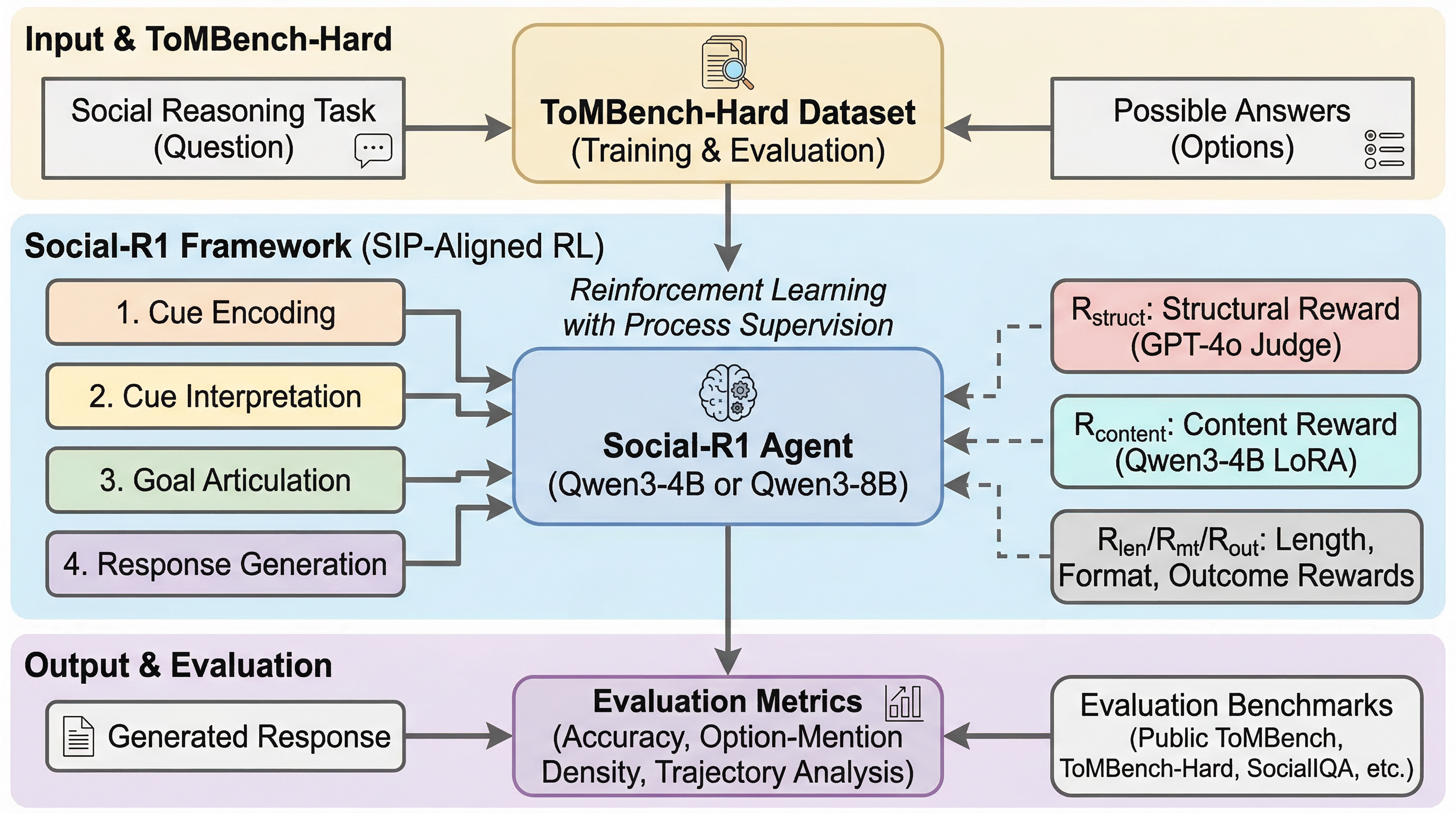

- そのために導入されたのが ToMBench-Hard と Social-R1 です。ToMBench-Hard は信念・欲求・感情・意図・知識などを含む社会的推論を、ショートカットが効きにくい形へ作り替えた難問集合で、Social-R1 は Social Information Processing(SIP)の4段階に沿って、構造整合・内容整合・長さ制御・形式整合・最終正答をまとめて報酬化し、結論だけでなく推論過程全体を監督します。

- 結果として、4B モデルは ToMBench-Hard で GPT-5 や O3 を上回り、8B モデルは8種ベンチマーク平均で 0.7270 を記録して DeepSeek-R1 や GPT-5 を超えました。論文のメッセージは明快で、社会的推論では「正答だけを当てる訓練」では足りず、「どう考えたか」をそろえる報酬設計が効く、ということです。

なぜこの問題か

社会的推論は、数学やコードのように答え合わせしやすい領域より厄介です。相手が何を知っていて、何を誤解していて、どう感じていて、どんな意図で話しているかは、文章中の明示情報だけでは決まりません。人間はふつう、文脈、関係性、暗黙の前提、言い方のニュアンスをまとめて読んで判断しますが、LLM はここでしばしば近道に流れます。

核心:何を提案したのか

提案は二つあります。第一が ToMBench-Hard、第二が Social-R1 です。ToMBench-Hard は、単なる評価セットではなく、ショートカットが効きにくい社会的推論の難問を与える訓練・評価基盤として設計されています。論文では、人間の総合精度が 0.89 なのに対し、DeepSeek-R1 は 0.61、O3 は 0.59、GPT-5 は 0.56 にとどまることを示し、社会的推論の本当の難しさを露出させています。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related